Інтеграція великих мовних моделей (LLM) з Home Assistant відкриває низку переваг. Це дозволяє додати розуміння природної мови, покращити роботу вашого голосового помічника та навіть аналізувати зображення. Використання локальної LLM сприяє збереженню конфіденційності, але не завжди потребує застосування наймасштабніших моделей.

Нік Льюїс

Локальні LLM для розширених можливостей Home Assistant

Збереження приватності ваших даних

Існує безліч способів, за допомогою яких LLM може значно розширити функціональність Home Assistant. Одним з популярних рішень є підключення хмарної моделі від компаній на кшталт OpenAI для використання як голосового асистента в Assist. Це дозволяє керувати вашим “розумним будинком” за допомогою команд природною мовою, замість запам’ятовування специфічних фраз для ввімкнення чи вимкнення освітлення.

Проблема використання хмарних LLM полягає в тому, що дані про ваш “розумний будинок” надсилаються до хмари для обробки. Це означає, що інформація потрапляє на сервери третіх сторін. Home Assistant був розроблений з метою забезпечення максимальної приватності, тому передача відомостей про ваш дім компаніям, що займаються розробкою ШІ, суперечить цьому фундаментальному принципу.

Одним із рішень є використання локальної LLM. Ви можете запускати моделі на власному обладнанні, які здатні виконувати подібні завдання, що й хмарні LLM. Швидкість та точність виконання цих завдань залежить як від вашого апаратного забезпечення, так і від обраних моделей.

Чому найбільша модель — не завжди найкращий вибір

Пошук оптимального балансу

LLM часто доступні в різних розмірах. Ви можете зустріти версії однієї моделі з позначками, наприклад, 4B, 9B, 70B. Ці цифри вказують на кількість параметрів моделі; модель 70B має 70 мільярдів параметрів. Більші моделі зазвичай мають більший потенціал для зберігання знань та логічних висновків.

Однак, чим більше параметрів має модель, тим більше відеопам’яті (VRAM) потребується для їх зберігання. Деякі моделі 70B можуть вимагати понад 100 ГБ VRAM для запуску. Це поза межами можливостей навіть найсучасніших споживчих графічних процесорів, якщо ви не використовуєте конфігурацію з кількома GPU. Якщо ж VRAM недостатньо, модель або не запуститься взагалі, або працюватиме вкрай повільно.

Завдання полягає у пошуку моделі, яка достатньо компактна для роботи на вашому обладнанні, але водночас достатньо потужна для виконання необхідних завдань. Існують корисні інструменти, як-от llmfit, які допоможуть визначити, які моделі найкраще підходять для вашого обладнання.

Приємно усвідомлювати, що з розвитком технологій з’являються нові, менші моделі, які можуть перевершувати за продуктивністю великі моделі, що існували кілька років тому. Вам більше не потрібна величезна кількість VRAM для досягнення гідної продуктивності від локальної LLM.

Малі локальні LLM працюють на базовому обладнанні

Дорога відеокарта не обов’язкова

Якщо у вас немає окремої відеокарти, це ще не кінець світу. Існують менші моделі, здатні працювати виключно на центральному процесорі (CPU), без необхідності задіювати GPU. Ці моделі використовують системну оперативну пам’ять (RAM) вашого комп’ютера, а не обмежуються VRAM. Хоча продуктивність не може зрівнятися з великими моделями, що працюють на GPU, вони все одно можуть виконувати свої завдання.

Я мав на меті запустити локальну LLM на своєму Beelink Mini PC, який має 16 ГБ оперативної пам’яті та не має дискретної відеокарти. Основне завдання полягало в тому, щоб перетворити список подій з мого календаря на текстовий формат для ранкової голосової трансляції. Я бачив, як багато хто відзначав модель Qwen 3.5 4B як хороший компроміс, тому вирішив спробувати її.

Використовуючи цю модель, мені вдалося згенерувати ранкову трансляцію, хоча це зайняло близько 13 секунд. Текст був прийнятним, але не надто виразним.

Щоб прискорити процес, я спробував меншу модель, Llama 3.2 3B, яка використовує менше параметрів. Можна було б очікувати гіршого результату, але вона видала значно природніший вивід і зробила це менш ніж за 6 секунд — удвічі швидше, ніж попередня модель.

Виходить, що розмір — це не все. Найбільша модель, яку ви можете запустити, не завжди є найкращим вибором; використання меншої моделі може бути швидшим і навіть забезпечити кращі результати.

Мала локальна LLM не підходить для всіх завдань

Складність роботи як розмовного агента

Заради експерименту я спробував використати одну з цих моделей як розмовного агента для Assist. Це дозволило б мені використовувати команди природною мовою з Assist, замість необхідності використовувати конкретні фрази.

Підпишіться на практичні поради щодо локальних LLM та Home Assistant

Отримуйте розсилку з дієвими рекомендаціями щодо локальних LLM та Home Assistant — поради щодо вибору моделей, налаштування з урахуванням приватності та практичні рішення для роботи з малими моделями вдома. Підпишіться, щоб спробувати самостійно. Отримати оновлення Підписуючись, ви погоджуєтеся отримувати розсилки та маркетингові матеріали, а також приймаєте наші Умови використання та Політику конфіденційності. Ви можете відписатися в будь-який час.

Як і очікувалося, обидві моделі зазнали повної невдачі. На моєму обладнанні контекст був занадто великим для швидкої обробки цими меншими моделями, і увімкнення світла займало понад 20 секунд, що було абсолютно неприйнятно.

Якщо ви використовуєте локальну LLM без потужного обладнання, вона не підійде для всіх завдань, оскільки буде або занадто повільною, або нездатною виконати бажане. Однак, для деяких завдань, як-от генерація ранкових брифінгів, локальна LLM є ідеальним способом досягти бажаних результатів із збереженням приватності.

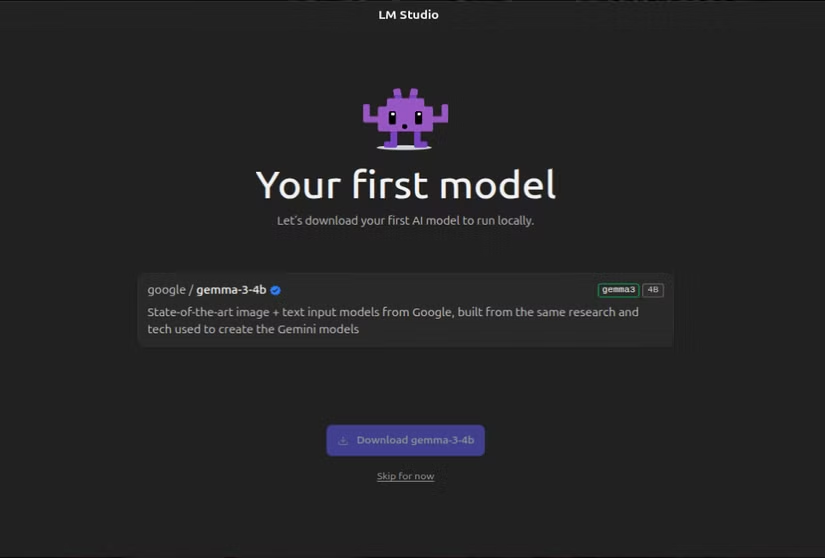

Спробуйте локальну LLM

Якщо ви відкладали спробу використання локальної LLM, вважаючи, що ваше обладнання не впорається, варто перевірити, на що здатна невелика локальна модель. Доки я не виграю в лотерею і не зможу дозволити собі потужний ШІ-комплекс, ці малі моделі цілком підійдуть.

Порада від Soft Portal:

Інтеграція локальних великих мовних моделей (LLM) з Home Assistant може суттєво розширити функціонал вашого “розумного будинку”, додавши можливості розуміння природної мови та покращивши роботу голосового помічника. При цьому, використання локальних моделей забезпечує вищий рівень конфіденційності ваших даних. Навіть на відносно простому обладнанні, як-от міні-ПК з 16 ГБ RAM, можна досягти вражаючих результатів, особливо для специфічних завдань, таких як генерація текстів. Важливо правильно підібрати модель, адже менші, але оптимізовані моделі можуть перевершувати великі за швидкістю та якістю виконання певних задач, не вимагаючи при цьому дороговартісного обладнання.

Оригінал статті: www.howtogeek.com