Навіть коли провідні постачальники ШІ, такі як OpenAI та Anthropic, змагаються за обчислювальні потужності для тренування та випуску дедалі більших і потужніших моделей, інші лабораторії йдуть іншим шляхом — зосереджуючись на розробці менших, ефективніших моделей, часто з відкритим кодом. Останньою розробкою, на яку варто звернути увагу, є новий мовний механізм суміші експертів (MoE) ZAYA1-8B від стартапу Zyphra з Пало-Альто. Модель має трохи більше 8 мільярдів параметрів, з яких активно задіяно лише 760 мільйонів — значно менше, ніж трильйони, що оцінюються для великих лабораторій. Проте, ZAYA1-8B зберігає конкурентоспроможну продуктивність на сторонніх бенчмарках проти GPT-5-High та DeepSeek-V3.2. Модель доступна для завантаження з Hugging Face безкоштовно під дозвільною стандартною ліцензією Apache 2.0, зручною для підприємств. Це дозволяє компаніям та незалежним розробникам негайно використовувати та налаштовувати її відповідно до своїх потреб. Індивідуальні користувачі також можуть протестувати її безкоштовно через Zyphra Cloud, хмарне рішення для інференсу від стартапу. Однак справжньою новиною є те, на чому тренувалася ZAYA1-8B: повний стек графічних процесорів AMD Instinct MI300. Ці GPU, представлені AMD майже три роки тому, є конкурентами для GPU від Nvidia. Це демонструє, що платформа AMD здатна створювати корисні моделі і становить життєздатну альтернативу домінуючій позиції Nvidia серед розробників ШІ-моделей протягом останніх років.

Як тренувалася ZAYA1-8B

“Щільність інтелекту”, яку вихваляє Zyphra, є результатом підходу “full-stack innovation”, що охоплює архітектуру, попереднє тренування та навчання з підкріпленням (RL).

ZAYA1-8B побудована на пропрієтарній архітектурі MoE++ від Zyphra, описаній у технічному звіті лабораторії. Ця архітектура вносить три фундаментальні зміни до стандартної архітектури Transformer, яка дала початок великим мовним моделям (LLM) та всій ері генеративного ШІ:

-

Стиснута згорткова увага (Compressed Convolutional Attention – CCA): На відміну від стандартних механізмів уваги, які стикаються з проблемами пам’яті зі зростанням контекстних вікон, CCA виконує змішування послідовностей у стисненому латентному просторі. Це призводить до 8-кратного зменшення розміру KV-кешу порівняно з повною багатошаровою увагою, забезпечуючи ефективніше розуміння довгого контексту.

-

Маршрутизатор ZAYA1 MLP: Більшість MoE-моделей використовують лінійний маршрутизатор для визначення, які “експерти” обробляють конкретний токен. Zyphra замінила це на більш виразний дизайн на основі багатошарових MLP. Для підтримки стабільності під час тренування — поширеної перешкоди для MoE — вони впровадили схему балансування зміщення, натхненну ПІД-регуляторами з класичної теорії керування.

-

Навчене масштабування залишкових значень (Learned Residual Scaling): Це контролює зростання “норми залишкових значень” під час проходження даних глибше у 40 шарів моделі, запобігаючи зникненню або вибуху градієнтів з мінімальними обчислювальними витратами.

Попереднє тренування з акцентом на міркування

Критичною відмінністю ZAYA1-8B є те, що міркування було інтегровано з самого початку попереднього тренування, а не “додано” під час пост-тренування.

Для обробки довгих ланцюжків міркувань (chain-of-thought – CoT), які інакше перевищували б початковий контекст попереднього тренування у 4K, Zyphra розробила метод “Обрізання, що зберігає відповідь” (Answer-Preserving – AP Trimming).

Уявіть AP-trimming як роботу монтажера фільму, що вирізає довгу сцену: замість того, щоб вирізати кінець (розв’язку) або викидати сцену повністю, монтажер видаляє “середину” монологу персонажа, зберігаючи початок (постановку проблеми) та фінальне розкриття (відповідь).

Це гарантує, що модель вивчає взаємозв’язок між складними проблемами та їхніми розв’язками, навіть коли повна внутрішня логіка ще не вміщується в пам’ять.

Це добре спрацювало під час мого тестового запиту щодо видалення плям з робочої поверхні на ZAYA1-8B, що працює на Zyphra Cloud.

Markovian RSA: переосмислення обчислень під час інференсу

Найбільший стрибок продуктивності моделі забезпечує Markovian RSA — нова методологія обчислень під час інференсу (test-time compute – TTC).

Традиційно, якщо потрібно, щоб модель “думала глибше”, їй дозволяють генерувати довший ланцюжок міркувань. Однак це часто призводить до “перевантаження контексту”, коли модель втрачає фокус через надто довгу історію.

Markovian RSA вирішує цю проблему, відокремлюючи “глибину мислення” від “розміру контексту”. Це функціонує як процес рекурсивного наукового рецензування:

-

Модель генерує кілька паралельних шляхів міркувань (кандидатів).

-

Потім вона вибирає лише “кінці” (останні кілька тисяч токенів) цих шляхів.

-

Ці кінці вибірково подаються моделі у новому “агрегованому запиті”, з проханням узгодити різні підходи для отримання кращого рішення.

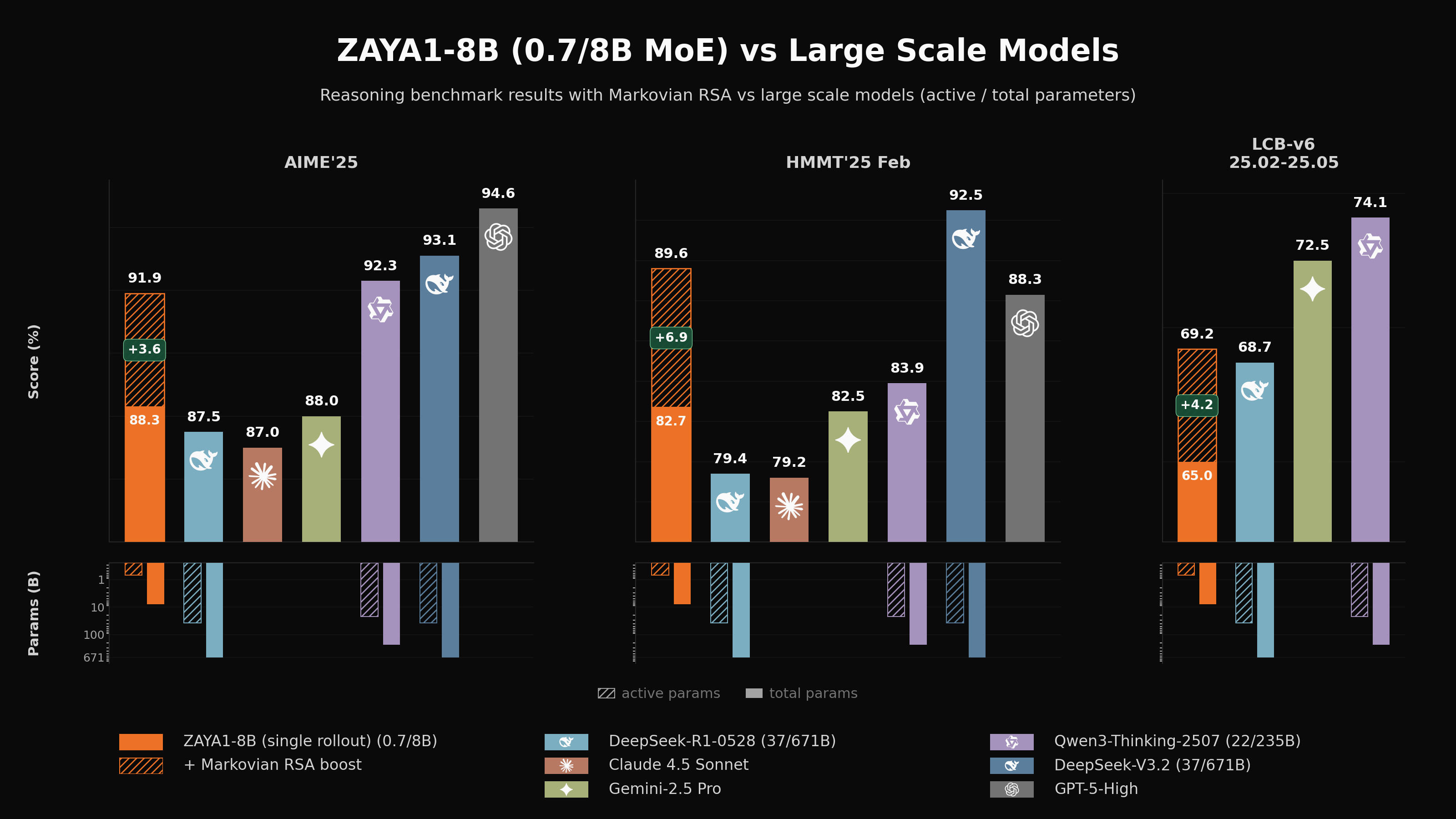

Передаючи лише кінці (зазвичай з бюджетом 4K токенів), модель може міркувати нескінченно, не переповнюючи контекстне вікно. На практиці це дозволяє ZAYA1-8B з 700 мільйонами активних параметрів досягти 91,9% балів на AIME ’25, скорочуючи розрив з моделями, які мають у 30-50 разів більше активних параметрів.

Оскільки ZAYA1-8B зберігає невеликий загальний розмір параметрів (8,4 мільярда), вона унікально позиціонується для розгортання на пристроях та локальних LLM-додатків. Для підприємств це означає можливість розгортати висококласні можливості міркування — традиційно зарезервовані для величезних хмарних моделей — безпосередньо на локальному обладнанні або периферійних пристроях. Цей підхід “спочатку локально” вирішує поширені проблеми підприємств, пов’язані з місцезнаходженням даних, затримкою та високою вартістю постійної залежності від API.

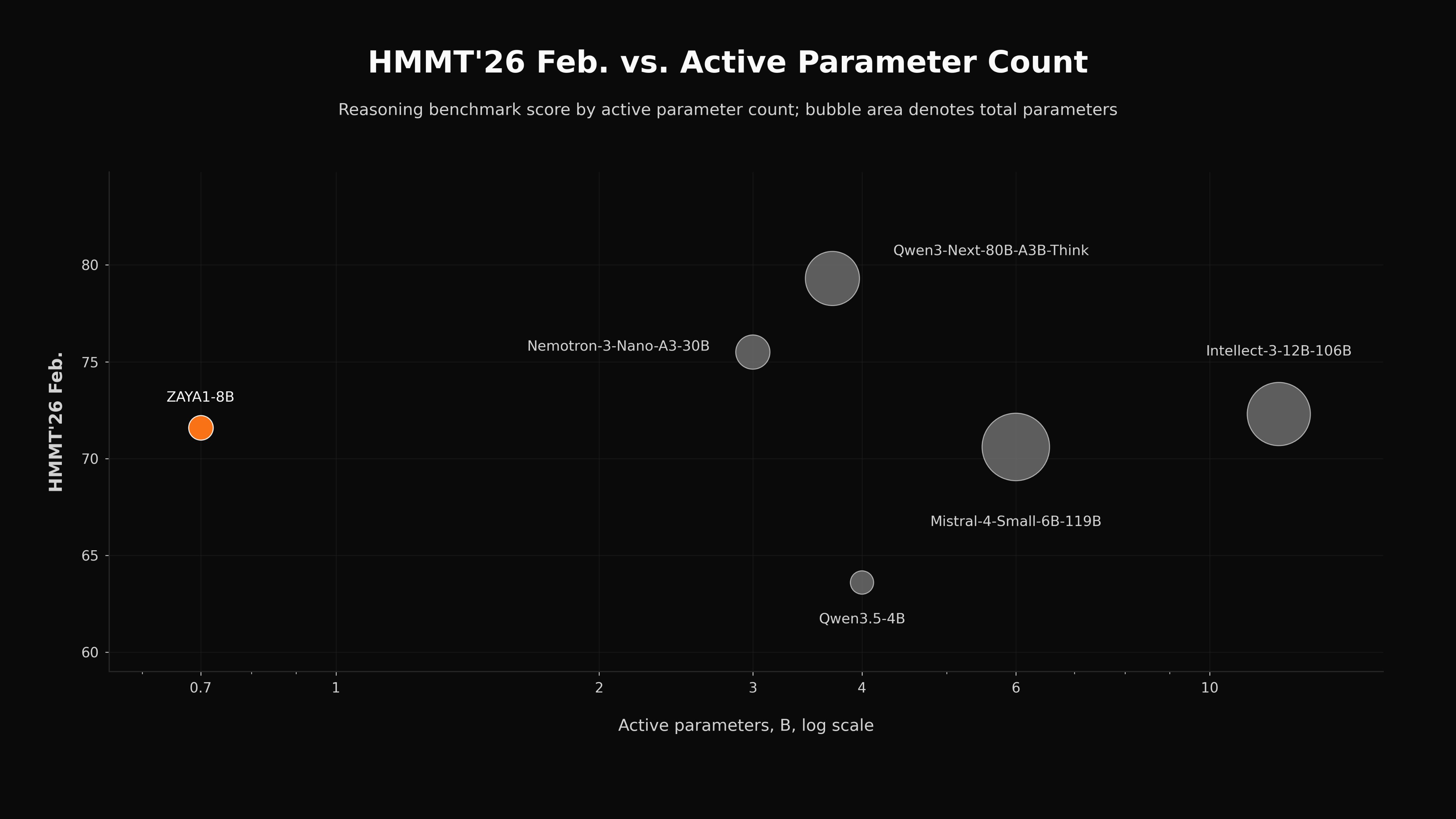

Бенчмарки демонструють надзвичайно продуктивну малу модель, яка перевершує свій клас

Zyphra позиціонує ZAYA1-8B як модель, що “перевершує свій клас”, для розробників, яким потрібні висококласні міркування без затримки чи вартості масивних передових моделей. Зрештою, кількість її активних параметрів значно менша, ніж у інших моделей подібного розміру, що робить її набагато дешевшою та менш вимогливою до обчислень для роботи в режимі інференсу.

-

Виконання інструкцій: ZAYA1-8B отримує 85.58 балів за IFEval, залишаючись конкурентоспроможною з набагато більшими моделями, такими як Intellect-3 (106B).

-

Агентні можливості: На τ² benchmark модель досягає 43.12, а на BFCL-v4 — 39.22, надаючи базовий рівень для її здатності обробляти виклики інструментів та багатоходові завдання.

У одноразових оцінках (без додаткового часу на “роздуми”) ZAYA1-8B вже перевершує свій клас. Вона обганяє Qwen3.5-4B та Gemma-4-E4B у бенчмарках з математики та кодування.

При увімкненні Markovian RSA результати вражають:

-

HMMT ’25 (Математика): ZAYA1-8B досягає 89,6%, перевершуючи Claude 4.5 Sonnet (79,2%) та GPT-5-High (88,3%).

-

LiveCodeBench (Кодування): Модель досягає 69,2%, перевершуючи DeepSeek-R1-0528.

Zyphra зазначає, що хоча модель є фахівцем з алгоритмічних міркувань, вона дещо поступається більшим моделям у “знанєво-орієнтованих” завданнях, таких як широкий пошук фактів (MMLU-Pro). Це свідчить про те, що хоча міркування можна стиснути до менших ядер, фактична пам’ять все ще виграє від великої кількості параметрів.

Ліцензія Apache 2.0 відкрита для досліджень та комерційного використання

Zyphra випустила ZAYA1-8B під ліцензією Apache-2.0. Це критично важливий вибір для спільноти розробників. На відміну від “copyleft” ліцензій, таких як GPL, які вимагають, щоб будь-яка похідна робота також була відкритою, Apache-2.0 є дуже дозвільною.

Для розробників та підприємств це означає, що вони можуть використовувати, змінювати та розповсюджувати ZAYA1-8B, навіть у пропрієтарних комерційних додатках, без необхідності відкривати власні кодові бази.

Вона також включає явне надання патентних прав від учасників, забезпечуючи рівень правової безпеки для стартапів, що будують на архітектурі Zyphra. Обираючи Apache-2.0 замість більш обмежувальних ліцензій “лише для досліджень”, які часто зустрічаються у передових лабораторій, Zyphra демонструє свою прихильність до екосистеми відкритих ваг.

Для розгортання ZAYA1-8B розробникам необхідно використовувати специфічні гілки з форків Zyphra основних бібліотек, оскільки архітектура потребує спеціалізованої обробки:

-

Кастомні форки: Користувачі повинні встановити гілку zaya1 з версій бібліотек vllm та transformers від Zyphra.

-

Прапори розгортання: При запуску сервера vLLM потрібні специфічні прапори для обробки парсера міркувань та виклику інструментів (наприклад, –reasoning-parser qwen3 та –tool-call-parser zaya_xml).

-

Стратегія паралелізму: Для середовищ з кількома GPU Zyphra рекомендує використовувати паралелізм даних (Data Parallelism – DP) у поєднанні з паралелізмом експертів (Expert Parallelism – EP). Варто зазначити, що паралелізм тензорів (Tensor Parallelism – TP) для механізму CCA моделі наразі не підтримується, тому DP+EP є оптимальним шляхом для масштабування пропускної здатності інференсу.

Zyphra: Нова парадигма щільності інтелекту

Заснована у 2021 році та розташована у Пало-Альто, Каліфорнія, Zyphra Technologies — це повноцінна лабораторія штучного інтелекту, що займається створенням штучного загального інтелекту (AGI), узгодженого з людськими цінностями, який перевершує людей у більшості завдань, через децентралізовану, відкриту структуру.

Згідно з офіційною місією компанії, Zyphra прагне кинути виклик “централізованому” домінуванню монолітних хмарних моделей, зосереджуючись на “щільності інтелекту” — основному керівному принципі, що має на меті максимізувати міркування та логіку, вилучені на один параметр та на один FLOP.

Генеральний директор та співзасновник Zyphra Крітік Путхалат пояснював раніше VentureBeat, що ця стратегія є важливою для того, щоб високопродуктивний ШІ міг працювати локально на такому обладнанні, як планшети, окуляри та сервери підприємств, забезпечуючи конфіденційність користувачів та зменшуючи залежність від сторонньої хмарної інфраструктури.

Технічна ідентичність компанії глибоко сформована під впливом обчислювальної нейронауки, якою керує співзасновник і головний науковий співробітник Берен Міллідж.

Згідно з особистим веб-сайтом Мілліджа, він наразі є постдокторантом на кафедрі клінічної нейронауки Наффілда Оксфордського університету, де його дослідження зосереджені на глибокому призначенні кредиту та математичних моделях мозку.

Міллідж, який отримав ступінь доктора філософії в Единбурзькому університеті, є піонером у дослідженнях активного висновку та “принципу вільної енергії” — концепцій, які безпосередньо впливають на прагнення Zyphra до багатомодальних архітектур, здатних до довготривалої пам’яті та постійного навчання.

Цей вплив нейронауки був центральним у розробці попередньої моделі Zyphra, Zamba, випущеної у 2024 році, яка імітує взаємодію кори головного мозку та гіпокампа для обміну інформацією між послідовними шарами. Нещодавнє відео TED Talk дає уявлення про точку зору Мілліджа на перетин біологічної нейронауки та ШІ, що слугує теоретичною основою для архітектур моделей Zyphra.

Zyphra досягла значних технічних віх завдяки глибокій інтеграції з екосистемою обладнання AMD, як детально описано в дослідницькій документації компанії.

Фінансові дані PitchBook вказують, що Zyphra наразі є компанією, що фінансується венчурним капіталом, яка досягла статусу “Єдинорога” у червні 2025 року після раунду фінансування серії А на суму 110 мільйонів доларів. Згідно з PitchBook та прес-релізами компанії, Zyphra підтримується групою стратегічних інвесторів, включаючи Advanced Micro Devices (AMD), IBM, Bison Ventures та BC VC. Маючи команду приблизно з 31 співробітника станом на 2026 рік, компанія продовжує розширювати свою присутність через Zyphra Inference Cloud та Maia — платформу інтелектуального помічника, розроблену для надання розширених інструментів пошуку та продуктивності командам підприємств.

Реакція спільноти та контекст галузі

Оголошення знайшло сильний відгук у спільноті ШІ, зібравши майже 1 мільйон переглядів на X/Twitter протягом 24 годин. Захоплення значною мірою зосереджене на двох факторах: життєздатності стеку AMD та ефективності “каскаду” міркувань.

Технологи відзначили, що процес пост-тренування Zyphra — 4-стадійний RL-каскад — є незвично дисциплінованим. Більшість лабораторій використовують один раунд RL, але пайплайн Zyphra включає “розігрів міркувань”, за яким слідує навчальна програма з 400 адаптивних головоломоподібних середовищ (RLVE-Gym) перед тим, як перейти до шліфування поведінки.

Однією з найбільш високо оцінених деталей “під капотом” є Router Replay. У MoE-моделях тренування може стати нестабільним, якщо “тренерський” двигун та “інференсний” двигун приймають дещо різні рішення щодо того, якого експерта використовувати для токена через шум з плаваючою комою. Система Zyphra записує точні вибори експертів, зроблені під час генерації, і змушує тренера використовувати їх, ефективно “закріплюючи” обчислювальний шлях і забезпечуючи вищу стабільність навчання.

Оскільки галузь стикається з потенційним плато в перевагах від простого додавання параметрів, ZAYA1-8B пропонує переконливий контр-аргумент: наступний рубіж ШІ — це не лише про більші кластери, а й про більш “розумні” алгоритми “мислення”, які можуть робити більше з меншим.

Прогноз ІТ-Блогу: ZAYA1-8B та подібні моделі, що демонструють виняткову ефективність та конкурентоспроможність на AMD-обладнанні, ймовірно, стимулюватимуть появу нових гравців на ринку ШІ-апаратного забезпечення та програмного забезпечення. Зросте попит на менші, оптимізовані моделі, які можна розгортати локально, що призведе до значного зростання ринку периферійних обчислень ШІ.

Джерело новини: venturebeat.com