Міждисциплінарна компанія Subquadratic, що базується в Маямі, вийшла з тіні, зробивши зухвалу заяву: вона розробила першу велику мовну модель, яка повністю подолала математичне обмеження, що визначало (і обмежувало) кожну ключову систему штучного інтелекту з 2017 року.

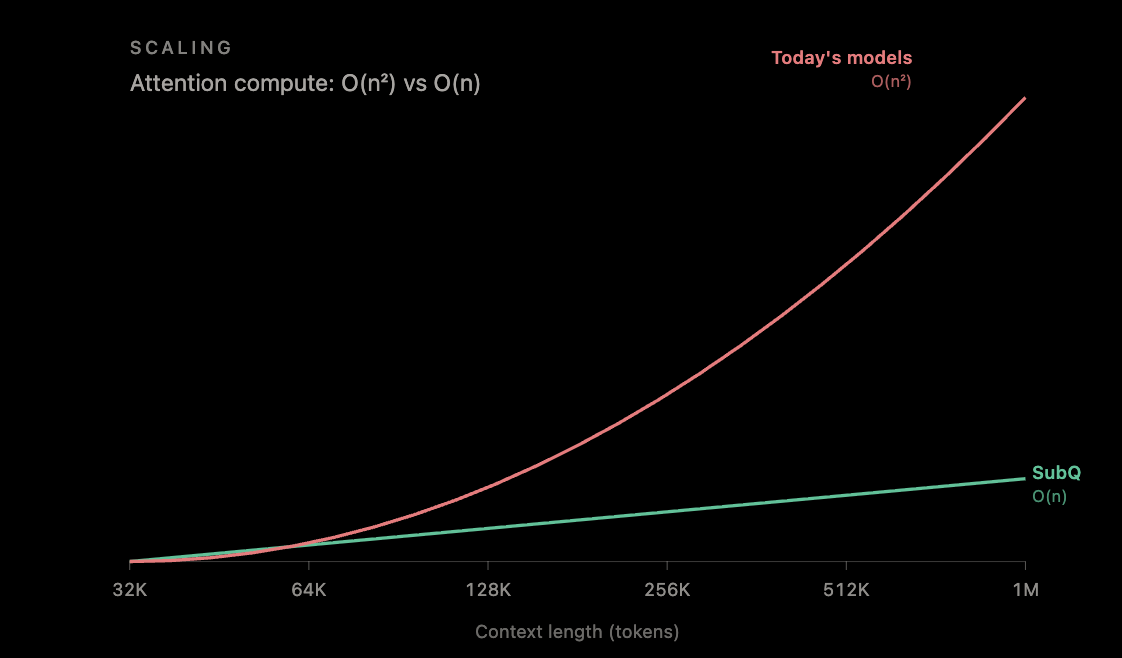

Компанія стверджує, що її перша модель, SubQ 1M-Preview, є першою великою мовною моделлю, побудованою на повністю субквадратичній архітектурі, де обчислювальні потужності зростають лінійно зі довжиною контексту. Якщо це твердження виявиться правдивим, це стане справжнім переломним моментом у масштабуванні систем ШІ. Компанія заявляє, що її архітектура з 12 мільйонами токенів зменшує обчислення уваги майже в 1000 разів порівняно з іншими передовими моделями — цифра, яка, у разі незалежного підтвердження, затьмарить ефективність будь-якого існуючого підходу.

Компанія також запускає три продукти у формі закритого бета-тестування: API, що надає повне вікно контексту, командний інструмент для кодування під назвою SubQ Code та пошуковий інструмент SubQ Search. Вона залучила 29 мільйонів доларів посівного фінансування від інвесторів, серед яких співзасновник Tinder Джастін Матін, колишній партнер SoftBank Vision Fund Хав’єр Вільямізар та ранні інвестори Anthropic, OpenAI, Stripe і Brex. The New Stack повідомив, що оцінка компанії становить 500 мільйонів доларів.

Цифри, які публікує Subquadratic, є надзвичайними. Реакція спільноти дослідників ШІ була, м’яко кажучи, неоднозначною — від щирої цікавості до відкритих звинувачень у “паперових” продуктах (vaporware). Розуміння причин вимагає усвідомлення того, що саме компанія стверджує, що вона вирішила, і чому так багато попередніх спроб вирішити ту саму проблему зазнали невдачі.

Проблема квадратичного масштабування визначила економіку всієї індустрії ШІ

Кожна модель штучного інтелекту на основі трансформера — яка охоплює практично всі передові системи від OpenAI, Anthropic, Google та інших — покладається на операцію під назвою “увага” (attention). Кожен токен порівнюється з кожним іншим токеном, тому зі збільшенням вхідних даних кількість взаємодій — і обчислювальних потужностей, необхідних для їх обробки — зростає квадратично. Простими словами: подвоївши розмір вхідних даних, вартість не подвоюється, а зростає вчетверо.

Цей взаємозв’язок визначив, що створюється, а що ні. Стандартним обмеженням для багатьох моделей ШІ є 128 000 токенів, а для передових хмарних моделей, таких як Claude Sonnet 4.7 та Gemini 3.1 Pro, — до 1 мільйона токенів.

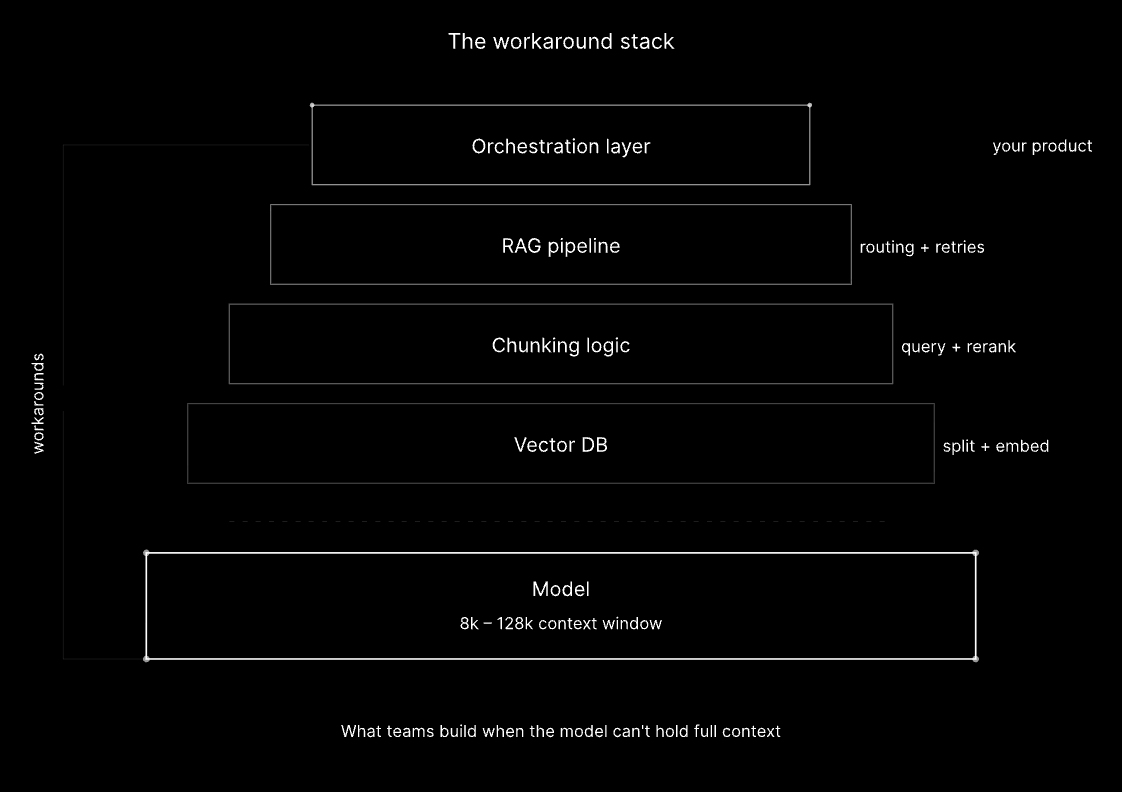

Навіть за таких розмірів вартість обробки довгих вхідних даних стає надзвичайно високою. Індустрія розробила складний набір обхідних шляхів для подолання цієї проблеми. Системи RAG (Retrieval-Augmented Generation) використовують пошукову систему для вилучення невеликої кількості релевантних результатів перед надсиланням їх до моделі, оскільки надсилання повного корпусу документів є неможливим. Розробники накладають конвеєри вилучення, стратегії розбиття на частини, методи інженерії підказок та системи оркестрації багаторазових агентів поверх моделей — все для того, щоб обійти фундаментальне обмеження, яке полягає в тому, що сама модель не може ефективно обробляти все одночасно.

Subquadratic стверджує, що ці обхідні шляхи є дорогими, крихкими та, зрештою, обмежувальними. Як зазначив технічний директор Олександр Ведон (Alexander Whedon) у інтерв’ю SiliconANGLE: “Я вручну курував підказки, системи вилучення, оцінки та умовну логіку для зв’язування робочих процесів. І я вважаю, що це марнування людського інтелекту, а також обмежує якість продукту”.

Рішення Subquadratic є напрочуд простим: припинити виконувати непотрібні обчислення

Підхід компанії, названий Subquadratic Sparse Attention (SSA), базується на простому припущенні: більшість порівнянь токенів у стандартній увазі є марною витратою обчислювальних потужностей. Замість того, щоб порівнювати кожен токен з кожним іншим, SSA навчається ідентифікувати, які порівняння дійсно мають значення, і обчислює увагу лише над цими позиціями. Важливо, що вибір є залежним від контенту — модель вирішує, куди дивитися, на основі змісту, а не на фіксованих патернах позицій. Це дозволяє їй вилучати конкретну інформацію з довільних позицій у дуже довгому контексті, не сплачуючи квадратичну “податок”.

Практична вигода масштабується зі збільшенням довжини контексту — точно навпаки проблемі, яку вона намагається вирішити. Згідно з технічним блогом компанії, SSA досягає 7,2-кратного прискорення попередньої обробки порівняно з щільною увагою при 128 000 токенах, що зростає до 52,2-кратного при 1 мільйоні токенів. Як зазначив Ведон: “Якщо ви подвоюєте розмір вхідних даних з квадратичними законами масштабування, вам потрібна вчетверо більша обчислювальна потужність; з лінійними законами масштабування — лише вдвічі”. Компанія стверджує, що навчала модель у три етапи — попереднє навчання, кероване доналаштування та етап навчання з підкріпленням, спеціально спрямований на збої вилучення в довгому контексті — навчаючи модель агресивно використовувати віддалений контекст, а не надавати перевагу ближній інформації, що є тонким недоліком, який тихо знижує продуктивність у існуючих системах.

Три тести малюють сильну картину, але те, що вони залишають поза кадром, може бути важливішим

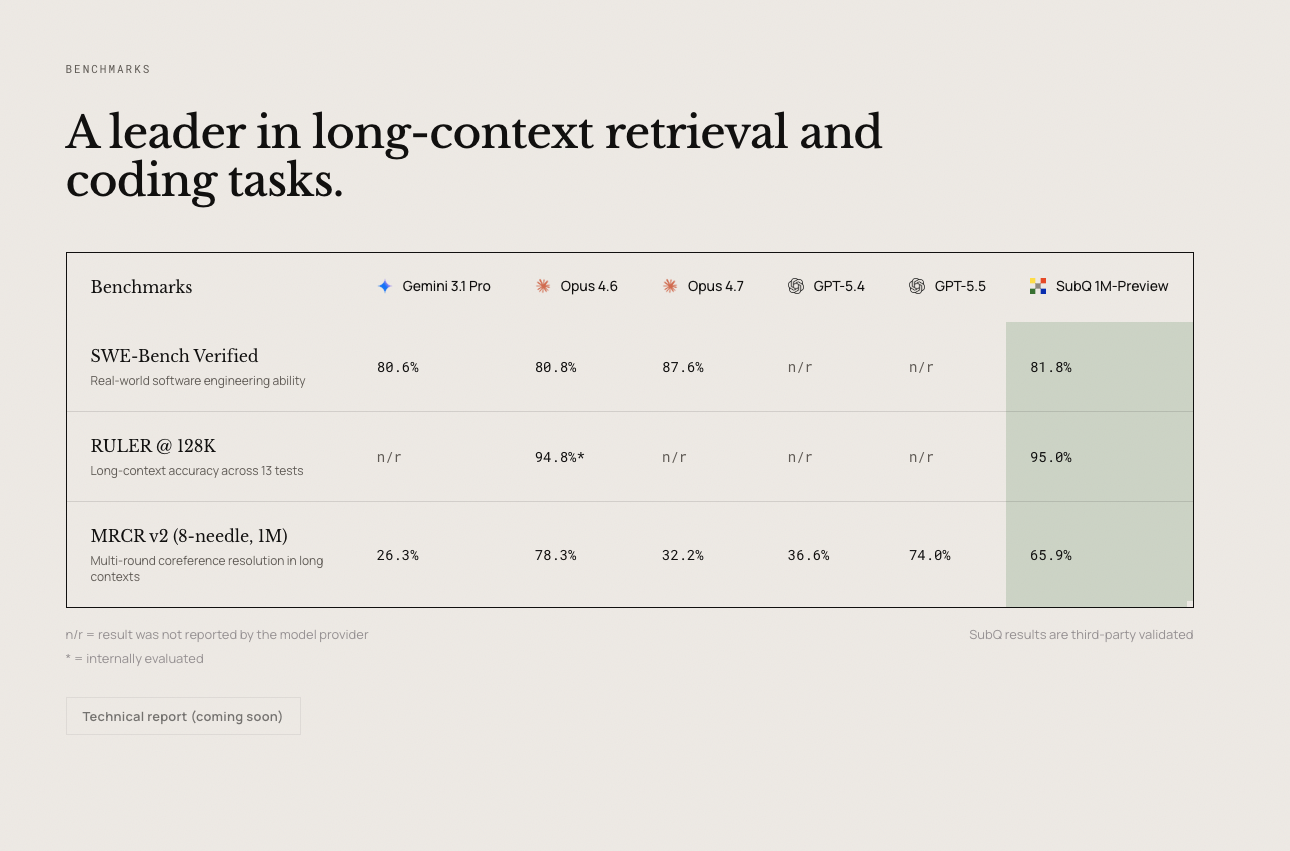

На перший погляд, результати тестів SubQ конкурентоспроможні або перевищують показники моделей, створених організаціями, які витрачають мільярди доларів. На SWE-Bench Verified модель показала 81.8% порівняно з 80.8% у Opus 4.6 та 80.0% у DeepSeek 4.0 Pro. На RULER при 128 000 токенах, стандартному тесті для міркування над розширеними вхідними даними, SubQ показала 95% — випередивши Claude Opus 4.6 (94.8%). На MRCR v2, складному тесті багатоетапного вилучення в довгих контекстах, SubQ продемонструвала незалежно перевірений результат 65.9% порівняно з Claude Opus 4.7 (32.2%), GPT-5.5 (74%) та Gemini 3.1 Pro (26.3%).

Однак кілька деталей заслуговують на пильну увагу. Вибір тестів є вузьким — лише три тести, всі вони наголошують на вилученні в довгому контексті та кодуванні, тобто саме на тих завданнях, для яких SubQ призначена. Ширші оцінки загальних міркувань, математики, багатомовної продуктивності та безпеки не були опубліковані. Компанія зазначає, що повна картка моделі “з’явиться незабаром”.

За даними The New Stack, кожна тестована модель була запущена лише один раз через високу вартість виведення, а перевага SWE-Bench, як визнає сама компанія у своїй статті, є “настільки ж запорукою, як і моделлю”. У методології тестування, одиночні запуски без інтервалів довіри залишають простір для варіацій. Також існує значний розрив між дослідницькими результатами SubQ та її робочою моделлю. На MRCR v2 компанія повідомила про дослідницький результат 83, але незалежно перевірена робоча модель показала 65.9. Цей 17-бальний розрив між лабораторним результатом та продуктом, що випускається, є помітним і значною мірою незрозумілим.

Subquadratic також повідомила SiliconANGLE, що на тесті RULER 128K модель SubQ показала 95% точності при вартості 8 доларів, порівняно з 94% точності та приблизно 2600 доларів для Claude Opus — вражаюча заява щодо вартості. Однак компанія не оприлюднила конкретних цін на API, що унеможливлює незалежну перевірку порівнянь вартості за завдання.

Вердикт спільноти дослідників ШІ коливається від “справжнього прориву” до “AI Theranos”

Протягом кількох годин після оголошення спільнота дослідників ШІ вибухнула дебатами, що кристалізувалися навколо одного питання: чи це справді так?

Коментатор у сфері ШІ Ден МакАтір (Dan McAteer) влучно описав двоїстий настрій у широко поширеному пості: “SubQ — це або найбільший прорив з часів Трансформера… або це AI Theranos”. Порівняння з сумнозвісною компанією-шахраєм, що займалася тестуванням крові, може бути несправедливим, але воно відображає масштаб заявлених амбіцій. Скептики зосередилися на кількох проблемних точках. Відомий інженер ШІ Вілл Деп’ю (Will Depue) спочатку зазначив, що SubQ “майже напевно є доналаштованою версією Kimi або DeepSeek зі спарсивною увагою”, посилаючись на існуючі моделі з відкритим кодом.

Ведон підтвердив це на платформі X, написавши, що компанія “використовує ваги з моделей з відкритим кодом як вихідну точку, зважаючи на наше фінансування та зрілість як компанії”. Пізніше Деп’ю посилив свою критику, написавши, що заяви компанії про масштабування O(n) та показники прискорення “не здаються відповідними” і назвав комунікацію “або надзвичайно погано комунікованою, або просто нереальною”.

Інші підняли структурні питання. Один розробник зазначив, що якщо SubQ справді зменшує обчислення в 1000 разів і коштує менше 5% від Opus, компанія не повинна мати проблем з масштабуванням обслуговування — то чому доступ обмежений програмою раннього доступу? Розробник Степан Гончаров назвав тести “дуже цікавими, але вибірковими”, тоді як інший коментатор описав їх як “підозріло ідеальні”.

Однак не всі були зневажливими. Дослідник ШІ Джон Рісана (John Rysana) виступив проти порівняння з Theranos, написавши, що робота — це “просто добре виконана субквадратична увага, що є дуже значущим для робочих навантажень з довгим контекстом”, і що “ймовірність того, що це нісенітниця, надзвичайно низька”. Лінус Екенстам (Linus Ekenstam), технологічний коментатор, сказав, що він “надзвичайно заінтригований реальними наслідками”, особливо для складного програмного забезпечення на базі ШІ.

Magic.dev два роки тому зробив разюче схожі заяви — а потім замовк

Можливо, найгострішою критикою запуску SubQ є не стільки її конкретні заяви, скільки нещодавня історія. Magic.dev анонсувала модель з контекстним вікном у 100 мільйонів токенів у серпні 2024 року, заявивши про перевагу в ефективності у 1000 разів, і залучила близько 500 мільйонів доларів на основі цих заяв. Станом на початок 2026 року немає жодних публічних доказів використання LTM-2-mini поза межами Magic.

Паралелі викликають дискомфорт. Обидві компанії заявили про величезні контекстні вікна. Обидві хвалилися приблизно 1000-кратним зростанням ефективності. Обидві націлювалися на розробку програмного забезпечення як основний варіант використання. І обидві запустилися з обмеженим зовнішнім доступом.

Ширший ландшафт досліджень підкріплює обережність. Kimi Linear, DeepSeek Sparse Attention, Mamba та RWKV обіцяли субквадратичне масштабування, і всі вони стикалися з однією проблемою: архітектури, які теоретично досягають лінійної складності, на практиці часто поступаються квадратичній увазі на вторинних тестах у великому масштабі, або стають гібридними — змішуючи субквадратичні шари зі стандартною увагою та втрачаючи чисті переваги масштабування.

Широко цитований аналіз на LessWrong стверджував, що ці підходи “краще розглядати як ‘чергове інкрементне покращення № 93595 до архітектури Трансформера'”, оскільки практичні реалізації залишаються квадратичними і “покращують увагу лише на константний коефіцієнт”.

Subquadratic безпосередньо усвідомлює цю історію. Її технічний блог спеціально розглядає кожен попередній підхід — фіксовані патерни спарсивної уваги, моделі простору станів, гібридні архітектури та DeepSeek Sparse Attention — і стверджує, що SSA уникає їхніх компромісів. Чи дійсно це так, залишається емпіричним питанням, яке може вирішити лише незалежна оцінка.

П’ятикратний засновник, колишній інженер Meta та 29 мільйонів доларів, щоб довести неправоту скептиків

Команда, що стоїть за цими заявами, має значення для їх оцінки. CEO Джастін Дангел (Justin Dangel) — п’ятикратний засновник та CEO з досвідом роботи у сферах медичних технологій, страхування та споживчих товарів; його компанії виросли до сотень співробітників, залучили інституційне фінансування та досягли ліквідності. CTO Олександр Ведон раніше працював інженером-програмістом у Meta та був керівником напрямку генеративного ШІ в TribeAI, де керував понад 40 корпоративними впровадженнями ШІ.

До команди входять 11 дослідників з докторським ступенем, які мають досвід роботи в Meta, Google, Oxford, Cambridge, ByteDance та Adobe. Це переконливий набір талантів для дослідницьких зусиль на рівні архітектури. Однак жоден зі співзасновників не публікував фундаментальних досліджень у сфері ШІ, і компанія ще не випустила рецензовану статтю. Технічний звіт “незабаром з’явиться”.

Профіль фінансування є незвичним для компанії, що робить передові заяви щодо ШІ. Subquadratic залучила 29 мільйонів доларів при заявленій оцінці в 500 мільйонів доларів — це висока ціна для компанії на початковій стадії з відсутністю публічно доступної моделі, рецензованих досліджень та доходу. Інвесторська база, яку очолив співзасновник Tinder Матін та колишній партнер SoftBank Вільямізар, схиляється до споживчих технологій та інвестицій у зростання, а не до глибоких технічних досліджень у сфері ШІ. Компанія не відкриває вихідні ваги, але планує запропонувати корпоративним клієнтам інструменти для власного доналаштування, а також встановила цільовий показник контекстного вікна у 50 мільйонів токенів на IV квартал.

Справжній тест для SubQ — це не тести, а те, чи витримає математика незалежну перевірку

Відкинувши маркетингову мову та драму в соціальних мережах, ключове питання, яке ставить Subquadratic, є справді важливим: чи можуть системи ШІ звільнитися від квадратичного масштабування, не жертвуючи якістю, яка робить їх корисними?

Ставки величезні. Якщо увагу можна зробити справді лінійною без деградації вилучення та міркувань, економіка ШІ фундаментально зміниться. Корпоративні застосунки, які сьогодні вимагають складних конвеєрів вилучення — обробка цілих кодових баз, контрактів, нормативних документів, медичних записів — стануть операціями одного проходу. Мільярди доларів, що наразі витрачаються на інфраструктуру RAG, управління контекстом та оркестрацію агентів, стануть частково надлишковими.

Готовність Ведона публічно взаємодіяти з технічною критикою — опублікувавши технічний блог протягом кількох годин після негативної реакції — свідчить про команду, яка розуміє необхідність показати свою роботу, а не лише описати її. І, слід віддати належне, компанія відкрито визнала, що вона будує на відкритих основах і що її модель менша за ті, що є у великих лабораторій.

Кожна передова модель у 2026 році рекламує контекстне вікно щонайменше на мільйон токенів, але майже жодна з них не вміє ефективно використовувати всю цю інформацію. Розрив між номінальним контекстним вікном та функціональним — між тим, що модель приймає, і тим, над чим вона надійно міркує — залишається однією з найважливіших невирішених проблем у сфері ШІ. Subquadratic стверджує, що подолала цей розрив. Якщо незалежна оцінка підтвердить це твердження, наслідки випливуть далеко за межі оцінки однієї стартап-компанії. Якщо ні, компанія приєднається до зростаючого списку обіцянок щодо довгого контексту, які звучали революційно в день запуску і були непримітними через шість місяців.

У обчислювальній техніці кожне фундаментальне обмеження з часом падає. Коли це відбувається, прорив ніколи не приходить з того боку, якого очікує індустрія. Питання, що висить над Subquadratic, полягає в тому, чи команда з 11 докторів наук та посівний раунд у 29 мільйонів доларів справді знайшли відповідь, яка ухилялася від організацій, що витрачають у тисячі разів більше — чи вони просто знайшли кращий спосіб описати проблему.

Прогноз ІТ-Блогу: Революційні зміни в обчислювальній ефективності великих мовних моделей можуть призвести до суттєвого зниження витрат на їх розгортання та використання. Якщо Subquadratic зможе довести свою архітектуру, це може стимулювати нову хвилю інновацій у розробці програмного забезпечення, де обробка величезних обсягів даних стане доступнішою.

Оригінал статті: venturebeat.com