Чи Китай повертає собі естафету відкритого програмного забезпечення в галузі штучного інтелекту?

Компанія Z.ai, також відома як Zhupai AI, китайський стартап у сфері ШІ, що здобув популярність завдяки потужній лінійці моделей GLM з відкритим кодом, представила сьогодні GLM-5.1 під ліцензією MIT. Це дозволяє підприємствам завантажувати, налаштовувати та використовувати модель у комерційних цілях. Доступ до неї надається через платформу Hugging Face.

Це відбувається невдовзі після випуску минулого місяця GLM-5 Turbo – пришвидшеної версії, доступної лише за пропрієтарною ліцензією.

Нова GLM-5.1 розроблена для автономної роботи до восьми годин над одним завданням, що свідчить про чіткий перехід від “вібраційного кодування” до інженерії на основі агентів.

Цей реліз є поворотним моментом в еволюції штучного інтелекту. Поки конкуренти зосереджувалися на збільшенні кількості токенів для кращої логіки, Z.ai оптимізує моделі для тривалої продуктивної роботи.

GLM-5.1 – це модель Mixture-of-Experts (MoE) із 754 мільярдами параметрів, створена для підтримки узгодженості цілей протягом тривалих періодів виконання, що охоплюють тисячі викликів інструментів.

“Агенти могли виконувати близько 20 кроків до кінця минулого року”, – написав Лу, керівник Z.ai, у X. “GLM-5.1 зараз може виконати 1700. Автономний час роботи може бути найважливішою кривою після законів масштабування. GLM-5.1 буде першою точкою на цій кривій, яку спільнота відкритого коду зможе перевірити своїми руками. Сподіваюся, вам сподобається ^^”.

На ринку, що дедалі більше насичується швидкими моделями, Z.ai робить ставку на “марафонця”. Компанія, яка вийшла на біржу в Гонконзі на початку 2026 року з ринковою капіталізацією 52,83 мільярда доларів, використовує цей реліз для зміцнення своїх позицій як провідного незалежного розробника великих мовних моделей у регіоні.

Технологія: “сходовий” патерн оптимізації

Основний технологічний прорив GLM-5.1 – це не лише її масштаби, хоча 754 мільярди параметрів і контекстне вікно на 202 752 токени є вражаючими, а її здатність уникати ефекту плато, що спостерігався в попередніх моделях.

У традиційних робочих процесах на основі агентів модель зазвичай застосовує кілька знайомих технік для швидкого початкового прогресу, а потім зупиняється. Надання їй більше часу або більше викликів інструментів зазвичай призводить до зменшення віддачі або відхилення від стратегії.

Дослідження Z.ai демонструють, що GLM-5.1 працює за так званим “сходовим” патерном, який характеризується періодами поступового налаштування в межах фіксованої стратегії, перериваними структурними змінами, що розширюють межі продуктивності.

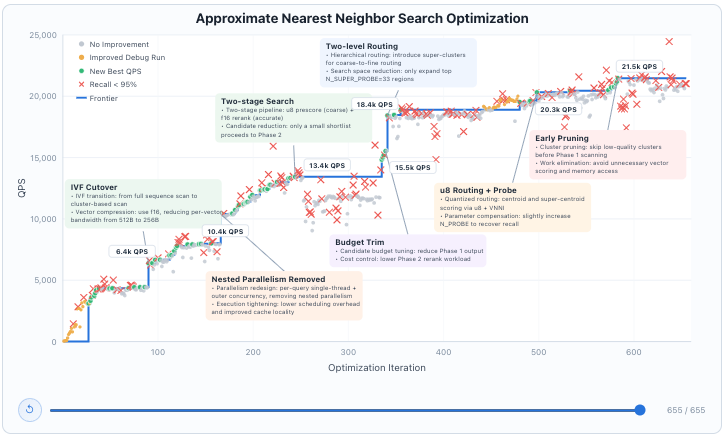

У Сценарії 1 свого технічного звіту моделі було доручено оптимізувати високопродуктивну векторну базу даних, завдання, відоме як VectorDBBench. Модель отримала скелет на Rust та порожні реалізації, після чого використовувала агентів на основі викликів інструментів для редагування коду, компіляції, тестування та профілювання.

Хоча попередні передові результати таких моделей, як Claude Opus 4.6, досягли стелі продуктивності в 3547 запитів на секунду, GLM-5.1 виконала 655 ітерацій і понад 6000 викликів інструментів. Траєкторія оптимізації не була лінійною, а позначена структурними проривами.

На 90-й ітерації модель перейшла від сканування всього корпусу до дослідження кластерів IVF з f16-стисненням векторів, що зменшило пропускну здатність на вектор з 512 байтів до 256 байтів і збільшило продуктивність до 6400 запитів на секунду.

До 240-ї ітерації вона самостійно впровадила двоступеневий конвеєр, що включав u8 попереднє ранжування та f16 повторне ранжування, досягнувши 13 400 запитів на секунду. Зрештою, модель ідентифікувала та усунула шість структурних вузьких місць, включаючи ієрархічну маршрутизацію через суперкластери та квантовану маршрутизацію за допомогою оцінки центроїдів через VNNI. Ці зусилля призвели до остаточного результату в 21 500 запитів на секунду, приблизно в шість разів більше, ніж найкращий результат, досягнутий за одну сесію з 50 ходів.

Це демонструє модель, яка функціонує як власний відділ досліджень і розробок, розбиваючи складні проблеми та проводячи експерименти з реальною точністю.

Модель також успішно здійснила складне вдосконалення виконання, знизивши накладні витрати на планування та покращивши локальність кешу. Під час оптимізації пошуку найближчих сусідів модель проактивно видалила вкладений паралелізм на користь редизайну з використанням однопотоковості на запит та зовнішньої паралельності.

Коли модель стикалася з ітераціями, де точність падала нижче 95-відсоткового порогу, вона діагностувала збій, коригувала свої параметри та впроваджувала компенсацію параметрів для відновлення необхідної точності. Цей рівень автономного виправлення відрізняє GLM-5.1 від моделей, які просто генерують код, не тестуючи його в реальному середовищі.

Kernelbench: розширення меж машинного навчання

Витривалість моделі була додатково протестована в KernelBench Level 3, який вимагає наскрізної оптимізації повних архітектур машинного навчання, таких як MobileNet, VGG, MiniGPT та Mamba.

У цьому сценарії мета полягає в тому, щоб створити швидший GPU-ядро, ніж референсна реалізація PyTorch, зберігаючи при цьому ідентичні виходи. Кожна з 50 задач виконується в ізольованому Docker-контейнері з одним GPU H100 і обмежена 1200 ходами використання інструментів. Правильність і продуктивність оцінюються порівняно з базовим PyTorch eager в окремих контекстах CUDA.

Результати підкреслюють значний розрив у продуктивності між GLM-5.1 та її попередниками. Хоча оригінальна GLM-5 швидко покращувалася, але рано вийшла на плато зі 2,6-красним прискоренням, GLM-5.1 значно довше підтримувала свої зусилля з оптимізації. Зрештою, вона забезпечила геометричне середнє прискорення в 3,6 рази за 50 задачами, продовжуючи досягати корисного прогресу далеко за межами 1000 ходів використання інструментів.

Хоча Claude Opus 4.6 залишається лідером у цьому конкретному бенчмарку з 4,2-кратним прискоренням, GLM-5.1 суттєво розширила продуктивний горизонт для моделей з відкритим кодом.

Ця здатність – це не просто довший контекст, а й здатність моделі підтримувати узгодженість цілей протягом тривалого виконання, зменшуючи відхилення від стратегії, накопичення помилок та неефективні спроби і помилки. Одним із ключових досягнень є здатність формувати автономний цикл експерименту, аналізу та оптимізації, де модель може проактивно запускати бенчмарки, ідентифікувати вузькі місця, коригувати стратегії та постійно покращувати результати шляхом ітеративного вдосконалення.

Усі рішення, згенеровані під час цього процесу, були незалежно перевірені на предмет експлуатації бенчмарків, що гарантує, що оптимізації не покладалися на специфічну поведінку бенчмарків, а працювали з довільними новими вхідними даними, зберігаючи обчислення на стандартному потоці CUDA.

Продуктова стратегія: підписка та субсидії

GLM-5.1 позиціонується як інструмент інженерного класу, а не споживчий чат-бот. Для підтримки цього Z.ai інтегрувала її в комплексну екосистему Coding Plan, розроблену для прямої конкуренції з висококласними інструментами для розробників.

Продуктова пропозиція поділена на три рівні підписки, кожен з яких включає безкоштовні інструменти Model Context Protocol для аналізу зображень, пошуку в Інтернеті, читання веб-сторінок та документів.

Рівень Lite за 27 доларів США на квартал призначений для легких навантажень і пропонує втричі більше використання, ніж порівнянний план Claude Pro. Рівень Pro за 81 долар на квартал розроблений для складних навантажень, пропонуючи вп’ятеро більше використання, ніж Lite, та на 40-60% швидше виконання.

Рівень Max за 216 доларів на квартал призначений для передових розробників з високим обсягом потреб, забезпечуючи гарантовану продуктивність у години пік.

Для тих, хто використовує API безпосередньо або через такі платформи, як OpenRouter чи Requesty, Z.ai встановила ціну на GLM-5.1 у розмірі 1,40 долара за мільйон вхідних токенів та 4,40 долара за мільйон вихідних токенів. Також доступна знижка на кеш за 0,26 долара за мільйон вхідних токенів.

|

Модель |

Вхід |

Вихід |

Загальна вартість |

Джерело |

|

Grok 4.1 Fast |

$0.20 |

$0.50 |

$0.70 |

xAI |

|

MiniMax M2.7 |

$0.30 |

$1.20 |

$1.50 |

MiniMax |

|

Gemini 3 Flash |

$0.50 |

$3.00 |

$3.50 |

|

|

Kimi-K2.5 |

$0.60 |

$3.00 |

$3.60 |

Moonshot |

|

MiMo-V2-Pro (≤256K) |

$1.00 |

$3.00 |

$4.00 |

Xiaomi MiMo |

|

GLM-5 |

$1.00 |

$3.20 |

$4.20 |

Z.ai |

|

GLM-5-Turbo |

$1.20 |

$4.00 |

$5.20 |

Z.ai |

|

GLM-5.1 |

$1.40 |

$4.40 |

$5.80 |

Z.ai |

|

Claude Haiku 4.5 |

$1.00 |

$5.00 |

$6.00 |

Anthropic |

|

Qwen3-Max |

$1.20 |

$6.00 |

$7.20 |

Alibaba Cloud |

|

Gemini 3 Pro |

$2.00 |

$12.00 |

$14.00 |

|

|

GPT-5.2 |

$1.75 |

$14.00 |

$15.75 |

OpenAI |

|

GPT-5.4 |

$2.50 |

$15.00 |

$17.50 |

OpenAI |

|

Claude Sonnet 4.5 |

$3.00 |

$15.00 |

$18.00 |

Anthropic |

|

Claude Opus 4.6 |

$5.00 |

$25.00 |

$30.00 |

Anthropic |

|

GPT-5.4 Pro |

$30.00 |

$180.00 |

$210.00 |

OpenAI |

Варто зазначити, що модель споживає квоту втричі швидше в години пік, які визначаються з 14:00 до 18:00 щодня за пекінським часом. Проте, обмежена за часом акція до квітня 2026 року дозволяє тарифікувати використання поза піковими годинами за стандартною ставкою 1x. На додаток до флагманської моделі, нещодавно дебютувала GLM-5 Turbo.

Якщо 5.1 – це марафонець, то Turbo – це спринтер. Пропрієтарна і оптимізована для швидкого висновку та таких завдань, як використання інструментів і постійна автоматизація.

За ціною 1,20 долара за мільйон вхідних токенів / 4 долари за мільйон вихідних токенів, вона дорожча за базову GLM-5, але дешевша за нову GLM-5.1. Це робить її комерційно привабливим варіантом для високошвидкісних контрольованих запусків агентів.

Модель також упакована для локального розгортання, підтримуючи фреймворки висновку, включаючи vLLM, SGLang та xLLM. Детальні інструкції з розгортання доступні в офіційному репозиторії GitHub, що дозволяє розробникам запускати 754-мільярдну модель MoE на власній інфраструктурі.

Для корпоративних команд модель включає розширені можливості міркування, доступні через параметр “thinking” у запитах API. Це дозволяє моделі демонструвати свій покроковий процес внутрішнього мислення перед наданням остаточної відповіді.

Бенчмарки: новий глобальний стандарт

Дані про продуктивність GLM-5.1 свідчать про те, що вона випередила кілька усталених західних моделей у завданнях програмування та інженерії.

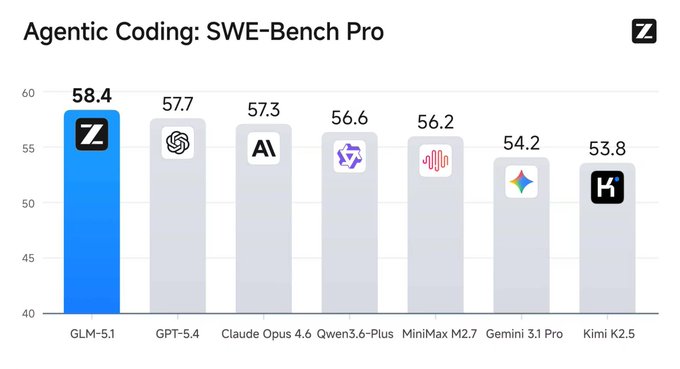

На SWE-Bench Pro, який оцінює здатність моделі вирішувати реальні проблеми GitHub за допомогою інструкцій та контекстного вікна на 200 000 токенів, GLM-5.1 досягла результату 58.4. Для контексту, це перевершує GPT-5.4 (57.7), Claude Opus 4.6 (57.3) та Gemini 3.1 Pro (54.2).

Окрім стандартизованих тестів кодування, модель продемонструвала значні покращення в бенчмарках міркування та агентної роботи. Вона отримала 63.5 балів на Terminal-Bench 2.0 при оцінці за допомогою фреймворку Terminus-2 і досягла 66.5 балів при використанні з Claude Code harness.

На CyberGym вона показала результат 68.7 на основі одного прогону через 1507 завдань, демонструючи майже 20-бальну перевагу над попередньою моделлю GLM-5. Модель також показала високі результати на публічному наборі MCP-Atlas з результатом 71.8 та 70.6 на T3-Bench.

У домені міркування вона отримала 31.0 балів на Humanitys Last Exam, що піднялося до 52.3, коли моделі дозволили використовувати зовнішні інструменти. На бенчмарку математичних змагань AIME 2026 вона досягла 95.3, тоді як на GPQA-Diamond для експертних наукових міркувань – 86.2.

Найбільш вражаючим анекдотичним бенчмарком був тест “Сценарій 3”: створення середовища робочого столу в стилі Linux з нуля за вісім годин.

На відміну від попередніх моделей, які могли б створити базовий панель завдань і вікно-заповнювач, оголосивши завдання завершеним, GLM-5.1 самостійно заповнила файловий менеджер, термінал, текстовий редактор, монітор системи і навіть функціональні ігри.

Вона ітеративно вдосконалювала логіку стилізації та взаємодії, доки не створила візуально узгоджений, функціональний веб-додаток. Це слугує конкретним прикладом того, що стає можливим, коли моделі надається час і можливість постійно вдосконалювати свою роботу.

Ліцензування та відкритий перехід

Ліцензування цих двох моделей відображає ширшу картину поточного стану світового ринку ШІ. GLM-5.1 випущено під ліцензією MIT, а її вагові коефіцієнти публічно доступні на Hugging Face та ModelScope.

Це відповідає історичній стратегії Z.ai використання випусків з відкритим кодом для побудови довіри розробників та розширення екосистеми. Однак GLM-5 Turbo залишається пропрієтарною та закритою. Це відображає зростаючу тенденцію серед провідних лабораторій ШІ до гібридної моделі: використання моделей з відкритим кодом для широкого розповсюдження, зберігаючи оптимізовані варіанти виконання за платним доступом.

Галузеві аналітики зазначають, що цей зсув відбувається на тлі перебалансування на китайському ринку, де такі гіганти, як Alibaba, також починають сегментувати свою пропрієтарну роботу від відкритих випусків.

Генеральний директор Z.ai Чжан Пен, схоже, навігує цим, забезпечуючи, щоб, хоча основний інтелект флагманської моделі є відкритим для спільноти, високошвидкісна виконавча інфраструктура залишається активом, що генерує дохід.

Компанія не обіцяє явно відкрити GLM-5 Turbo, але заявляє, що результати досліджень будуть включені в майбутні відкриті випуски. Така сегментована стратегія допомагає стимулювати прийняття, одночасно дозволяючи компанії будувати стійку бізнес-модель навколо своєї найбільш комерційно актуальної роботи.

Реакція спільноти та користувачів: тиждень роботи за два дні

Реакція спільноти розробників на випуск GLM-5.1 була переважно зосереджена на надійності моделі в продакшн-середовищах.

Відгуки користувачів свідчать про високий ступінь довіри до автономності моделі.

Один розробник зазначив, що GLM-5.1 їх вразила своєю якістю, заявивши, що вона, здається, робить те, що вони хочуть, надійніше, ніж інші моделі, з меншою кількістю переробок промптів. Інший розробник зазначив, що загальний робочий процес моделі від планування до виконання проєкту працює чудово, дозволяючи їм впевнено довіряти їй складні завдання.

Конкретні приклади від користувачів висвітлюють значне підвищення ефективності.

Користувач з Crypto Economy News повідомив, що завдання, яке включало попередню обробку коду, логіку вибору ознак та рішення щодо налаштування гіперпараметрів, яке спочатку зайняло б тиждень, було виконано всього за два дні. З моменту придбання плану GLM Coding інші розробники відзначили, що можуть працювати вільніше та зосереджуватися на основній розробці, не турбуючись про брак ресурсів, що перешкоджає прогресу.

У соціальних мережах анонс запуску за першу годину зібрав понад 46 000 переглядів, користувачі були захоплені твердженням про восьмигодинну автономність. Настрої серед ранніх послідовників такі: Z.ai успішно подолала еру ШІ, сповнену галюцинацій, і перейшла до періоду, коли моделям можна довіряти самостійну оптимізацію через повторні ітерації.

Можливість швидко створювати чотири додатки за допомогою правильних промптів та структурованого планування була названа багатьма користувачами як революційна розробка для індивідуальних розробників.

Наслідки роботи на довгих дистанціях

Випуск GLM-5.1 свідчить про те, що наступний рубіж конкуренції в галузі ШІ буде вимірюватися не в токенах за секунду, а в тривалості автономної роботи.

Якщо модель може працювати вісім годин без втручання людини, це фундаментально змінює життєвий цикл розробки програмного забезпечення.

Однак Z.ai визнає, що це лише початок. Залишаються значні виклики, такі як розробка надійної самооцінки для завдань, де немає числової метрики для оптимізації.

Раннє вивільнення з локальних оптимумів, коли поступове налаштування припиняє приносити користь, є ще однією серйозною перешкодою, як і підтримка узгодженості протягом траєкторій виконання, що охоплюють тисячі викликів інструментів.

Наразі Z.ai встановила позначку. З GLM-5.1 вони надали модель, яка не просто відповідає на запитання, а завершує проєкти. Модель вже сумісна з широким спектром інструментів розробника, включаючи Claude Code, OpenCode, Kilo Code, Roo Code, Cline та Droid.

Для розробників та підприємств питання полягає вже не в тому, “що я можу запитати у цього ШІ?”, а в тому, “що я можу доручити йому на наступні вісім годин?”.

Фокус галузі чітко зміщується до систем, які можуть надійно виконувати багатоетапну роботу з меншим наглядом. Цей перехід до агентної інженерії знаменує новий етап у розгортанні штучного інтелекту в світовій економіці.

Прогноз ІТ-Блогу: GLM-5.1, як представник нового покоління автономних агентів, ймовірно, стимулюватиме розвиток інструментів для оркестрації складних робочих процесів, що включають тривалу взаємодію з користувачем та іншими системами. Очікується зростання конкуренції у сфері “довгострокової інженерії ШІ”, де ключовим стане показник не лише швидкості, а й стійкої продуктивності та самостійного вирішення проблем.

Інформація підготовлена на основі матеріалів: venturebeat.com