Системи штучного інтелекту, здатні сприймати та аналізувати відеопотік у реальному часі, становлять значний інтерес для підприємств та організацій. Такі можливості виходять далеко за межі простого відеоспостереження, охоплюючи створення привабливих маркетингових матеріалів шляхом виділення ключових моментів, ідентифікацію невідповідностей та помилок у відеоконтенті, а також аналіз мови тіла та поведінки учасників у наукових дослідженнях чи під час відбору кандидатів. Хоча подібні рішення вже існують, вони ще не набули широкого розповсюдження. Компанія Perceptron Inc., заснована два роки тому, і очолювана колишніми дослідниками Meta FAIR та Microsoft, прагне змінити цю ситуацію. Нещодавно вони представили свою флагманську модель відеоаналізу Mk1 (“Mark One”), яка пропонується за ціною $0.15 за мільйон вхідних токенів та $1.50 за мільйон вихідних токенів через API. Ця вартість приблизно на 80-90% нижча, ніж у провідних конкурентів, таких як Anthropic Claude 3.5 Sonnet, OpenAI GPT-4o та Google Gemini 1.5.

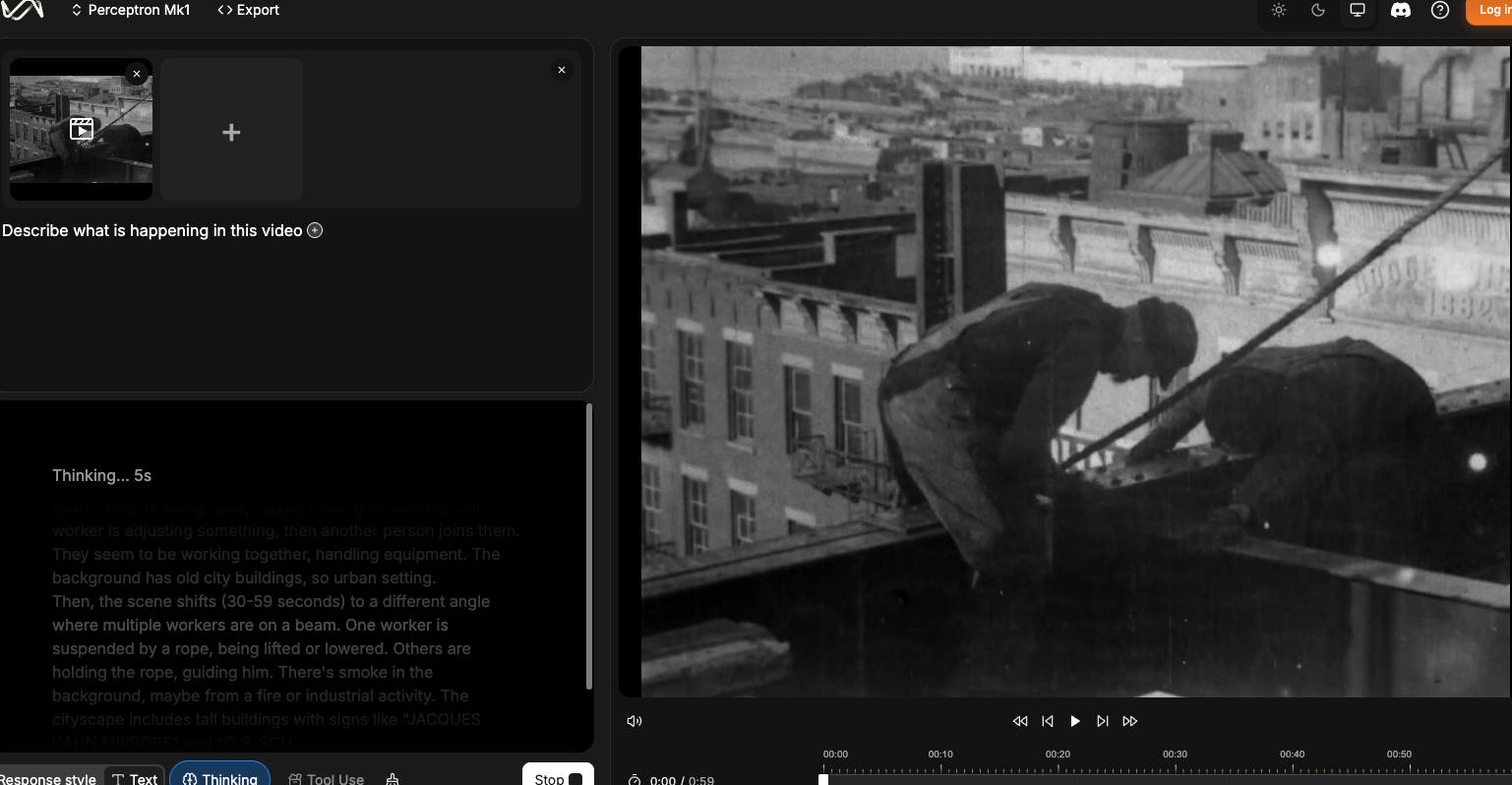

Розробка моделі Mk1, яка тривала 16 місяців, спрямована на подолання складнощів, пов’язаних з аналізом реального світу. Цей реліз знаменує собою новий етап, коли від моделей очікується розуміння причинно-наслідкових зв’язків, динаміки об’єктів та законів фізики з такою ж легкістю, з якою вони раніше оперували мовою. Зацікавлені користувачі та потенційні корпоративні клієнти можуть ознайомитися з можливостями моделі на демо-сайті Perceptron.

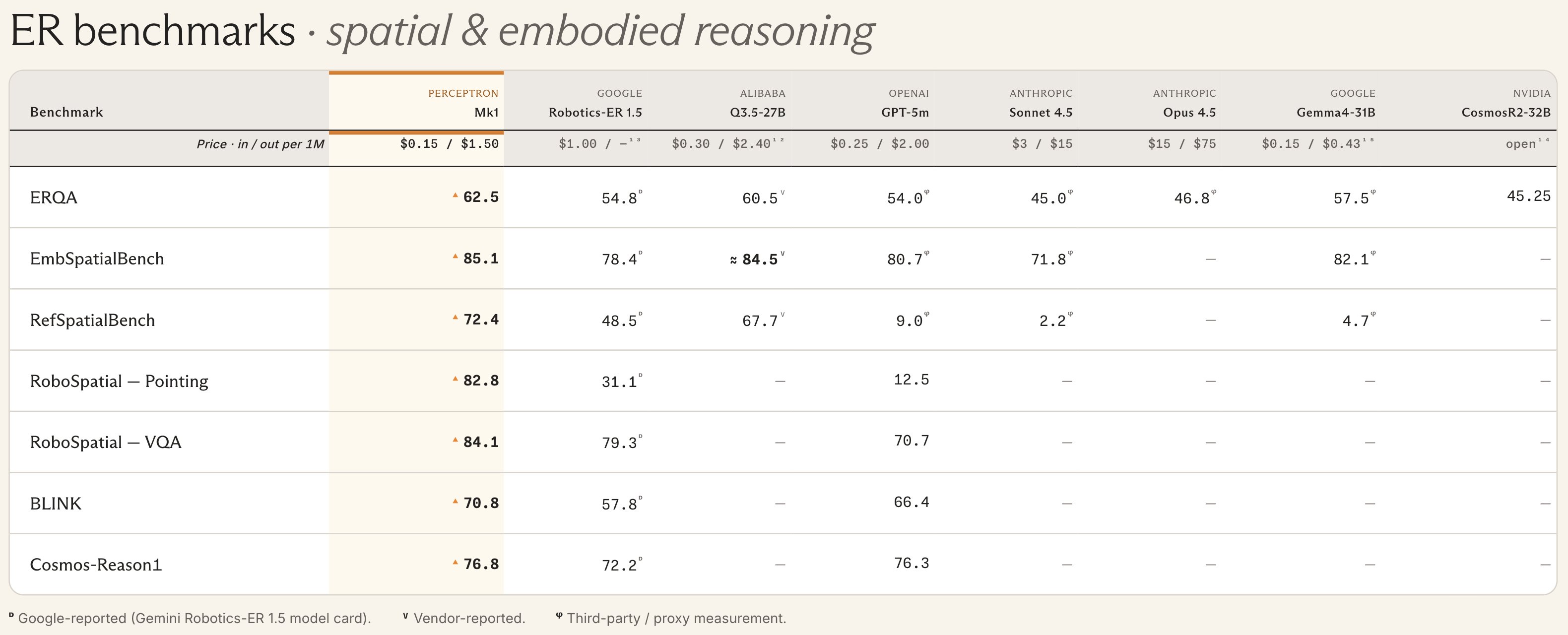

Ефективність у просторових та відео тестах

Продуктивність моделі Mk1 підтверджується низкою галузевих тестів, що фокусуються на глибинному розумінні.

- EmbSpatialBench (просторове міркування): Mk1 досягла показника 85.1, перевищивши результати Google Robotics-ER 1.5 (78.4) та Alibaba Q3.5-27B (близько 84.5).

- RefSpatialBench (розпізнавання виразів): Оцінка 72.4 є значним стрибком порівняно з конкурентами, такими як GPT-4o (9.0) та Claude 3.5 Sonnet (2.2), демонструючи перевагу у розумінні референсних виразів.

Аналогічні результати демонструють і відео тести. На складному наборі даних EgoSchema “Hard Subset”, де початковий та кінцевий кадри недостатньо для аналізу, Mk1 отримала 41.4 бали, що відповідає показнику Alibaba Q3.5-27B і значно випереджає Gemini 1.5 Flash-Lite (25.0). На тесті VSI-Bench модель досягла 88.5 балів — найвищого показника серед порівнюваних систем, що підтверджує її здатність до комплексного аналізу часових послідовностей.

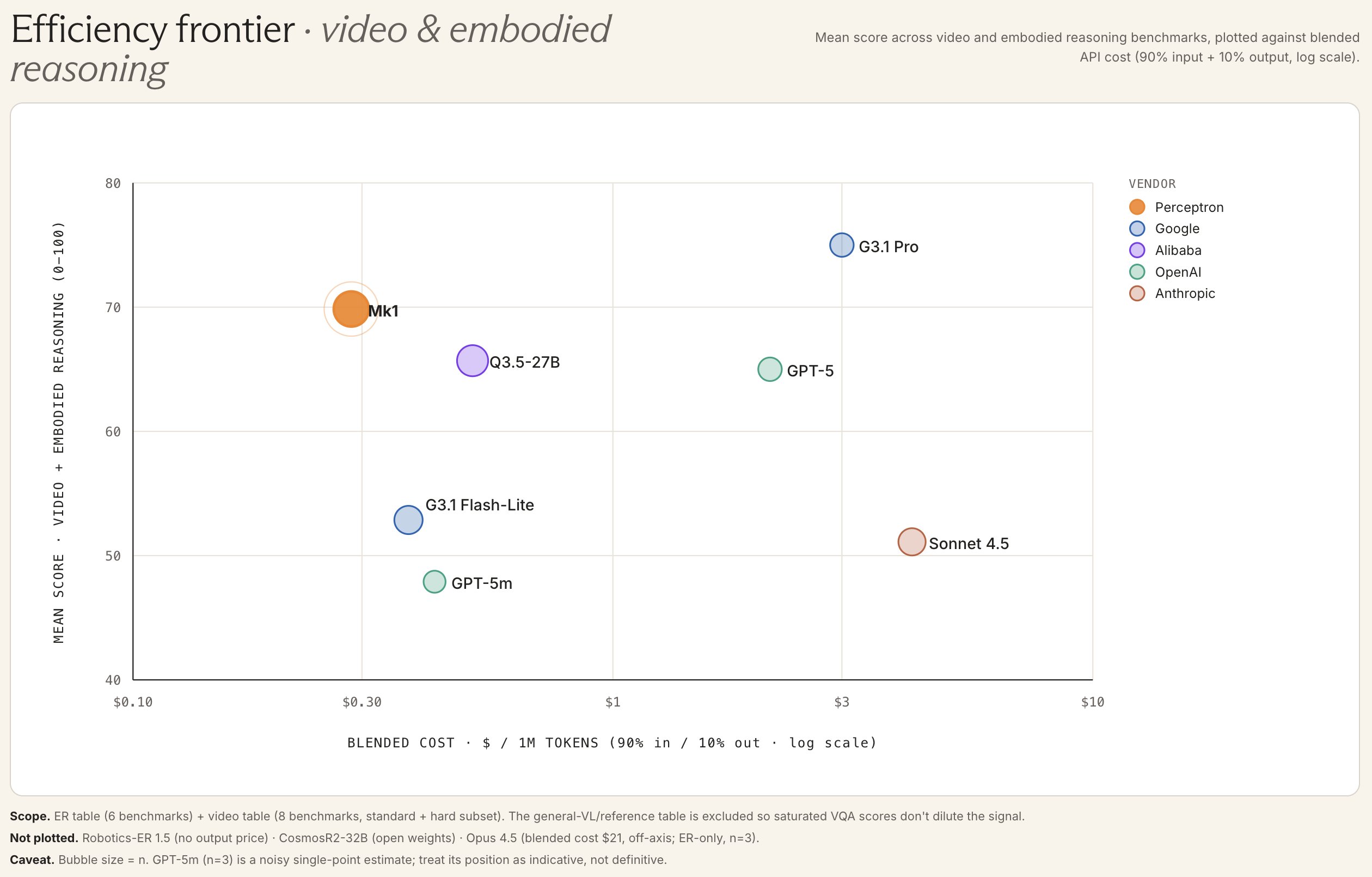

Позиціонування на ринку та ефективність

Perceptron свідомо орієнтується на “межу ефективності” (Efficiency Frontier) – показник, що співвідносить середні бали за тестами відео- та просторового міркування з вартістю обробки мільйона токенів. Дані показують, що Mk1 займає унікальну нішу: вона не поступається за продуктивністю передовим моделям, таким як GPT-4o та Gemini 1.5 Pro, але при цьому коштує як “Light” або “Flash” версії. Зокрема, вартість Perceptron Mk1 становить $0.15 за мільйон вхідних токенів і $1.50 за мільйон вихідних. На противагу цьому, GPT-4o має значно вищу вартість (близько $2.00), а Gemini 1.5 Pro – близько $3.00. Mk1 ж пропонується за $0.30 за змішану вартість, демонструючи при цьому кращі показники міркування. Така агресивна цінова політика спрямована на забезпечення доступності високоякісного “фізичного” ШІ для промислового застосування, а не лише для дослідницьких цілей.

Архітектура та часова зв’язність

Технічним ядром Perceptron Mk1 є здатність обробляти відео зі швидкістю до 2 кадрів на секунду (FPS) у межах контекстного вікна 32K токенів. На відміну від традиційних мультимодальних моделей, які розглядають відео як послідовність окремих зображень, Mk1 забезпечує часову зв’язність. Це дозволяє моделі аналізувати тривалі відеопотоки, зберігаючи ідентичність об’єктів навіть при їх тимчасовому зникненні з поля зору, що є критично важливим для робототехніки та систем безпеки. Розробники можуть запитувати модель щодо конкретних моментів у тривалому відео та отримувати структуровані часові позначки, що спрощує виділення фрагментів та виявлення подій.

Міркування на основі законів фізики

Ключовою особливістю Mk1 є її здатність до “фізичного міркування”. Perceptron визначає це як високоточну просторову обізнаність, що дозволяє моделі розуміти динаміку об’єктів та фізичні взаємодії у реальних умовах. Наприклад, модель може проаналізувати сцену, щоб визначити, чи був зроблений баскетбольний кидок до чи після фінальної сирени, одночасно аналізуючи положення м’яча в повітрі та показники на баскетбольному табло. Це вимагає не просто розпізнавання образів, а й розуміння того, як об’єкти взаємодіють у просторі та часі. Модель здатна з “піксельною точністю” визначати розташування та підраховувати об’єкти навіть у щільних, складних сценах (до сотень одиниць). Вона також може зчитувати показники аналогових приладів та годинників, що історично було складним завданням для цифрових систем зору. Крім того, модель демонструє глибокі знання про світ та історію. Під час тестування було завантажено відео з архіву Бібліотеки Конгресу США, що документує будівництво хмарочосів у Нью-Йорку на початку 1900-х років. Mk1 не тільки точно описала зміст відео, включаючи незвичайні моменти, як-от робітники, підвішені на канатах, але й зробила це швидко, а також правильно визначила приблизний період (початок 20-го століття) виключно на основі візуальних ознак.

Платформа для розробників “фізичного” ШІ

Разом із випуском моделі Perceptron пропонує розширену платформу для розробників, яка дозволяє перетворювати можливості сприйняття на функціональні застосунки з мінімальним кодуванням. SDK Perceptron, доступний через Python, містить спеціалізовані функції, такі як “Focus” (фокусування), “Counting” (підрахунок) та “In-Context Learning” (навчання в контексті). Функція “Focus” дозволяє автоматично масштабувати та кадрувати певні ділянки зображення на основі запиту природною мовою, наприклад, для виявлення та локалізації засобів індивідуального захисту (ЗІЗ) на будівельному майданчику. Функція “Counting” оптимізована для щільних сцен, дозволяючи ідентифікувати та вказувати на кожен об’єкт, наприклад, цуценя в групі або одиницю сільськогосподарської продукції. Платформа також підтримує “навчання в контексті”, що дає можливість розробникам адаптувати Mk1 до специфічних завдань, надавши лише кілька прикладів.

Ліцензування та серія Isaac

Perceptron застосовує подвійну стратегію щодо ваг моделі та ліцензування. Флагманська модель Perceptron Mk1 є закритим програмним забезпеченням, доступним через API, і призначена для корпоративного використання з високим рівнем безпеки. Водночас компанія продовжує розвивати серію “Isaac”, яка розпочалася з випуску Isaac 0.1 у вересні 2025 року, як альтернативу з відкритими вагами. Isaac 0.2-2b-preview, випущений у грудні 2025 року, є 2-мільярдною моделлю для обробки зорової інформації та тексту з можливостями міркування, доступною для розгортання на периферійних пристроях з низькою затримкою. Хоча ваги моделей Isaac є відкритими на платформі Hugging Face, Perceptron пропонує комерційні ліцензії для компаній, яким потрібен максимальний контроль або розгортання моделей на власних серверах. Цей підхід дозволяє компанії підтримувати як спільноту відкритого програмного забезпечення, так і промислових партнерів, які потребують гнучкості. Документація вказує, що моделі Isaac 0.2 оптимізовані для часу до першого токена менше 200 мс, що робить їх ідеальними для пристроїв реального часу.

Заснування Perceptron та основний фокус

Perceptron AI – це стартап із Вашингтона, що спеціалізується на “фізичному” ШІ. Його засновниками є Армен Агаджанян (Armen Aghajanyan) та Акшат Шрівастава (Akshat Shrivastava), обидва колишні наукові співробітники лабораторії Facebook AI Research (FAIR) від Meta. Публічні матеріали компанії датують її заснування листопадом 2024 року, хоча документи компанії вказують на більш ранню дату реєстрації (9 жовтня 2024 року). Засновниками були опубліковані повідомлення, де Агаджанян зазначав, що залишив Meta після майже шести років, щоб “об’єднати зусилля” зі Шріваставою для створення ШІ для фізичного світу. Шрівастава, у свою чергу, повідомив, що компанія виросла з його роботи над ефективністю, мультимодальністю та новими архітектурами моделей. Заснування компанії, ймовірно, стало прямим продовженням їхньої роботи над мультимодальними фундаментальними моделями в Meta. У травні 2024 року дослідники Meta представили Chameleon – сімейство моделей раннього злиття, призначених для обробки та генерації змішаних послідовностей тексту та зображень. Perceptron описує цю роботу як частину генеалогії своїх власних моделей. У наступній публікації в липні 2024 року, MoMa, досліджувався більш ефективний тренінг для змішаних мультимодальних моделей, де серед авторів були і Шрівастава, і Агаджанян. Perceptron розширює цей напрямок досліджень на “фізичний ШІ” – моделі, здатні обробляти відео та інші сенсорні потоки реального світу для таких застосувань, як робототехніка, виробництво, геопросторовий аналіз, безпека та модерація контенту.

Партнерські екосистеми та майбутні перспективи

Вплив Mk1 на реальний світ вже демонструється через партнерську мережу Perceptron. Ранні користувачі використовують модель для різних завдань, наприклад, автоматичного виділення ключових моментів у прямих трансляціях спортивних подій, використовуючи її часове розуміння для визначення важливих ігрових епізодів без втручання людини. У сфері робототехніки партнери використовують модель для формування епізодів телеоперації в навчальні дані, автоматизуючи процес маркування та очищення даних для роботизованих маніпуляторів та мобільних платформ. Серед інших застосувань – мультмодальні системи контролю якості на виробничих лініях, які можуть виявляти дефекти та перевіряти етапи складання в реальному часі, а також допоміжні системи для носіння на смарт-окулярах, що надають контекстно-залежну допомогу користувачам. Агаджанян зазначив, що ці релізи є кульмінацією досліджень, спрямованих на максимальну ефективність ШІ у фізичному світі, рухаючись до майбутнього, де “фізичний ШІ” буде таким же поширеним, як і цифровий.

Прогноз ІТ-Блогу: Модель Perceptron Mk1, завдяки своїй здатності до глибокого розуміння фізичних взаємодій та конкурентній ціні, ймовірно, стимулюватиме розвиток нових робототехнічних та промислових застосувань. Ми очікуємо, що протягом наступних 1-2 років ми побачимо значне зростання інтересу до “фізичного ШІ” з боку великих виробничих компаній та розробників автономних систем.

За даними порталу: venturebeat.com