Системи з кількома агентами, призначені для виконання довгострокових завдань, таких як інженерне програмне забезпечення або сортування кібербезпекових інцидентів, можуть генерувати до 15 разів більше токенів, ніж стандартні чати, що ставить під загрозу їхню економічну ефективність для корпоративних завдань. Однак сьогодні Nvidia прагне вирішити цю проблему, представивши Nemotron 3 Super — гібридну модель зі 120 мільярдами параметрів, ваги якої опубліковано на Hugging Face.

Об’єднуючи різні архітектурні філософії — моделі простору станів, трансформери та нову конструкцію “Latent” mixture-of-experts — Nvidia намагається забезпечити спеціалізовану глибину, необхідну для роботи агентів, без надмірного обсягу, типового для щільних моделей міркувань. Усе це доступно для комерційного використання здебільшого відкритими вагами.

Потрійна гібридна архітектура

В основі Nemotron 3 Super лежить витончена архітектурна тріада, яка балансує між ефективністю використання пам’яті та точністю міркувань. Модель використовує гібридний каркас Mamba-Transformer, який чергує шари Mamba-2 зі стратегічними шарами трансформерної уваги.

Щоб зрозуміти наслідки для корпоративного виробництва, розглянемо проблему “голки в копиці сіна”. Шари Mamba-2 діють як система “швидкісних” автомагістралей, обробляючи переважну більшість послідовностей із лінійною часовою складністю. Це дозволяє моделі підтримувати величезне контекстне вікно в 1 мільйон токенів без вибухового зростання обсягу пам’яті KV-кешу. Однак чисті моделі простору станів часто мають труднощі з асоціативним пригадуванням.

Щоб це виправити, Nvidia стратегічно вставляє шари трансформерної уваги як “глобальні якорі”, забезпечуючи точне вилучення конкретних фактів, прихованих глибоко в кодовій базі або стопках фінансових звітів.

Крім каркаса, модель впроваджує Latent Mixture-of-Experts (LatentMoE). Традиційні конструкції Mixture-of-Experts (MoE) направляють токени до експертів у їхній повній прихованій розмірності, що створює обчислювальний вузьке місце при масштабуванні моделей. LatentMoE вирішує цю проблему, проеціюючи токени в стиснутий простір перед направленням до спеціалістів.

Така “компресія експертів” дозволяє моделі звертатися до вчетверо більшої кількості спеціалістів за тієї самої обчислювальної вартості. Ця деталізація є життєво важливою для агентів, які повинні перемикатися між синтаксисом Python, логікою SQL та розмовними міркуваннями протягом одного запиту.

Додаткове прискорення моделі забезпечує Multi-Token Prediction (MTP). У той час як стандартні моделі передбачають один наступний токен, MTP одночасно передбачає кілька майбутніх токенів. Це слугує “вбудованою моделлю чернетки”, що забезпечує нативне спекулятивне декодування, яке може прискорити генерацію структурованих даних, таких як код або виклики інструментів, до 3 разів.

Перевага Blackwell

Для підприємств найзначнішим технічним стрибком у Nemotron 3 Super є його оптимізація під платформу GPU Nvidia Blackwell. Попередньо навчаючи модель нативно у форматі NVFP4 (4-бітне число з плаваючою комою), Nvidia досягла прориву в ефективності виробництва.

На Blackwell модель забезпечує в 4 рази швидше виведення, ніж 8-бітні моделі, що працюють на попередній архітектурі Hopper, без втрати точності.

З точки зору практичної продуктивності, Nemotron 3 Super є спеціалізованим інструментом для агентних міркувань.

Наразі вона посідає перше місце в DeepResearch Bench — бенчмарку, що вимірює здатність ШІ проводити ретельні, багатоетапні дослідження великих наборів документів.

|

Бенчмарк |

Nemotron 3 Super |

Qwen3.5-122B-A10B |

GPT-OSS-120B |

|

Загальні знання |

|||

|

MMLU-Pro |

83.73 |

86.70 |

81.00 |

|

Міркування |

|||

|

AIME25 (без інструментів) |

90.21 |

90.36 |

92.50 |

|

HMMT Feb25 (без інструментів) |

93.67 |

91.40 |

90.00 |

|

HMMT Feb25 (з інструментами) |

94.73 |

89.55 |

— |

|

GPQA (без інструментів) |

79.23 |

86.60 |

80.10 |

|

GPQA (з інструментами) |

82.70 |

— |

80.09 |

|

LiveCodeBench (v5 2024-07↔2024-12) |

81.19 |

78.93 |

88.00 |

|

SciCode (підзадача) |

42.05 |

42.00 |

39.00 |

|

HLE (без інструментів) |

18.26 |

25.30 |

14.90 |

|

HLE (з інструментами) |

22.82 |

— |

19.0 |

|

Агентні |

|||

|

Terminal Bench (складна підмножина) |

25.78 |

26.80 |

24.00 |

|

Terminal Bench Core 2.0 |

31.00 |

37.50 |

18.70 |

|

SWE-Bench (OpenHands) |

60.47 |

66.40 |

41.9 |

|

SWE-Bench (OpenCode) |

59.20 |

67.40 |

— |

|

SWE-Bench (Codex) |

53.73 |

61.20 |

— |

|

SWE-Bench Multilingual (OpenHands) |

45.78 |

— |

30.80 |

|

TauBench V2 |

|||

|

Airline |

56.25 |

66.0 |

49.2 |

|

Retail |

62.83 |

62.6 |

67.80 |

|

Telecom |

64.36 |

95.00 |

66.00 |

|

Середнє |

61.15 |

74.53 |

61.0 |

|

BrowseComp with Search |

31.28 |

— |

33.89 |

|

BIRD Bench |

41.80 |

— |

38.25 |

|

Чат та виконання інструкцій |

|||

|

IFBench (prompt) |

72.56 |

73.77 |

68.32 |

|

Scale AI Multi-Challenge |

55.23 |

61.50 |

58.29 |

|

Arena-Hard-V2 |

73.88 |

75.15 |

90.26 |

|

Довгий контекст |

|||

|

AA-LCR |

58.31 |

66.90 |

51.00 |

|

RULER @ 256k |

96.30 |

96.74 |

52.30 |

|

RULER @ 512k |

95.67 |

95.95 |

46.70 |

|

RULER @ 1M |

91.75 |

91.33 |

22.30 |

|

Багатомовність |

|||

|

MMLU-ProX (середнє за мовами) |

79.36 |

85.06 |

76.59 |

|

WMT24++ (en→xx) |

86.67 |

87.84 |

88.89 |

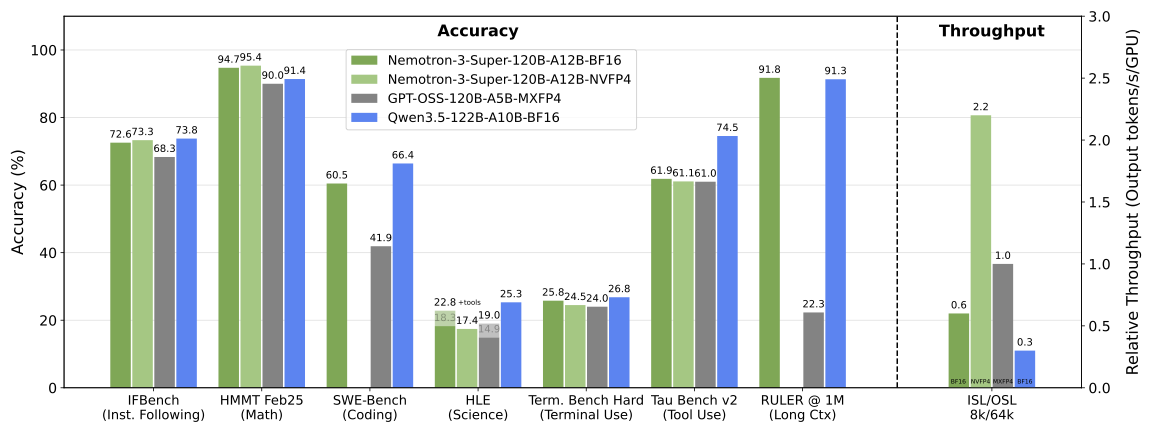

Вона також демонструє значні переваги у пропускній здатності, досягаючи до 2.2 рази вищої пропускної здатності, ніж gpt-oss-120B, і в 7.5 рази вищої, ніж Qwen3.5-122B, у сценаріях з високим обсягом.

Спеціальна ліцензія «відкрита» — комерційне використання, але з важливими застереженнями

Випуск Nemotron 3 Super під ліцензією Nvidia Open Model License Agreement (оновленою у жовтні 2025 року) передбачає гнучку основу для корпоративного впровадження, хоча й містить чіткі “захисні” пункти, які відрізняють її від суто відкритих ліцензій, таких як MIT або Apache 2.0.

Ключові положення для корпоративних користувачів:

-

Комерційна придатність: Ліцензія явно вказує, що моделі є “комерційно придатними” та надає вічну, всесвітню, безкоштовну ліцензію на продаж та розповсюдження продуктів, створених на основі моделі.

-

Право власності на вихідні дані: Nvidia не претендує на права власності щодо вихідних даних, згенерованих моделлю; відповідальність за ці вихідні дані та права власності на них повністю покладаються на користувача.

-

Похідні роботи: Підприємства мають право створювати та володіти “Похідними моделями” (доналаштованими версіями), за умови включення необхідного повідомлення про атрибуцію: “Ліцензовано Nvidia Corporation за Nvidia Open Model License.”

“Червоні лінії”:

Ліцензія містить два критичні тригери припинення, за якими мають стежити виробничі команди:

-

Запобіжні заходи безпеки: Ліцензія автоматично припиняється, якщо користувач обходить або уникає “Запобіжних заходів” моделі (технічні обмеження або гіперпараметри безпеки) без впровадження “суттєво подібної” заміни, що відповідає конкретному випадку використання.

-

Судовий тригер: Якщо користувач ініціює судовий процес щодо авторських прав або патентів проти Nvidia, стверджуючи, що модель порушує їхні інтелектуальні права, його ліцензія на використання моделі негайно припиняється.

Така структура дозволяє Nvidia сприяти розвитку комерційної екосистеми, одночасно захищаючи себе від “інтелектуального тролінгу” та гарантуючи, що модель не буде позбавлена функцій безпеки для зловмисного використання.

“Команда справді постаралася”

Реліз викликав значний ажіотаж у спільноті розробників. Кріс Алексюк, старший інженер з продуктових досліджень у Nvidia, відзначив запуск у X під своїм нікнеймом @llm_wizard як “SUPER DAY”, наголошуючи на швидкості та прозорості моделі. “Модель: ШВИДКА. Модель: РОЗУМНА. Модель: НАЙБІЛЬШ ВІДКРИТА МОДЕЛЬ, ЯКУ МИ КОЛИ-НЕБУДЬ РОБИЛИ,” — написав Кріс, підкреслюючи випуск не лише ваг, а й 10 трильйонів токенів навчальних даних та рецептів.

Промислове впровадження відображає цей ентузіазм:

-

Хмара та обладнання: Модель розгортається як мікросервіс Nvidia NIM, що дозволяє їй працювати локально через Dell AI Factory або HPE, а також у хмарних середовищах Google Cloud, Oracle, а незабаром — AWS та Azure.

-

Виробничі агенти: Такі компанії, як CodeRabbit (розробка програмного забезпечення) та Greptile, інтегрують модель для аналізу кодових баз у великих масштабах, тоді як промислові лідери, як-от Siemens та Palantir, розгортають її для автоматизації складних робочих процесів у виробництві та кібербезпеці.

Як зазначила Карі Бріскі, віце-президент Nvidia з програмного забезпечення ШІ: “Коли компанії переходять від чат-ботів до багатоагентних додатків, вони стикаються з… вибухом контексту.”

Nemotron 3 Super — це відповідь Nvidia на цей вибух: модель, яка надає “мозкову потужність” системи зі 120 мільярдами параметрів з операційною ефективністю набагато меншого спеціаліста. Для підприємств посил чіткий: “податок на мислення” нарешті зменшується.

Прогноз ІТ-Блогу: Nemotron 3 Super, ймовірно, стане каталізатором для нових поколінь галузевих ШІ-агентів, які зможуть обробляти складні завдання з небаченою раніше ефективністю. Цей розвиток може призвести до суттєвого перегляду вартості використання потужних мовних моделей у корпоративному секторі.

Джерело новини: venturebeat.com