Ера генеративного штучного інтелекту для багатьох розпочалася з запуску ChatGPT від OpenAI наприкінці 2022 року. Проте, технологія, що лежить в її основі — архітектура нейромережі “Transformer”, яка дозволяє моделям ШІ по-різному зважувати важливість слів у реченні (або пікселів у зображенні) та паралельно навчатися на даних — сягає корінням фундаментальної статті Google 2017 року “Attention Is All You Need”. Хоча “Transformer” забезпечує неперевершену якість моделей і став основою для більшості сучасних генеративних ШІ-моделей, він є надзвичайно вимогливим до обчислювальних ресурсів. Його квадратична складність обчислень та лінійна потреба в пам’яті роблять масштабування виведення (inference) дорогим і часто недоступним завданням. Саме тому деякі дослідники прагнуть вдосконалити його, розробляючи нову архітектуру — Mamba, яка у 2023 році лягла в основу гібридних моделей Mamba-Transformer, таких як Nemotron 3 Super від NVIDIA. Нині команда розробників оригінальної архітектури Mamba, зокрема Альберт Гу з Карнегі-Меллон та Трі Дао з Прінстона, випустила найновішу версію своєї архітектури як мовну модель під відкритою ліцензією Apache 2.0. Це робить її негайно доступною для розробників, включно з підприємствами для комерційного використання. Технічна документація також опублікована на arXiv.org. Ця модель знаменує собою зміну парадигми від ефективності навчання до дизайну, орієнтованого на “виведення” (inference-first). Як зазначив Гу в офіційному анонсі, якщо Mamba-2 була зосереджена на подоланні вузьких місць попереднього навчання, то Mamba-3 має на меті вирішити проблему “холодних GPU” — ситуацію, коли під час декодування сучасне обладнання часто залишається невикористаним, очікуючи на переміщення даних у пам’яті, замість виконання обчислень.

Пелекстість (Perplexity) та нова ефективність Mamba 3

Mamba, включно з Mamba 3, належить до класу моделей просторових станів (State Space Models, SSM). Ці моделі фактично є високошвидкісними “машинами для узагальнення” в ШІ. На відміну від багатьох популярних моделей (як ті, що стоять за ChatGPT), які мусять повторно переглядати кожне попередньо побачене слово, щоб зрозуміти, що йде далі (що уповільнює і здорожчує розмову зі збільшенням її тривалості), SSM підтримує компактний, постійно оновлюваний внутрішній стан. Цей стан є, по суті, цифровим “ментальним знімком” усієї історії даних. Коли надходять нові дані, модель просто оновлює цей знімок, а не перечитує все з початку. Це дозволяє ШІ обробляти величезні обсяги інформації, як-от цілі бібліотеки книг або довгі послідовності ДНК, з неймовірною швидкістю та значно меншими вимогами до пам’яті. Щоб оцінити стрибок, який представляє Mamba-3, необхідно спершу зрозуміти пелекстість — основний показник якості моделі, що використовується в дослідженнях. У контексті мовного моделювання, пелекстість вимірює, наскільки “здивована” модель новими даними. Уявіть модель як професійного гравця. Якщо модель має високу пелекстість, вона не впевнена, куди робити ставки; вона розглядає багато можливих наступних слів як однаково ймовірні. Нижчий показник пелекстії вказує на те, що модель є більш “певною” — вона краще розуміє глибинні закономірності людської мови. Для розробників ШІ пелекстість слугує високоточним проксі-індикатором інтелекту. Прорив, про який йдеться у дослідженні Mamba-3, полягає в тому, що вона досягає порівнянної пелекстії зі своїм попередником, Mamba-2, використовуючи лише половину розміру стану. Це означає, що модель може бути такою ж “розумною”, але вдвічі ефективнішою в роботі.

Нова філософія

Філософія, що керує Mamba-3, — це фундаментальна зміна у підходах до балансу між “інтелектом” ШІ та швидкістю роботи обладнання, на якому він функціонує. Якщо попереднє покоління, Mamba-2, було розроблене для рекордно швидкого навчання, то Mamba-3 є архітектурою, орієнтованою на “виведення” (inference-first) — процес, за допомогою якого моделі ШІ надаються кінцевим користувачам через вебсайти на кшталт ChatGPT або Google Gemini, або через програмні інтерфейси (API).

Основна мета Mamba 3 — максимально використати кожну мілісекунду роботи чіпа (GPU), забезпечуючи, щоб модель “думала” якомога інтенсивніше, не змушуючи користувача чекати на відповідь.

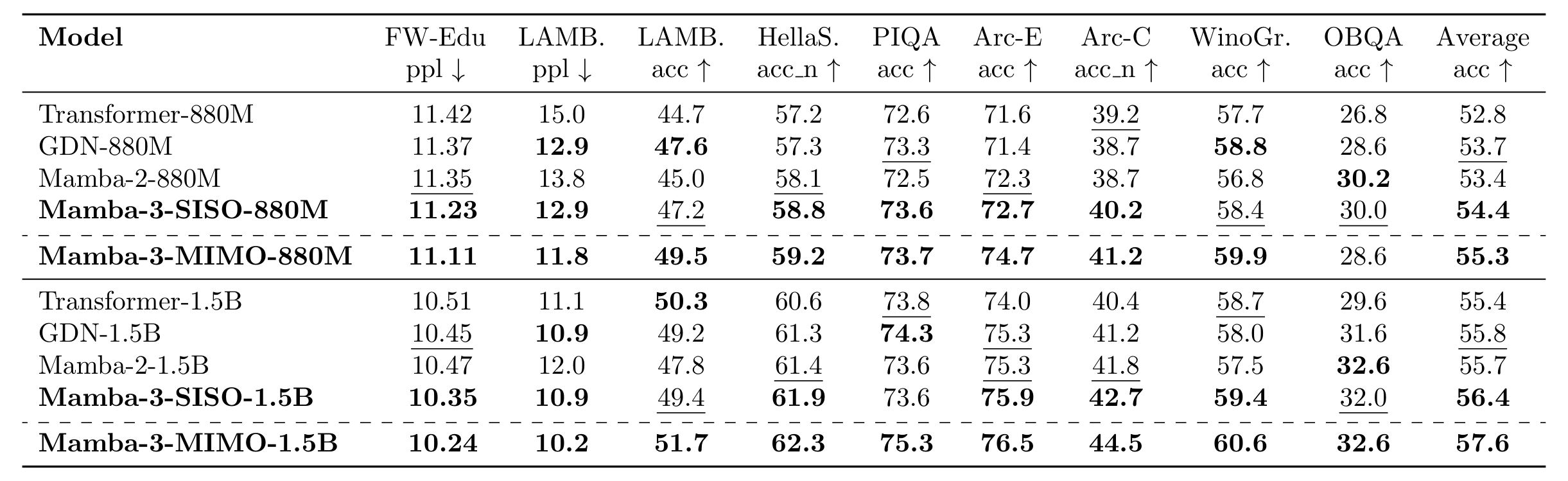

У світі мовних моделей кожний пункт точності досягається важко. У масштабі 1,5 мільярда параметрів, найсучасніший варіант Mamba-3 “MIMO” досяг середньої точності 57,6% за різними бенчмарками, що на 2,2 відсоткових пункти перевищує стандартний показник Transformer.

Хоча стрибок у два пункти може здатися незначним, насправді він становить майже 4% відносного зростання можливостей мовного моделювання порівняно з базовою моделлю Transformer. Ще більш вражаючим є те, що, як зазначалося вище, Mamba-3 може відповідати якості прогнозування свого попередника, використовуючи лише половину внутрішнього “розміру стану”, ефективно забезпечуючи той самий рівень інтелекту зі значно меншою затримкою пам’яті.

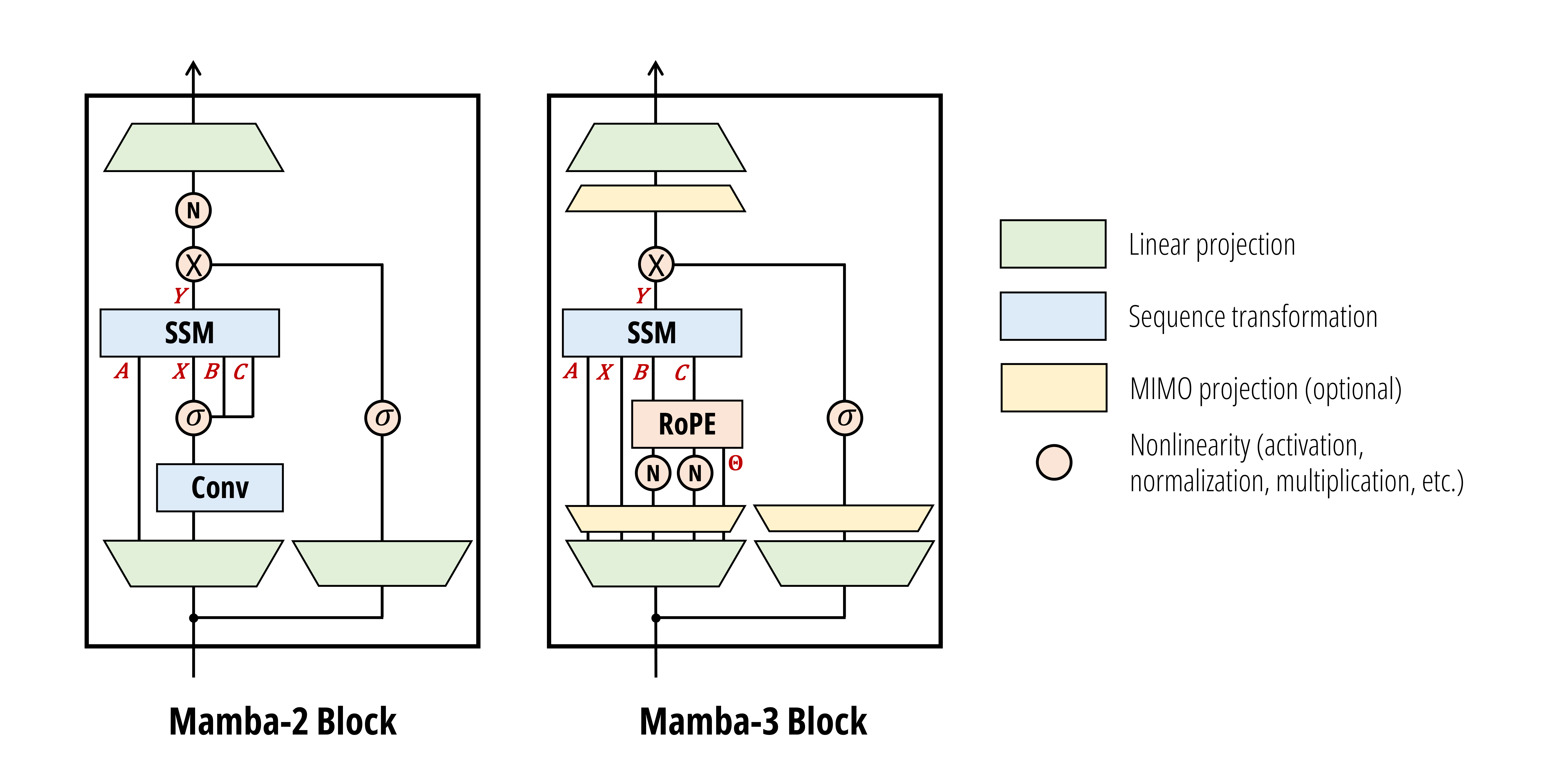

Роками ефективні альтернативи Transformer страждали від “логічного розриву” — вони часто зазнавали невдач у простих завданнях на міркування, таких як відстеження закономірностей або розв’язання елементарних арифметичних завдань, через занадто жорстку внутрішню математику. Mamba-3 вирішує цю проблему, впроваджуючи комплексні стани.

Це математичне вдосконалення діє як внутрішній компас, дозволяючи моделі представляти “обертальну” логіку. Використовуючи цей “обертовий” підхід, Mamba-3 може майже бездоганно вирішувати логічні головоломки та завдання відстеження стану, які її попередники могли лише вгадувати, нарешті доводячи потужність лінійних моделей до рівня найсучасніших систем.

Останній штрих — це те, як Mamba-3 взаємодіє з фізичним обладнанням. Більшість сучасних ШІ-моделей є “пам’яттю-обмеженими” (memory-bound), що означає, що чіп витрачає більшу частину часу в режимі очікування, поки дані переміщуються з пам’яті до процесора.

Mamba-3 представляє багато вхідну, багато вихідну (Multi-Input, Multi-Output, MIMO) формулювання, яке фундаментально змінює цю динаміку. Виконуючи до чотирьох разів більше математичних операцій паралельно на кожному кроці, Mamba-3 використовує раніше “неактивну” потужність. Це дозволяє моделі робити значно більше “роздумів” для кожного згенерованого слова, не збільшуючи фактичного часу, який користувач витрачає на очікування відповіді. Детальніше про це нижче.

Три нових технологічних стрибки

Привабливість лінійних моделей завжди полягала в їхніх постійних вимогах до пам’яті та лінійному масштабуванні обчислень.

Однак, як зазначають розробники Mamba 3, “немає безкоштовного обіду”. Фіксуючи розмір стану для забезпечення ефективності, ці моделі змушені стискати весь історичний контекст в одне представлення — повну протилежність зростаючому KV-кешу Transformer. Mamba-3 використовує три специфічні важелі, щоб цей фіксований стан працював краще.

1. Експоненційно-трапецієва дискретизація

Моделі просторових станів (SSM) за своєю суттю є системами безперервного часу, які повинні бути “дискретизовані” для обробки дискретних послідовностей цифрових даних.

Попередні ітерації покладалися на “експоненційно-Ейлерівську” дискретизацію — евристику, яка забезпечувала лише наближення першого порядку системи.

Mamba-3 впроваджує **узагальнене трапецієве правило**, що забезпечує наближення другого порядку точності. Це не просто математичне вдосконалення; воно індукує “неявну згортку” всередині основного рекурентного механізму.

Поєднуючи це з явними зміщеннями B і C, дослідники змогли усунути коротку причинно-наслідкову згортку, яка роками була невід’ємною частиною рекурентних архітектур.

2. Комплексні SSM та “RoPE Trick”

Однією з найстійкіших критик лінійних моделей була їхня нездатність вирішувати прості завдання відстеження стану, такі як визначення парності послідовності бітів.

Ця невдача виникає через обмеження матриці переходів дійсними числами, що заважає моделі представляти “обертальну” динаміку. Mamba-3 долає це, розглядаючи базову SSM як комплекснозначну.

Використовуючи те, що команда називає “**RoPE trick**”, вони демонструють, що комплекснозначне оновлення стану математично еквівалентне залежному від даних обертовому вбудовуванню (RoPE), застосованому до вхідних та вихідних проєкцій.

Це дозволяє Mamba-3 вирішувати синтетичні завдання міркування, які були неможливі для Mamba-2.

3. MIMO: Підвищення арифметичної інтенсивності

Найсуттєвіший стрибок в ефективності виведення досягається за рахунок переходу від одновхідних, одновихідних (Single-Input, Single-Output, SISO) до **багато вхідних, багато вихідних (Multi-Input, Multi-Output, MIMO)** SSM.

У стандартній SSM оновлення стану є операцією зовнішнього добутку, яка сильно залежить від пам’яті. Перейшовши до оновлення стану на основі множення матриць, Mamba-3 збільшує “арифметичну інтенсивність” моделі — співвідношення FLOPs до трафіку пам’яті.

Це дозволяє моделі виконувати більше обчислень під час фази декодування, яка залежить від пам’яті. По суті, Mamba-3 використовує “неактивні” обчислювальні ядра GPU для збільшення потужності моделі “безкоштовно”, зберігаючи ту саму швидкість декодування, що й у її простіших попередників.

Що Mamba 3 означає для підприємств та розробників ШІ

Для підприємств Mamba-3 означає стратегічну зміну в сукупній вартості володіння (TCO) для розгортання ШІ.

-

Вартість проти Продуктивності: При однаковому розмірі параметрів Mamba-3 (MIMO) відповідає пелекстії Mamba-2, використовуючи половину розміру стану. Для корпоративного розгортання це фактично подвоює пропускну здатність виведення на тому ж апаратному забезпеченні.

-

Агентні Робочі Процеси: Оскільки організації рухаються до паралельних, агентних робочих процесів (як-от автоматизоване кодування або агенти обслуговування клієнтів у реальному часі), попит на генерацію з низькою затримкою експоненційно зростає. Mamba-3 розроблена спеціально для запобігання “холодному” простою GPU під час виконання цих завдань.

-

Перевага гібридних рішень: Дослідники прогнозують, що майбутнє корпоративного ШІ полягає в **гібридних моделях**. Шляхом чергування шарів Mamba-3 з механізмом самостійної уваги (self-attention) організації можуть поєднувати ефективну “пам’ять” SSM з точним “базовим” зберіганням даних Transformer.

Бар’єри для впровадження — та як Mamba 3 їх пом’якшує

Архітектура Mamba, хоч і теоретично перевершує Transformer у масштабуванні, ще не витіснила його головним чином через “Парадокс Тензорних Ядер” (Tensor Core Paradox) та значний розрив у зрілості екосистеми.

Незважаючи на свою лінійну складність O(L), **ранні ітерації Mamba мали труднощі з використанням Тензорних Ядер NVIDIA**, які спеціально розроблені для щільних матричних множень, що характеризують Transformer. Тоді як **Transformer зазвичай досягає 80–90% утилізації обладнання**, рекурентна, скалярно-орієнтована природа SSM часто залишала **Mamba-1 на піку лише 10–15%**.

Цей розрив в “арифметичній інтенсивності” означав, що на практиці Transformer часто був швидшим для навчання, незважаючи на гіршу теоретичну складність.

Хоча Mamba-3 значною мірою вирішила цю проблему завдяки MIMO-оновленням та двоїстості просторових станів (State Space Duality) — математичному переосмисленню SSM як “лінійного зважування”, яке Тензорні Ядра можуть обробляти — апаратно-програмний стек для Transformer надто вкорінений, щоб його можна було змінити за одну ніч.

Окрім сирої утилізації обладнання, Mamba стикається з обмеженням “логіки та лояльності”. Більшість промислових законів масштабування, систем безпеки та бібліотек оптимізації (як-от FlashAttention, квантування GGUF та LoRA) були створені виключно для парадигми KV-кешу Transformer.

Квантування Mamba залишається надзвичайно складним; стандартні 4-бітні методи часто призводять до падіння точності на двозначні відсотки, оскільки механізм паралельного сканування Mamba посилює числові викиди, які Transformer може легко ігнорувати.

Крім того, чисті моделі Mamba все ще відстають у In-Context Learning (ICL) — здатності “вчитися” на прикладах у запиті. Дослідження вказують на те, що хоча Mamba-3 майже на 4% ефективніша у чистому мовному моделюванні, вона все ще має труднощі з завданнями “копіювання” та багатоетапними міркуваннями, які Attention обробляє нативно.

Відповідно, індустрія не “переходить” на Mamba, а радше “поглинає” її; сучасний стан технологій переорієнтувався на гібридні архітектури (як-от сімейство Nemotron-3 від NVIDIA), які чергують шари Mamba для ефективності довгого контексту з достатньою кількістю шарів Attention для збереження “базового” пошуку та міркування.

Доступність, ліцензування та використання

Mamba-3 — це не просто теоретична дослідницька стаття; це повністю реалізований, відкритий реліз, доступний для негайного використання з кодом моделі, опублікованим на Github.

Проєкт випущено під ліцензією Apache-2.0. Це дозвільна, дружня до бізнесу ліцензія, яка дозволяє безкоштовне використання, модифікацію та комерційне розповсюдження без необхідності розголошувати пропрієтарний вихідний код.

Цей реліз корисний для розробників, які створюють довгоконтекстні додатки, агентні системи реального часу або тих, хто прагне зменшити витрати на GPU у високооб’ємних виробничих середовищах.

Лідер революції Моделей Просторових Станів (SSM)

Реліз був зустрінутий з ентузіазмом у соціальних мережах, особливо щодо “студентського” характеру проєкту. Гу, чий профіль у X/Twitter описує його як “лідера SSM-революції”, повністю визнав заслуги провідних студентів, включно з **Аакашем Лахоті** та **Кевіном Ю. Лі**.

У своєму пості Гу підкреслив задоволення команди дизайном:

“Ми дуже задоволені фінальним дизайном моделі! Три ключові методологічні зміни натхненні (на мою думку) елегантною математикою та методами.”

Оскільки агентні робочі процеси “зводять з розуму” попит на виведення, поява Mamba-3 свідчить про те, що майбутнє ШІ може полягати не лише у володінні найбільшою моделлю, але й у найефективнішій.

Mamba-3 успішно узгодила SSM з реаліями сучасного обладнання, доводячи, що навіть в епоху Transformer принципи класичної теорії управління мають життєво важливу роль.

Прогноз ІТ-Блогу: Mamba-3 та подібні ефективні архітектури, ймовірно, стануть ключовими для розвитку ШІ-агентів та роботи в режимі реального часу, зменшуючи залежність від величезних обчислювальних потужностей. Очікується поява більш зрілих інструментів для оптимізації та інтеграції Mamba в існуючі Transformer-орієнтовані системи.

Подробиці можна знайти на сайті: venturebeat.com