Довгий час на ринку генерації зображень за допомогою штучного інтелекту домінував один гравець. Сімейство моделей Nano Banana від Google встановило стандарт якості, швидкості та комерційного використання, тоді як конкуренти від OpenAI до Midjourney боролися за друге місце. Цей ієрархічний порядок змінився, коли стартап Luma AI, більш відомий своїм інструментом для генерації відео Dream Machine, представив Uni-1 — модель, яка не просто конкурує з Google за якість зображень, а й докорінно переосмислює сам процес створення зображень штучним інтелектом.

Uni-1 випереджає Nano Banana 2 від Google та GPT Image 1.5 від OpenAI за показниками, що вимагають здатності до міркування, майже зрівнюється з Gemini 3 Pro від Google у детекції об’єктів, і все це при приблизно 10-30% нижчій вартості для зображень високої роздільної здатності. Згідно з Luma, за результатами тестів людських уподобань з використанням рейтингу Ело, Uni-1 посідає перше місце за загальною якістю, стилем та редагуванням, а також генерацією на основі референсів. Лише в чистому перетворенні тексту на зображення Google Nano Banana зберігає лідерство.

Однак самі лише цифри не відображають значущості цього релізу. Uni-1 демонструє справжній архітектурний відхід від дифузійного підходу, який лежить в основі майже кожної сучасної моделі для роботи із зображеннями. Тоді як такі інструменти, як Midjourney, Stable Diffusion та Google Imagen 3, генерують зображення шляхом ітеративного видалення шуму з випадкових полів, Uni-1 використовує авторегресивну генерацію — той самий метод послідовного передбачення токенів, що й у великих мовних моделях — для аналізу того, що вона створює, під час процесу створення. Відсутня передача завдань між системою, що розуміє запит, та окремою системою, що малює зображення. Це єдиний процес, що працює на єдиному наборі ваг.

Ця відмінність має величезне значення для корпоративних клієнтів, які активно впроваджують інструменти генерації зображень за допомогою ШІ для реклами, дизайну продуктів та робочих процесів створення контенту. Модель, здатна до справжнього аналізу складних інструкцій, збереження контексту під час ітеративних правок та самостійної оцінки результатів, зменшує обсяг людської праці, необхідний для переходу від задуму до готового результату. Саме цей пробіл у можливостях обмежував проникнення ШІ у професійну творчу сферу.

Чому архітектура «єдиного інтелекту» змінює можливості моделей зображень

Щоб зрозуміти значущість Uni-1, необхідно розібратися, що вона замінює. Домінуючою парадигмою в генерації зображень за допомогою ШІ була дифузія — процес, який починається з випадкового шуму і поступово перетворює його на зв’язне зображення, кероване текстовим ембеддингом. Дифузійні моделі дають візуально вражаючі результати, але вони не мають справжньої здатності до міркування. Вони відображають ембеддинги запитів у пікселі через навчений процес видалення шуму, без проміжного етапу, на якому модель обмірковує просторові співвідношення, фізичну правдоподібність чи логічні обмеження.

Галузь розробила обхідні шляхи. DALL-E 3 використовує GPT-4 для переписування та розширення запитів користувачів перед передачею їх окремій генеративній моделі. Imagen 3 від Google покладається на Gemini для аналізу перед тим, як Imagen генерує зображення. Ці підходи допомагають, але вони вводять рівень перекладу — шов між розумінням та створенням, де інформація та нюанси можуть бути втрачені.

Uni-1 повністю усуває цей шов. Як зазначає Luma у своїх технічних специфікаціях, модель є авторегресивним трансформером лише з декодером, де текст і зображення представлені в єдиній чергуваній послідовності, що діє як вхідні дані, так і вихідні. Компанія стверджує, що Uni-1 «може виконувати структурований внутрішній аналіз до та під час синтезу зображення», розкладаючи інструкції, вирішуючи обмеження та плануючи композицію перед візуалізацією. Luma позиціонує цей підхід як створення «системи, яка міркує, уявляє, планує, ітерує та виконує як у цифровому, так і у фізичному доменах», з моделями, що «спільно моделюють час, простір і логіку в єдиній архітектурі, забезпечуючи форми розв’язання проблем, недосяжні для фрагментованих конвеєрів».

Практичні наслідки найбільш чітко проявляються в завданнях, що вимагають справжнього розуміння, а не простого зіставлення зразків. В одній демонстрації Uni-1 генерує повну послідовність зображень з однієї референсної фотографії, показуючи піаніста від дитинства до старості, зберігаючи той самий ракурс камери та послідовність сцени. В іншій моделі, об’єднуються кілька окремих фотографій домашніх тварин у повністю нову сцену — вони одягнені в академічну мантію, стоять перед дошкою з науковими діаграмами — зберігаючи при цьому унікальну ідентичність кожної тварини. Це завдання, які зазвичай вимагають значного ручного промптингу, постобробки або обох.

Результати Uni-1 проти Nano Banana, GPT Image та Midjourney за ключовими показниками

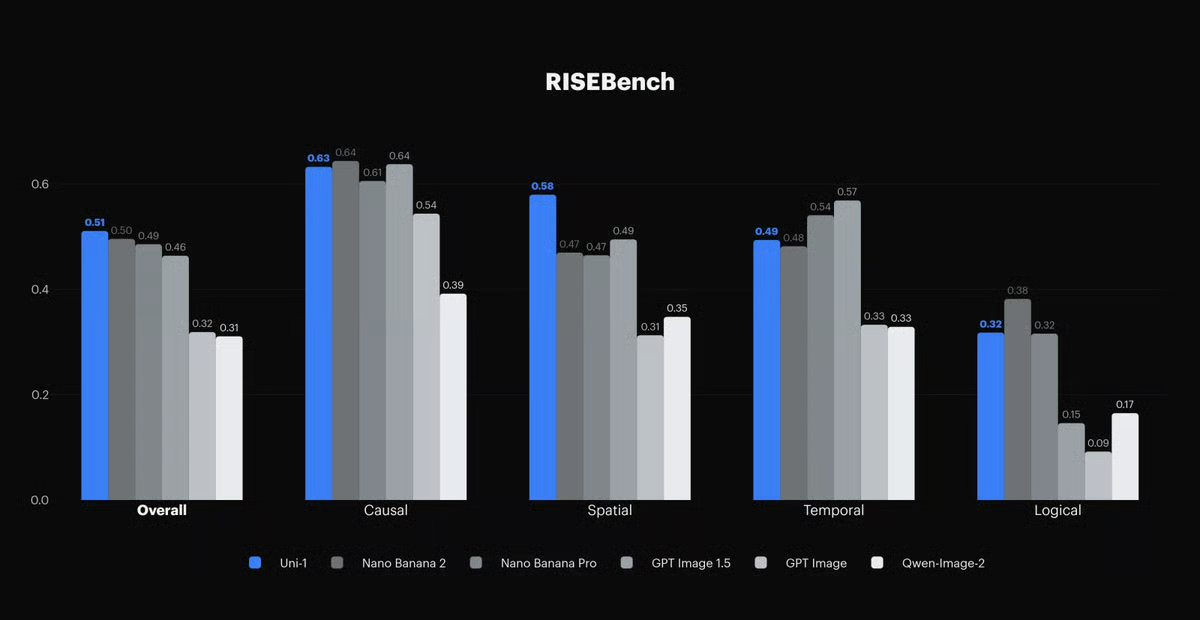

За результатами RISEBench — бенчмарку, розробленого спеціально для оцінки редагування візуальних даних з урахуванням міркувань (Reasoning-Informed Visual Editing), що перевіряє часове, причинно-наслідкове, просторове та логічне міркування, — Uni-1 демонструє передові результати за всіма показниками. Модель має загальний бал 0.51, випереджаючи Nano Banana 2 (0.50), Nano Banana Pro (0.49) та GPT Image 1.5 (0.46). Розрив у лідерів невеликий, але значно зростає у специфічних категоріях. У просторовому міркуванні Uni-1 лідирує з показником 0.58 порівняно з 0.47 у Nano Banana 2. У логічному міркуванні — найскладнішій категорії для моделей зображень — Uni-1 набирає 0.32, що більш ніж удвічі перевищує показники GPT Image (0.15) та Qwen-Image-2 (0.17).

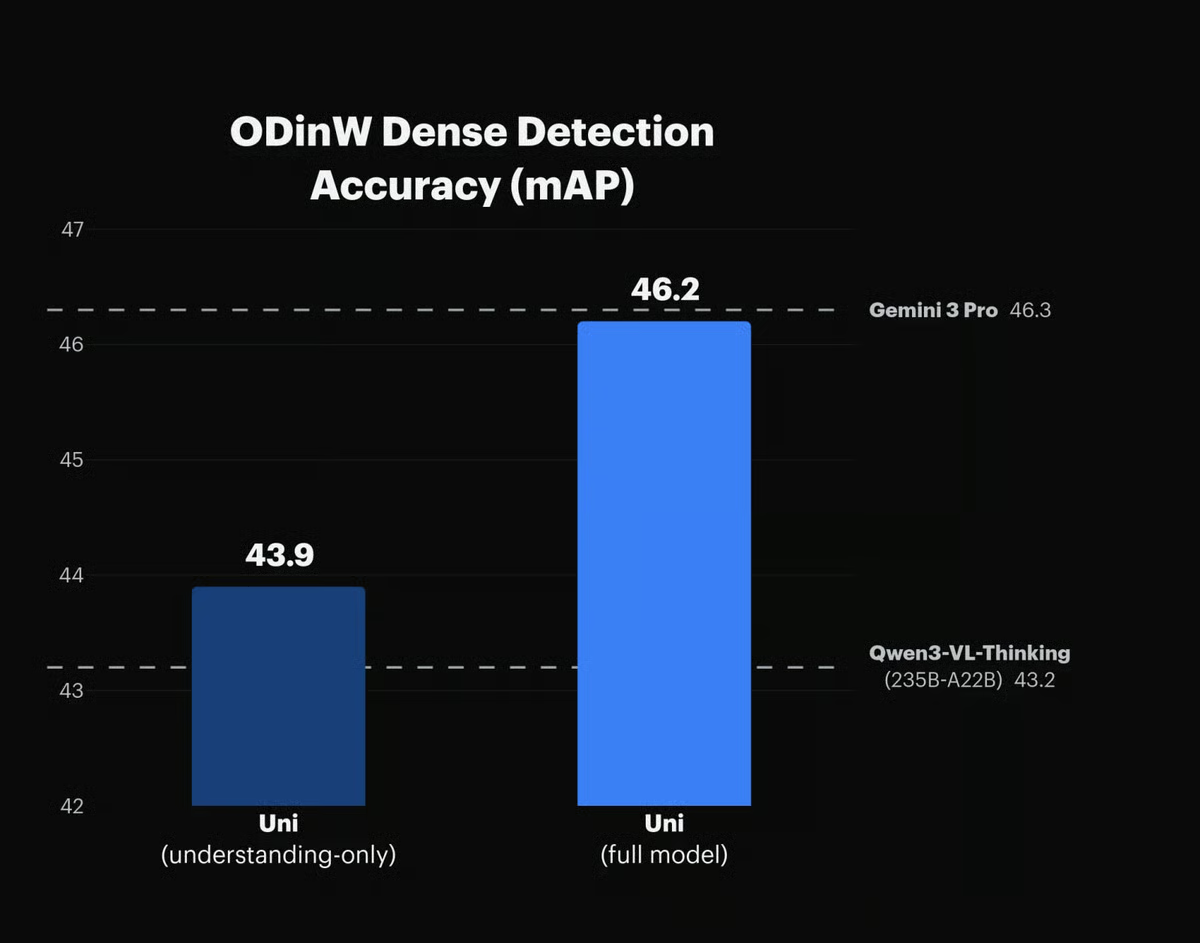

Бенчмарк ODinW-13, який вимірює, наскільки добре модель може ідентифікувати та локалізувати об’єкти у складних сценах шляхом щільного виявлення за відкритим словником, виявляє дещо цікавіше про архітектуру Uni-1. Повна модель демонструє 46.2 mAP, майже зрівнюючись з Gemini 3 Pro від Google (46.3) та значно випереджаючи Qwen3-VL-Thinking (43.2). Однак варіант Uni-1, призначений лише для розуміння, без тренування генерації, показує лише 43.9. Це покращення на 2.3 пункти є прямим доказом того, що навчання генерації зображень робить модель помітно кращою у їх розумінні, підтверджуючи ключову тезу Luma про те, що уніфікація є не просто архітектурною зручністю, а мультиплікатором продуктивності.

У порівнянні з Midjourney, співвідношення залежить від сценарію використання. Тестування The Decoder показало, що Uni-1 є «помітним кроком вперед порівняно з новим Midjourney v8, який мав труднощі з тим самим запитом» у задачах, що вимагають складних міркувань. Midjourney зберігає свою репутацію естетичної досконалості в мистецьких та стилізованих роботах, але для точного виконання інструкцій та автоматизованих робочих процесів перевага Uni-1 у здатності до міркування є очевидною. Один користувач Reddit у своєму ранньому оцінюванні після паралельного тестування лаконічно зазначив: «Коли йдеться про реальне логічне міркування, розуміння складних сцен, просторові/правдоподібні аспекти або редагування, що вимагає справжнього осмислення, UNI-1 просто перевершує все».

Стратегія ціноутворення Luma підриває позиції Google там, де це найважливіше

Окрім сирої продуктивності, Uni-1 пропонує структуру цін, розроблену для відтягування корпоративних клієнтів від екосистеми Google.

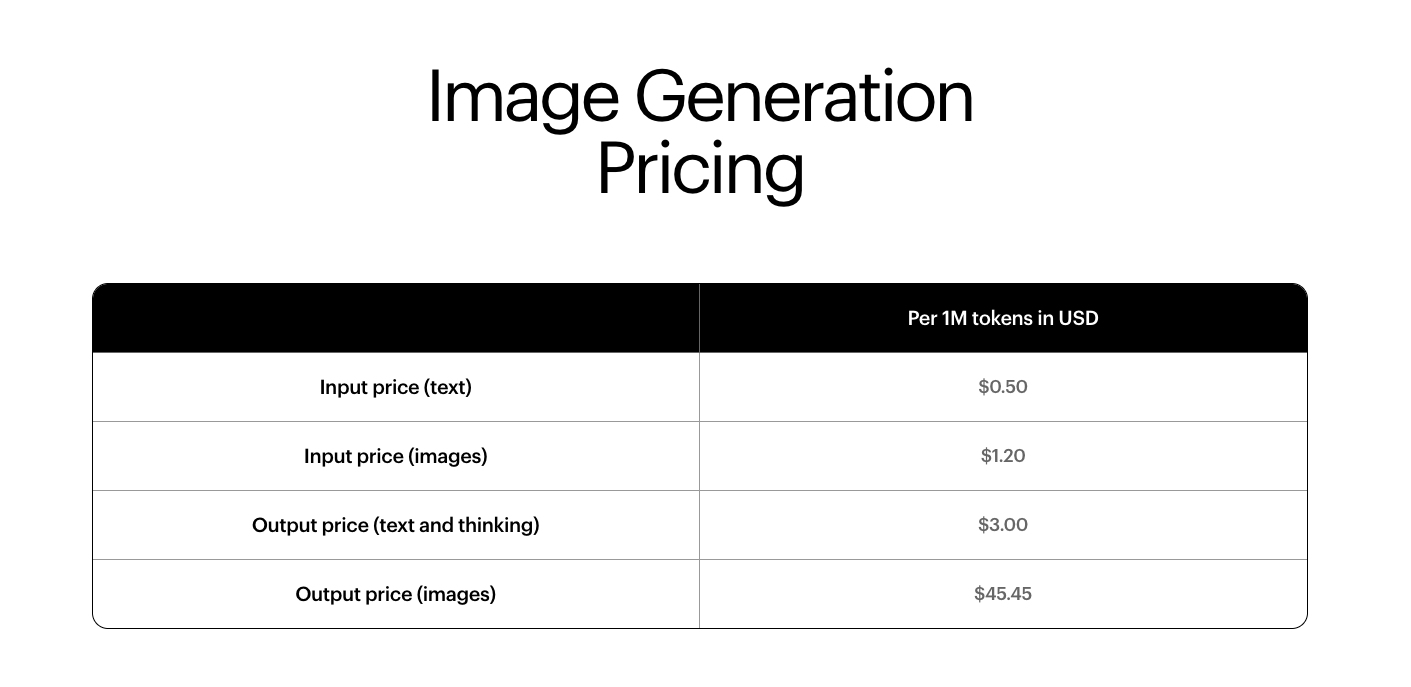

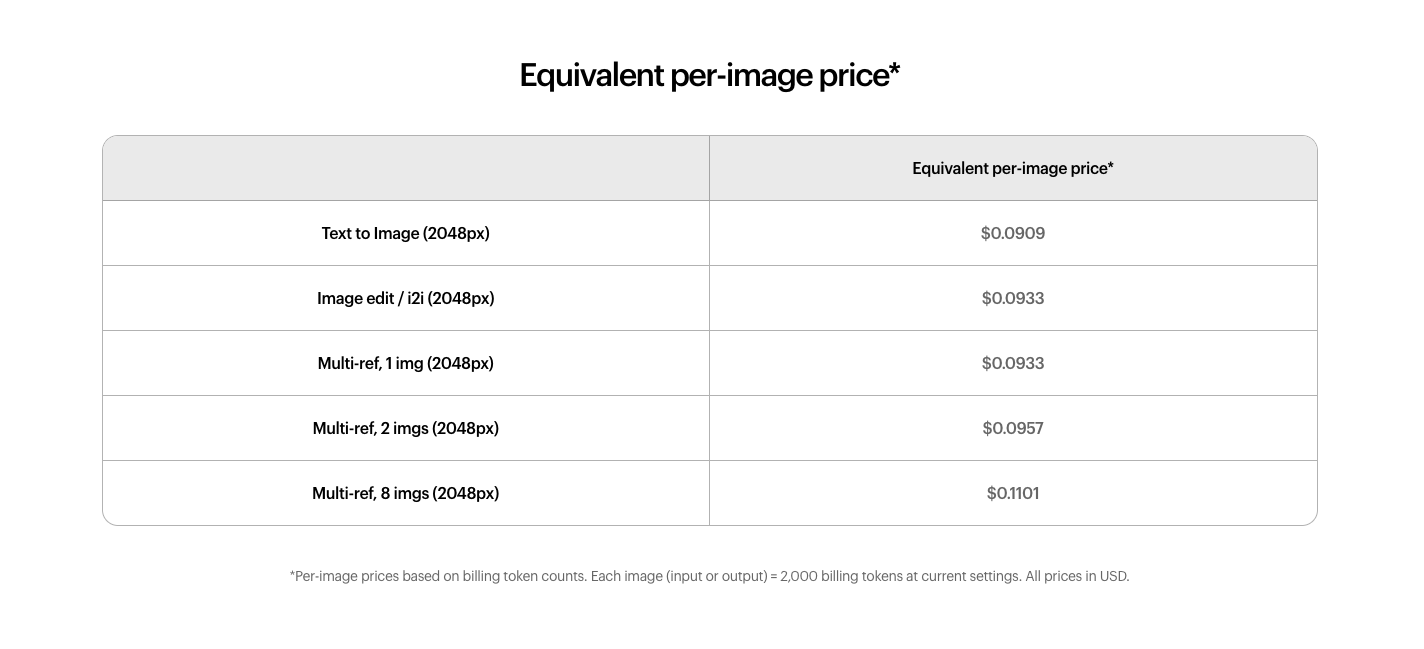

При роздільній здатності 2K — стандарті для більшості професійних робочих процесів — ціна API Uni-1 за генерацію зображення становить приблизно 0.09 долара США, тоді як для Nano Banana 2 це 0.101 долара США, а для Nano Banana Pro — 0.134 долара США, згідно з даними про ціни, опублікованими The Decoder. Редагування зображень та генерація на основі одного референсу коштує приблизно 0.0933 долара США, і навіть генерація на основі восьми вхідних зображень сягає лише приблизно 0.11 долара США.

Nano Banana 2 від Google зберігає перевагу в ціні при нижчих роздільних здатностях: зображення 0.5K коштує близько 0.045 долара США, а 1K — близько 0.067 долара США, як зазначив The Decoder. Але для продакшн-команд, що генерують зображення високої роздільної здатності у великих обсягах — саме тих клієнтів, на яких орієнтується Luma — розрахунки свідчать на користь Uni-1 як за якістю, так і за вартістю.

Така цінова стратегія відображає ширший конкурентний розрахунок. Luma не може конкурувати з Google за обсягами дистрибуції чи інфраструктурним охопленням, тому вона змагається за двома напрямками, де стартап може перемогти: вища спроможність у конкретних завданнях та нижча ціна, що робить зміну вартий зусиль з інтеграції.

Luma Agents перетворюють модель на платформу для корпоративної творчості

Uni-1 не існує як самостійна модель. Вона лежить в основі Luma Agents — платформи для агентної творчості, яку компанія запустила на початку березня. Luma Agents призначені для виконання повного циклу творчої роботи, що охоплює текст, зображення, відео та аудіо, взаємодіючи з іншими моделями ШІ, включаючи Veo 3 та Nano Banana Pro від Google, Seedream від ByteDance та голосові моделі від ElevenLabs.

Корпоративний інтерес вже є відчутним. Генеральний директор Luma Аміт Джейн повідомив TechCrunch, що компанія почала впроваджувати платформу разом із глобальними рекламними агентствами Publicis Groupe та Serviceplan, а також брендами, такими як Adidas, Mazda, і саудівською компанією Humain, що займається ШІ. В одному з наведених прикладів Джейн зазначив, що Luma Agents скоротили час, необхідний для «річної рекламної кампанії вартістю 15 мільйонів доларів», до створення кількох локалізованих рекламних матеріалів для різних країн, виконавши роботу за 40 годин і витративши менше 20 000 доларів США, при цьому пройшовши внутрішній контроль якості бренду.

Ключовою можливістю, що забезпечує таке скорочення, є здатність Uni-1 оцінювати та вдосконалювати власні результати — ітеративний цикл самокритики, поширений серед агентів для кодування, але якого значною мірою бракувало в інструментах для творчого ШІ. Оскільки Uni-1 обробляє як розуміння, так і генерацію, вона може оцінити, чи відповідає її вихідний результат намірам інструкції, визначити, де є недоліки, та ітерувати без втручання людини. Джейн порівняв це з петлею зворотного зв’язку, яка зробила агентів для кодування такими продуктивними, заявивши TechCrunch: «Вам потрібна ця здатність оцінювати свою роботу, виправляти її та проходити цей цикл, доки рішення не стане добрим та точним».

Модель також підтримує можливості, що виходять далеко за межі базової генерації зображень з тексту. Технічна сторінка Luma підкреслює часове міркування, яке зберігає узгодженість сцени під час еволюції в часі, генерацію на основі референсів, яка зберігає ідентичність та композицію з вхідних фотографій, генерацію з урахуванням культурних особливостей, що охоплює понад 76 стилів мистецтва, та багатоетапне вдосконалення, яке дозволяє ітеративне творче керівництво без втрати контексту. Як зазначив MindStudio у своєму аналізі, ця комбінація робить Uni-1 «особливо сильною у виконанні завдань, таких як дотримання складних композиційних інструкцій» та «виконання редагування зображень на основі інструкцій».

Ранні відгуки свідчать про зміну поглядів творців на інструменти генерації зображень ШІ

Початкова реакція спільноти була переважно позитивною, хоча ретельне незалежне тестування все ще перебуває на ранніх стадіях. У X реакції зводилися до спільної теми: Uni-1 відчувається якісно відмінною від існуючих інструментів. «Ідея референсного генерації з обґрунтованим контролем є потужною», — написав Маянк Агарвал. «Це дає творцям набагато більше точності без втрати гнучкості». Інший користувач X, Наїм Шейх, описав це як «зміну від «ввів запит і молись» до реального творчого контролю».

На Reddit користувач, який проводив паралельні порівняння з Nano Banana 2, запропонував більш детальний аналіз, відзначивши швидкість та рендеринг тексту в Nano Banana 2, але дійшов висновку, що Uni-1 домінувала у «реальному логічному міркуванні, розумінні складних сцен, просторових/правдоподібних аспектах або редагуванні, що вимагає справжнього осмислення». Користувач додав: «Якщо вам важливі зображення, які справді мають сенс, а не просто виглядають красиво швидко, UNI-1 — це те, що вам потрібно зараз».

Не всі були готові оголосити нового чемпіона. Кілька користувачів зазначили, що вони все ще чекають на повний доступ до API для проведення власних тестів, і залишаються питання щодо обробки моделлю нелатинських текстів, екстремальних граничних випадків та швидкості генерації при найвищих роздільних здатностях — відомого компромісу авторегресивних архітектур порівняно з оптимізованими дифузійними конвеєрами.

Що модель Luma означає для майбутнього перегонів у галузі генерації зображень ШІ

Luma описує Uni-1 як «лише початок». Компанія стверджує, що її уніфікований дизайн «природно поширюється за межі статичних зображень на відео, голосових агентів та повністю інтерактивні симулятори світу», а Джейн повідомив TechCrunch, що можливості виведення аудіо та відео з’являться в наступних релізах. Uni-1 доступна для безкоштовного тестування на lumalabs.ai, а доступ до API поступово розширюється.

Амбіція побудувати єдину модель, яка може бачити, говорити, міркувати та створювати в одному безперервному потоці, поділяється практично кожною великою лабораторією ШІ. Google, OpenAI, Meta та інші працюють над мультимодальною уніфікацією з ресурсами, що значно перевищують те, що може зібрати будь-який стартап. Питання полягає в тому, чи зможе перевага Luma в архітектурі та вже продемонстровані переваги в продуктивності витримати неминучу відповідь від цих більших конкурентів.

Історія пропонує змішані прецеденти. Стартапи, що визначають нову парадигму, іноді поглинаються або їх перевершують за фінансуванням, перш ніж вони зможуть нею скористатися. Але іноді вони задають тон змагань для цілого покоління технологій. На даний момент індустрія генерації зображень ШІ стикається з простою і незручною реальністю: найкраща модель зображень, заснована на міркуванні, у світі була створена не Google, OpenAI чи будь-яким із звичайних підозрюваних. Її створив стартап із 150 співробітників у Сан-Франциско — і вона, до того ж, дешевша.

Прогноз ІТ-Блогу: Архітектура Uni-1, яка об’єднує розуміння та генерацію, знаменує собою новий етап у розвитку ШІ, наближаючи нас до справді універсальних агентів. Очікується, що ця модель стане каталізатором для швидкого розвитку мультимодальних систем, які зможуть не лише створювати контент, а й комплексно вирішувати завдання, що потребують аналізу та планування, потенційно змінюючи ландшафт багатьох креативних та інженерних галузей.

За матеріалами: venturebeat.com