Обробка 200 000 токенів за допомогою великої мовної моделі є дорогою та повільною: чим довший контекст, тим швидше зростають витрати. Дослідники з Університету Цінхуа та Z.ai розробили техніку під назвою IndexCache, яка скорочує до 75% надлишкових обчислень у моделях зі розрідженою увагою (sparse attention), забезпечуючи до 1,82 рази швидший час до першого токену та до 1,48 рази вищу пропускну здатність генерації за такого розміру контексту. Ця техніка застосовується до моделей, що використовують архітектуру DeepSeek Sparse Attention, включно з останніми сімействами DeepSeek та GLM. Вона може допомогти підприємствам забезпечити швидшу взаємодію з користувачами для великомасштабних моделей з довгим контекстом, що вже було підтверджено попередніми тестами на моделі GLM-5 з 744 мільярдами параметрів. ## Вузьке місце DSA Великі мовні моделі покладаються на механізм самостійної уваги (self-attention), процес, під час якого модель обчислює взаємозв’язок між кожним токеном у своєму контексті та усіма попередніми для передбачення наступного токену. Проте самостійна увага має суттєве обмеження. Її обчислювальна складність зростає квадратично зі збільшенням довжини послідовності. Для застосувань, що потребують розширених вікон контексту (наприклад, обробка великих документів, багатоетапні агентські робочі процеси або довгострокові міркування), це квадратичне зростання призводить до повільної швидкості виведення та значних витрат на обчислення й пам’ять.

Розріджена увага (sparse attention) пропонує принципове рішення цієї проблеми масштабування. Замість обчислення взаємозв’язку між кожним токеном та усіма попередніми, розріджена увага оптимізує процес, дозволяючи кожному запиту вибирати та фокусуватися лише на найбільш релевантній підмножині токенів.

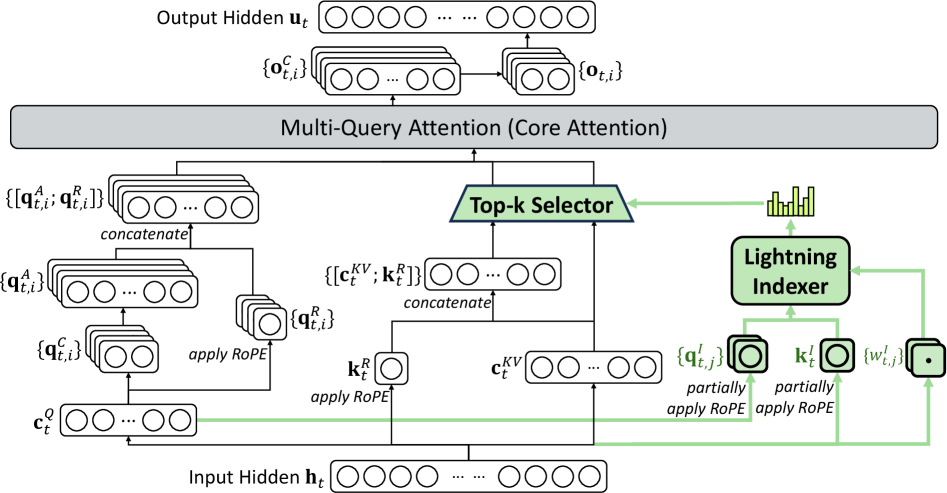

DeepSeek Sparse Attention (DSA) – це високоефективна реалізація цієї концепції, вперше представлена в DeepSeek-V3.2. Щоб визначити, які токени є найважливішими, DSA вводить легкий модуль “індексатора блискавки” (lightning indexer module) на кожному шарі моделі. Цей індексатор оцінює всі попередні токени та вибирає невелику підмножину для обробки основним механізмом уваги. Таким чином, DSA скорочує значні обчислення основного механізму уваги з квадратичних до лінійних, значно прискорюючи модель, зберігаючи при цьому якість виведення.

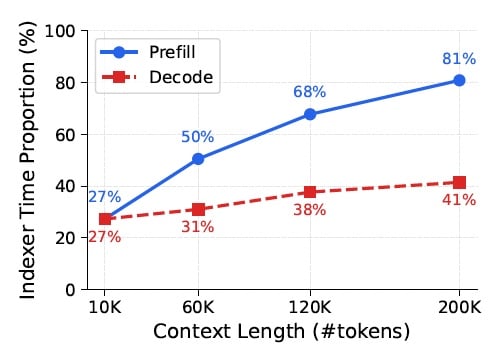

Однак дослідники виявили залишковий недолік: сам індексатор DSA все ще працює з квадратичною складністю на кожному окремому шарі. Навіть якщо індексатор є обчислювально менш витратним, ніж основний процес уваги, зі зростанням довжини контексту час, який модель витрачає на виконання цих індексаторів, стрімко зростає. Це суттєво сповільнює модель, особливо під час початкового етапу “префілу”, коли обробляється запит.

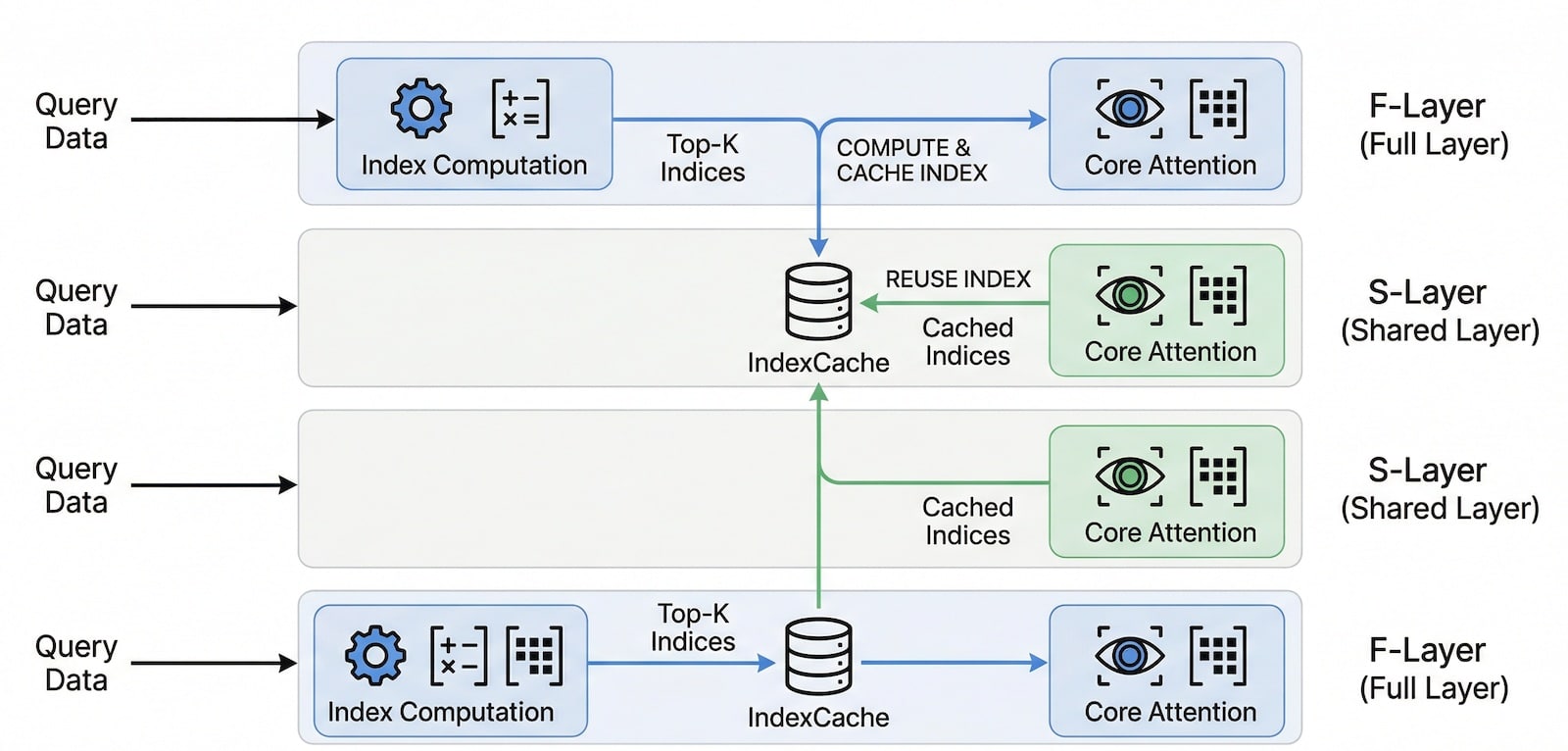

## Кешування уваги за допомогою IndexCache Щоб вирішити проблему вузького місця індексатора, команда дослідників виявила ключову особливість обробки даних моделями DSA. Підмножина важливих токенів, яку вибирає індексатор, залишається надзвичайно стабільною під час переходу даних через послідовні шари трансформера. Емпіричні тести моделей DSA показали, що сусідні шари ділять від 70% до 100% своїх вибраних токенів. Щоб скористатися цією міжшаровою надлишковістю, дослідники розробили IndexCache. Ця техніка розділяє шари моделі на дві категорії. Невелика кількість повних (F) шарів зберігає свої індексатори, активно оцінюючи токени та вибираючи найважливіші для кешування. Решта шарів стають спільними (S), не виконуючи індексації та повторно використовуючи кешовані індекси з найближчого попереднього F-шару.

Під час виведення модель просто перевіряє тип шару. Якщо вона досягає F-шару, вона обчислює та кешує свіжі індекси. Якщо це S-шар, вона пропускає обчислення та копіює кешовані дані.

Існує широкий спектр технік оптимізації, які намагаються вирішити проблему вузького місця уваги шляхом стиснення KV-кешу, де зберігаються обчислені значення уваги. Замість зменшення обсягу пам’яті, як стандартне стиснення KV-кешу, IndexCache атакує обчислювальне вузьке місце.

«IndexCache не є традиційною технікою стиснення або спільного використання KV-кешу», — розповів VentureBeat Юші Бай, співавтор статті. «Він усуває цю надлишковість, повторно використовуючи індекси між шарами, тим самим зменшуючи обчислення, а не просто розмір пам’яті. Він доповнює існуючі підходи і може комбінуватися з ними».

Дослідники розробили два підходи до розгортання IndexCache. (Варто зазначити, що IndexCache застосовується лише до моделей, які використовують архітектуру DSA, таких як останні моделі DeepSeek та найновіше сімейство моделей GLM.)

Для розробників, які працюють з готовими моделями DSA, де перенавчання неможливе або занадто дороге, вони створили метод без перенавчання, що спирається на алгоритм “жадібного вибору шарів” (greedy layer selection). Проганяючи невеликий калібрувальний набір даних через модель, цей алгоритм автоматично визначає оптимальне розміщення F- та S-шарів без будь-яких оновлень ваг. Емпіричні докази показують, що жадібний алгоритм може безпечно видалити 75% індексаторів, зберігаючи ту саму продуктивність моделі на подальших завданнях.

Для команд, які попередньо навчають або інтенсивно доналаштовують власні фундаментальні моделі, дослідники пропонують версію, що враховує процес навчання (training-aware), яка оптимізує параметри мережі для нативної підтримки міжшарового спільного використання. Цей підхід вводить “втрати дистиляції для кількох шарів” (multi-layer distillation loss) під час навчання. Він змушує кожен збережений індексатор вчитися вибирати консенсусну підмножину токенів, яка буде надзвичайно релевантною для всіх наступних шарів, які він обслуговує.

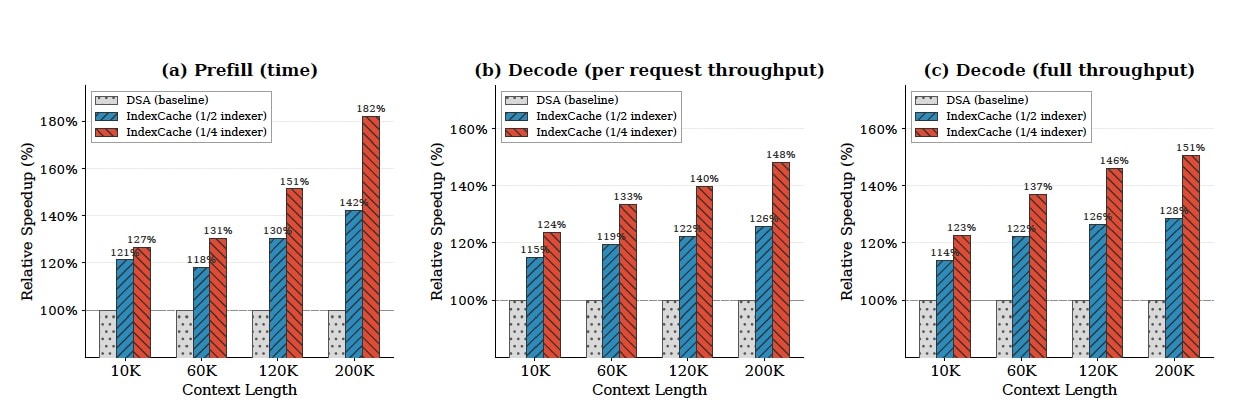

## Реальне прискорення на продакшн-моделях Щоб протестувати вплив IndexCache, дослідники застосували його до моделі GLM-4.7 Flash з 30 мільярдами параметрів та порівняли її зі стандартним базовим показником. При довжині контексту 200 тис. токенів видалення 75% індексаторів скоротило затримку префілу з 19,5 секунд до 10,7 секунд, забезпечивши прискорення в 1,82 рази. Дослідники зазначають, що це прискорення очікується ще більшим при довших контекстах. Під час фази декодування, коли модель генерує свою відповідь, IndexCache збільшив пропускну здатність на один запит з 58 токенів на секунду до 86 токенів на секунду при контексті 200 тис. токенів, що дало прискорення в 1,48 рази. Коли пам’ять сервера була повністю насичена запитами, загальна пропускна здатність декодування зросла до 51%.

Для корпоративних команд ці переваги ефективності безпосередньо означають економію коштів. «З точки зору ROI, IndexCache надає стабільні переваги в різних сценаріях, але найбільший ефект спостерігається при роботі з довгими контекстами, такими як RAG, аналіз документів та агентські конвеєри», — сказав Бай. «У цих випадках ми спостерігаємо зменшення вартості розгортання приблизно на 20% і подібні покращення в сприйнятій користувачем затримці». Він додав, що для завдань з дуже короткими контекстами переваги становлять близько 5%.

Примітно, що ці здобутки ефективності не вплинули на можливості міркування. Використовуючи метод без перенавчання для усунення 75% індексаторів, 30-мільярдна модель відповідала середньому показнику оригінальної базової моделі на тестах з довгим контекстом, набираючи 49,9 проти 50,2. На надзвичайно складному бенчмарку математичних міркувань AIME 2025 оптимізована модель фактично перевершила оригінальну базову модель, набравши 92,6 проти 91,0.

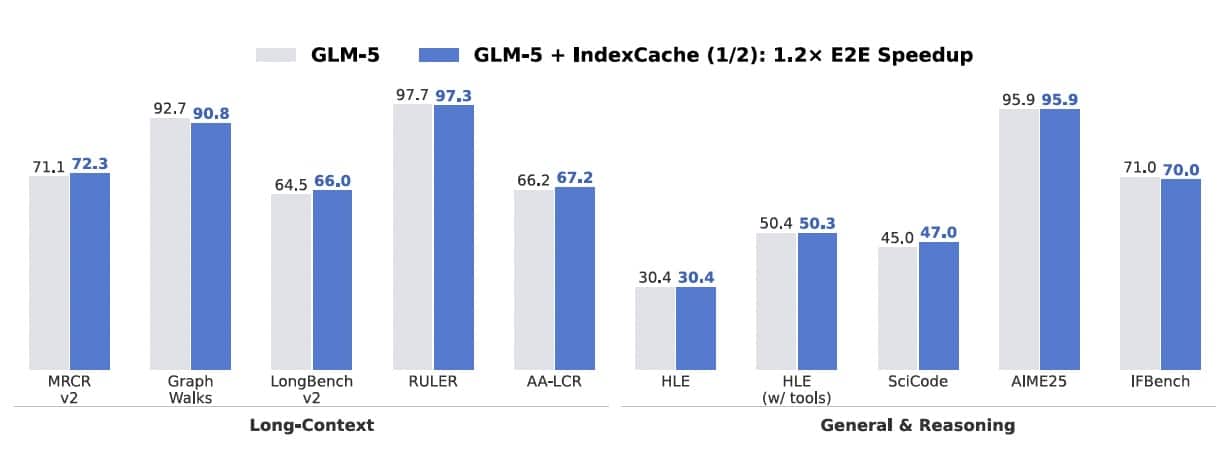

Команда також провела попередні експерименти на продакшн-моделі GLM-5 з 744 мільярдами параметрів. Вони виявили, що усунення 75% її індексаторів за допомогою методу без перенавчання забезпечило прискорення щонайменше в 1,3 рази на контекстах понад 100 тис. токенів. Водночас модель зберегла майже ідентичну середню якість на завданнях з довгим контекстом.

## Впровадження IndexCache у продакшн Для команд розробників, які хочуть впровадити метод без перенавчання вже сьогодні, процес є простим, але вимагає ретельного налаштування. Хоча алгоритм жадібного пошуку автоматично знаходить оптимальну конфігурацію шарів, якість цієї конфігурації залежить від даних, які він обробляє. «Ми рекомендуємо використовувати специфічні для домену дані як калібрувальний набір, щоб виявлена схема спільного використання шарів відповідала реальним робочим навантаженням», — сказав Бай. Після калібрування оптимізація є дуже доступною для виробничих середовищ. Відкриті патчі вже доступні на GitHub для основних середовищ обслуговування. «Інтеграція відносно проста — розробники можуть застосувати патч до існуючих стеків виведення, таких як vLLM або SGLang, і увімкнути IndexCache з мінімальними змінами конфігурації», — сказав Бай. Хоча IndexCache надає негайне вирішення сьогоднішніх обчислювальних вузьких місць, його основна філософія вказує на ширший зсув у підході ШІ-індустрії до дизайну моделей. «Майбутні фундаментальні моделі, ймовірно, будуть архітектуровані з урахуванням обмежень виведення в реальному світі з самого початку», — підсумував Бай. «Це означає дизайн, який не лише масштабується з точки зору розміру моделі, але й оптимізований для реальної пропускної здатності та затримки, а не розглядається як другорядне питання».

Прогноз ІТ-Блогу: IndexCache має потенціал стати галузевим стандартом для оптимізації моделей зі розрідженою увагою, значно знижуючи вартість їх розгортання та використання. Подальший розвиток цієї техніки, ймовірно, буде спрямований на її універсалізацію для різних архітектур ШІ та подальше зменшення обчислювальних ресурсів, необхідних для роботи моделей з дуже довгим контекстом.

Оригінал статті: venturebeat.com