Останні два роки підприємства, що оцінювали моделі з відкритим кодом, стикалися з непростим вибором. Сімейство моделей Gemma від Google стабільно демонструвало високу продуктивність, але його спеціальна ліцензія — з обмеженнями використання та умовами, які Google міг оновлювати на власний розсуд — змушувала багато команд звертати увагу на Mistral або Qwen від Alibaba. Юридичні перевірки ускладнювали процес. Команди з комплаєнсу виявляли неочевидні випадки. І, попри всю свою потужність, Gemma 3 з приміткою “відкрита” не була справді відкритою.

Gemma 4 повністю усуває цю перешкоду. Нове сімейство відкритих моделей від Google DeepMind постачається під стандартною ліцензією Apache 2.0 — такими ж дозвільними умовами, як у Qwen, Mistral, Arcee та більшості інших моделей з відкритим кодом.

Жодних індивідуальних пунктів, жодних винятків щодо “шкідливого використання”, що потребували б юридичного тлумачення, жодних обмежень на подальше розповсюдження чи комерційне розгортання. Для корпоративних команд, які чекали, доки Google гратиме за тими ж ліцензійними правилами, що й решта ринку, очікування завершилося.

Час випуску є показовим. У той час, як деякі китайські AI-лабораторії (найпомітніше — новітні моделі Qwen від Alibaba, Qwen3.5 Omni та Qwen 3.6 Plus) почали відмовлятися від повністю відкритих релізів для своїх найновіших моделей, Google рухається в протилежному напрямку — відкриває свій найпотужніший реліз Gemma на сьогодні, явно вказуючи, що архітектура спирається на дослідження його комерційної моделі Gemini 3.

Чотири моделі, два рівні: від периферійних пристроїв до робочих станцій в одному сімействі

Gemma 4 представлена чотирма окремими моделями, організованими у два рівні розгортання. Рівень “робоча станція” включає щільну модель з 31 мільярдом параметрів та модель Mixture-of-Experts (MoE) з 26 мільярдами активних параметрів (A4B) — обидві підтримують введення тексту та зображень з контекстними вікнами на 256 тисяч токенів. Рівень “периферійний пристрій” складається з моделей E2B та E4B, компактних рішень, розроблених для телефонів, вбудованих пристроїв та ноутбуків, з підтримкою тексту, зображень та аудіо у контекстних вікнах на 128 тисяч токенів.

Сама система найменування потребує певного роз’яснення. Префікс “E” означає “ефективні параметри” — E2B має 2,3 мільярда ефективних параметрів, але загалом 5,1 мільярда, оскільки кожен шар декодера несе власну невелику таблицю вбудовувань за допомогою техніки, яку Google називає Per-Layer Embeddings (PLE). Ці таблиці є великими на диску, але недорогими у обчисленні, тому модель працює як 2-мільярдна, хоча технічно важить більше.

Літера “A” в 26B A4B означає “активні параметри” — лише 3,8 мільярда з 25,2 мільярдів загальних параметрів моделі MoE активуються під час виведення, що означає, що вона забезпечує інтелект класу 26B з обчислювальними витратами, порівнянними з моделлю 4B.

Для ІТ-керівників, які оцінюють вимоги до GPU, це безпосередньо означає гнучкість розгортання. Модель MoE може працювати на GPU споживчого класу і швидко з’явиться в таких інструментах, як Ollama та LM Studio. Щільна модель на 31 мільярд потребує більше ресурсів — наприклад, NVIDIA H100 або RTX 6000 Pro для неквантованого виведення — але Google також постачає чекпоінти Quantization-Aware Training (QAT) для збереження якості при нижчій точності. У Google Cloud обидві моделі для робочих станцій тепер можуть працювати в повністю безсерверній конфігурації через Cloud Run з GPU NVIDIA RTX 6000 Pro, автоматично вимикаючись до нуля, коли вони не використовуються.

Ставка на MoE: 128 маленьких експертів для економії витрат на виведення

Архітектурні рішення всередині моделі 26B A4B заслуговують на особливу увагу команд, які оцінюють економіку виведення. Замість того, щоб наслідувати приклад останніх великих моделей MoE, які використовують жменьку великих експертів, Google зробив ставку на 128 маленьких експертів, активуючи вісім на токен плюс один спільний експерт, який завжди увімкнений. Результатом є модель, яка за результатами бенчмарків конкурує зі щільними моделями діапазону 27B–31B, працюючи при цьому приблизно зі швидкістю моделі 4B під час виведення.

Це не просто цікавинка для бенчмарків — це безпосередньо впливає на витрати на обслуговування. Модель, яка забезпечує міркування класу 27B при пропускній здатності класу 4B, означає менше GPU, нижчу затримку та дешевше виведення на токен у виробничому середовищі. Для організацій, які використовують помічників з кодування, конвеєри обробки документів або багаторазові агентські робочі процеси, варіант MoE може стати найпрактичнішим вибором у сімействі.

Обидві моделі для робочих станцій використовують гібридний механізм уваги, який чергує локальну увагу з ковзним вікном та повну глобальну увагу, причому останній шар завжди є глобальним. Ця конструкція дозволяє досягти 256K контекстного вікна, зберігаючи при цьому споживання пам’яті керованим — важливий аспект для команд, що обробляють довгі документи, кодові бази або багаторазові агентські діалоги.

Нативна мультимодальність: візуалізація, аудіо та виклик функцій вбудовані з нуля

Попередні покоління відкритих моделей зазвичай розглядали мультимодальність як доповнення. Візуальні кодувальники приєднувалися до текстових основ. Аудіо потребувало зовнішнього конвеєра ASR, як-от Whisper. Виклик функцій покладався на інженерію промптів і надію на те, що модель буде співпрацювати. Gemma 4 інтегрує всі ці можливості на архітектурному рівні.

Усі чотири моделі обробляють введення зображень зі змінним співвідношенням сторін з конфігурованими квотами візуальних токенів — значне покращення порівняно зі старим візуальним кодувальником Gemma 3n, який мав проблеми з OCR та розумінням документів. Новий кодувальник підтримує квоти від 70 до 1120 токенів на зображення, дозволяючи розробникам вибирати між деталізацією та обчислювальною потужністю залежно від завдання.

Нижчі квоти підходять для класифікації та створення підписів; вищі квоти — для OCR, розбору документів та детального візуального аналізу. Введення кількох зображень та відео (оброблене як послідовність кадрів) підтримується нативно, що дозволяє здійснювати візуальні міркування на основі кількох документів або скріншотів.

Дві моделі для периферійних пристроїв додають нативну обробку аудіо — автоматичне розпізнавання мовлення та перетворення мовлення на перекладений текст, все це — на пристрої. Аудіокодувальник був стиснутий до 305 мільйонів параметрів (порівняно з 681 мільйоном у Gemma 3n), тоді як тривалість кадру зменшилася з 160 мс до 40 мс для більш чутливого транскрибування. Для команд, які створюють мовні додатки, що потребують збереження даних локально — наприклад, у сфері охорони здоров’я, обслуговування польових працівників або багатомовної взаємодії з клієнтами — запуск ASR, перекладу, міркувань та виклику функцій в одній моделі на телефоні чи периферійному пристрої є справжнім архітектурним спрощенням.

Виклик функцій також є нативним для всіх чотирьох моделей, спираючись на дослідження випуску FunctionGemma від Google наприкінці минулого року. На відміну від попередніх підходів, які покладалися на дотримання інструкцій, щоб спонукати моделі до структурованого використання інструментів, виклик функцій Gemma 4 був вбудований у модель з самого початку — оптимізований для багаторазових агентських потоків з кількома інструментами. Це відображається в агентських бенчмарках, але, що важливіше, зменшує накладні витрати на інженерію промптів, які корпоративні команди зазвичай несуть, створюючи агентів, що використовують інструменти.

Бенчмарки в контексті: де Gemma 4 посідає місце у переповненому полі

Цифри бенчмарків чітко показують покращення покоління. Щільна модель на 31 мільярд отримує 89,2% на AIME 2026 (суворий тест на математичні міркування), 80,0% на LiveCodeBench v6 та досягає ELO Codeforces 2150 — показники, які ще недавно вважалися б передовими для пропрієтарних моделей. У сфері візуального аналізу MMMU Pro досягає 76,9%, а MATH-Vision — 85,6%.

Для порівняння, Gemma 3 27B отримала 20,8% на AIME та 29,1% на LiveCodeBench без режиму “thinking”.

Модель MoE показує схожі результати: 88,3% на AIME 2026, 77,1% на LiveCodeBench та 82,3% на GPQA Diamond — бенчмарку з міркувань у галузі науки на рівні аспірантури. Розрив у продуктивності між варіантами MoE та щільною моделлю незначний, враховуючи значну перевагу архітектури MoE у витратах на виведення.

Моделі для периферійних пристроїв перевершують свій клас. E4B досягає 42,5% на AIME 2026 та 52,0% на LiveCodeBench — чудовий результат для моделі, що працює на GPU T4. E2B, ще менша, демонструє 37,5% та 44,0% відповідно. Обидві моделі значно перевершують Gemma 3 27B (без режиму “thinking”) за більшістю бенчмарків, попри те, що вони є частиною її розміру, завдяки вбудованій здатності до міркувань.

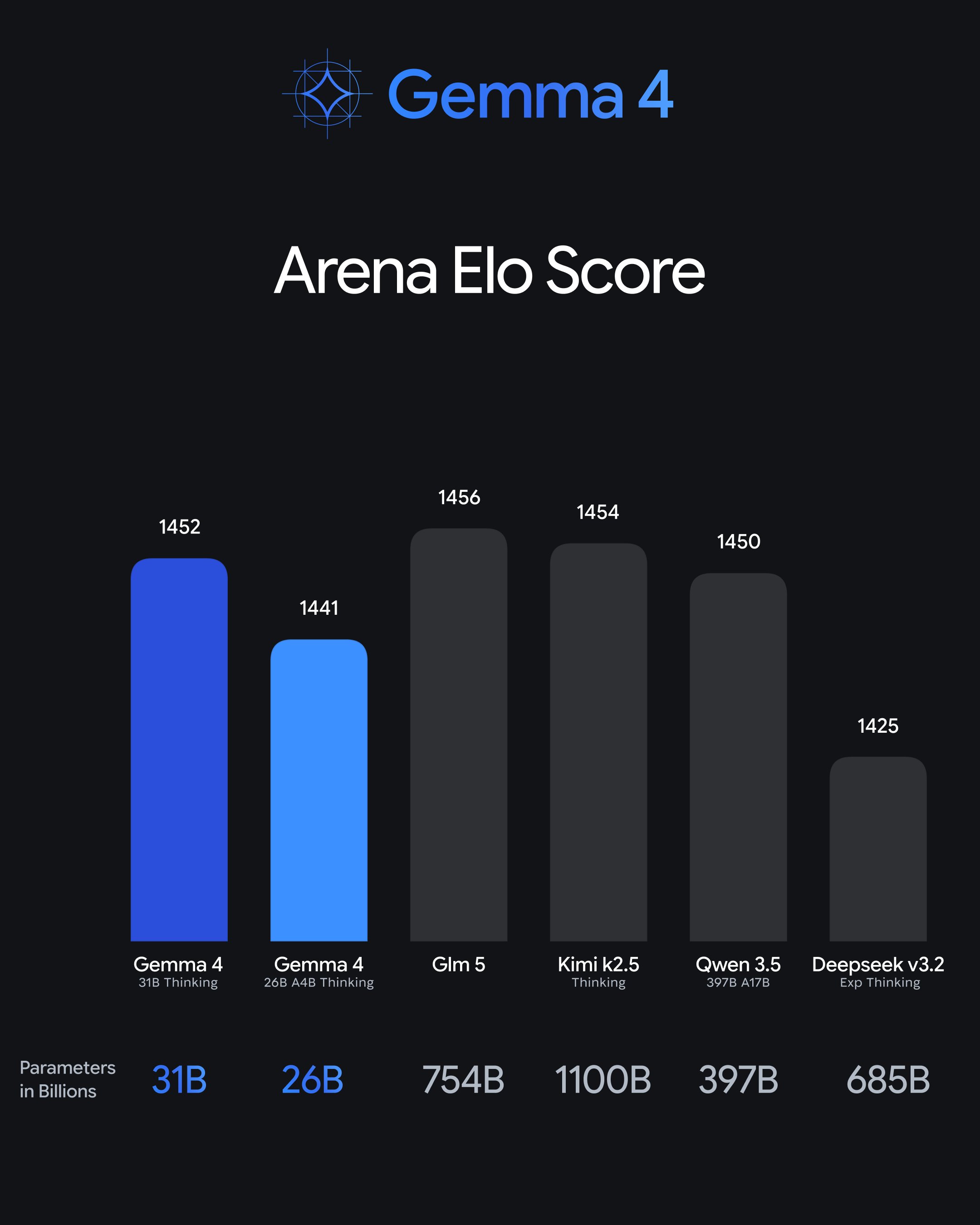

Ці показники слід розглядати на тлі все більш конкурентного ландшафту відкритих моделей. Qwen 3.5, GLM-5 та Kimi K2.5 агресивно конкурують у цьому діапазоні параметрів, і поле швидко розвивається. Gemma 4 відрізняється не окремим бенчмарком, а скоріше комбінацією: потужні міркування, нативна мультимодальність у тексті, візуалізації та аудіо, виклик функцій, 256K контекст і справді дозвільна ліцензія — все в одному сімействі моделей з варіантами розгортання від периферійних пристроїв до хмарних безсерверних рішень.

На що звернути увагу корпоративним командам далі

Google випускає як попередньо навчені базові моделі, так і варіанти, що пройшли інструктивне доналаштування, що важливо для організацій, які планують точне налаштування для конкретних доменів. Базові моделі Gemma історично були міцною основою для кастомного навчання, а ліцензія Apache 2.0 тепер усуває будь-яку невизначеність щодо того, чи можуть похідні моделі, що пройшли точне налаштування, комерційно розгортатися.

Варіант безсерверного розгортання через Cloud Run з підтримкою GPU варто розглянути командам, яким потрібна потужність виведення, що масштабується до нуля. Оплата лише за фактичні обчислення під час виведення, а не за підтримку постійно увімкнених GPU-інстансів, може суттєво змінити економіку розгортання відкритих моделей у виробництві, особливо для внутрішніх інструментів та додатків з низьким трафіком.

Google натякнув, що це може бути не повне сімейство Gemma 4, і, ймовірно, з’являться додаткові розміри моделей. Але наявна сьогодні комбінація — моделі міркувань класу робочих станцій та мультимодальні моделі класу периферійних пристроїв, усі під ліцензією Apache 2.0, усі спираються на дослідження Gemini 3 — є найповнішим релізом відкритої моделі, який Google випустив. Для корпоративних команд, які чекали, доки відкриті моделі Google почнуть конкурувати за ліцензійними умовами так само, як і за продуктивністю, оцінка нарешті може розпочатися без попереднього звернення до юридичного відділу.

Прогноз ІТ-Блогу: Gemma 4, ймовірно, стане каталізатором для створення нових, більш доступних мультимодальних додатків, особливо на периферійних пристроях, завдяки своїй інтегрованій здатності обробляти різні типи даних. Очікується, що Apache 2.0 ліцензія значно прискорить комерційне впровадження та інновації навколо цієї моделі.

Інформація підготовлена на основі матеріалів: venturebeat.com