Поява “кита” – знакова подія в галузі штучного інтелекту. Китайський стартап DeepSeek, що є частиною інвестиційної компанії High-Flyer Capital Management, у січні 2025 року стрімко здобув світову популярність завдяки випуску відкритої моделі R1, яка за своїми характеристиками зрівнялася з пропрієтарними гігантами зі США.

З того часу минула ціла епоха в розвитку ШІ. Хоча DeepSeek випустила кілька оновлень для R1 та інших моделей серії V3, міжнародна спільнота ШІ та бізнесу з нетерпінням очікувала наступного прориву після моменту R1. І ось він настав: нещодавній випуск DeepSeek-V4 – моделі на 1.6 трильйона параметрів, побудованої за архітектурою Mixture-of-Experts (MoE). Ця модель доступна безкоштовно під комерційно дружньою відкритою ліцензією MIT, а її продуктивність на деяких тестах перевищує показники найсучасніших закритих систем, при цьому вартість доступу через API становить приблизно 1/6 від конкурентів.

Цей реліз, який дослідник DeepSeek AI Делі Чен назвав «працею любові» в своєму дописі в X (484 дні після запуску V3), вже називають «другим моментом DeepSeek». Як зазначив Чен, «AGI (штучний загальний інтелект) належить усім». Модель вже доступна на платформі Hugging Face та через API DeepSeek.

Передові ШІ-технології стають доступнішими

Найбезпосередніший вплив запуску DeepSeek-V4 полягає в економічному аспекті. Хоча DeepSeek не встановлює ціни на нову модель Pro на рівні «майже нульових», вона суттєво знижує вартість доступу до передових моделей, роблячи її значно нижчою, ніж у провідних американських компаній.

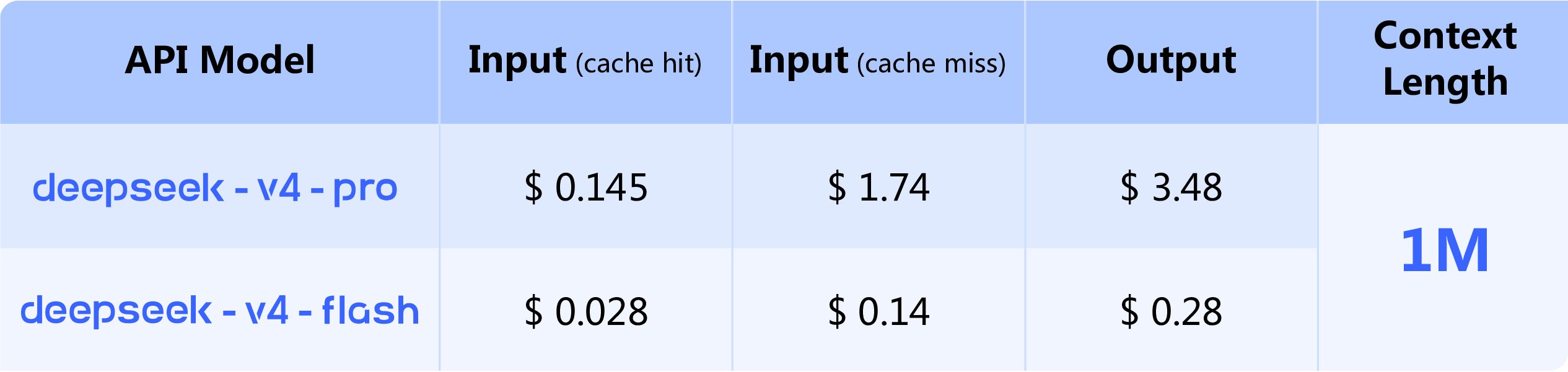

DeepSeek-V4-Pro через API коштує $1.74 USD за 1 мільйон вхідних токенів (у разі відсутності кешування) та $3.48 за 1 мільйон вихідних токенів.

Просте порівняння мільйона вхідних та мільйона вихідних токенів коштуватиме $5.22. При використанні кешу вхідних даних ціна за мільйон вхідних токенів знижується до $0.145, що знижує загальну вартість порівняння до $3.625.

Це значно дешевше, ніж поточні преміальні ціни від OpenAI та Anthropic. GPT-5.5 коштує $5.00 за 1 мільйон вхідних токенів та $30.00 за 1 мільйон вихідних токенів, що становить сумарно $35.00 при такому ж простому порівнянні.

Claude Opus 4.7 коштує $5.00 за вхід та $25.00 за вихід, сумарно $30.00.

|

Модель |

Вхід (за 1 млн токенів) |

Вихід (за 1 млн токенів) |

Загальна вартість (1 млн вх. + 1 млн вих.) |

Розробник |

|

Grok 4.1 Fast |

$0.20 |

$0.50 |

$0.70 |

xAI |

|

MiniMax M2.7 |

$0.30 |

$1.20 |

$1.50 |

MiniMax |

|

Gemini 3 Flash |

$0.50 |

$3.00 |

$3.50 |

|

|

Kimi-K2.5 |

$0.60 |

$3.00 |

$3.60 |

Moonshot |

|

MiMo-V2-Pro (≤256K) |

$1.00 |

$3.00 |

$4.00 |

Xiaomi MiMo |

|

GLM-5 |

$1.00 |

$3.20 |

$4.20 |

Z.ai |

|

GLM-5-Turbo |

$1.20 |

$4.00 |

$5.20 |

Z.ai |

|

DeepSeek-V4-Pro |

$1.74 |

$3.48 |

$5.22 |

DeepSeek |

|

GLM-5.1 |

$1.40 |

$4.40 |

$5.80 |

Z.ai |

|

Claude Haiku 4.5 |

$1.00 |

$5.00 |

$6.00 |

Anthropic |

|

Qwen3-Max |

$1.20 |

$6.00 |

$7.20 |

Alibaba Cloud |

|

Gemini 3 Pro |

$2.00 |

$12.00 |

$14.00 |

|

|

GPT-5.2 |

$1.75 |

$14.00 |

$15.75 |

OpenAI |

|

GPT-5.4 |

$2.50 |

$15.00 |

$17.50 |

OpenAI |

|

Claude Sonnet 4.5 |

$3.00 |

$15.00 |

$18.00 |

Anthropic |

|

Claude Opus 4.7 |

$5.00 |

$25.00 |

$30.00 |

Anthropic |

|

GPT-5.5 |

$5.00 |

$30.00 |

$35.00 |

OpenAI |

|

GPT-5.4 Pro |

$30.00 |

$180.00 |

$210.00 |

OpenAI |

За стандартними тарифами (без кешування) DeepSeek-V4-Pro приблизно в 7 разів дешевший за GPT-5.5 та приблизно в 6 разів дешевший за Claude Opus 4.7.

З кешуванням вхідних даних розрив стає ще більшим: DeepSeek-V4-Pro коштує приблизно в 10 разів менше, ніж GPT-5.5, і приблизно в 8 разів менше, ніж Claude Opus 4.7.

Ще більш вражаюча економія стосується моделі DeepSeek-V4-Flash, а не Pro. Flash коштує $0.14 за 1 мільйон вхідних токенів (без кешування) та $0.28 за 1 мільйон вихідних токенів, що становить сумарно $0.42.

З кешуванням вхідних даних ця цифра знижується до $0.308. У такому випадку, дешевша модель DeepSeek коштує на понад 98% менше, ніж GPT-5.5 та Claude Opus 4.7 (у простому порівнянні вхід + вихід), або майже в 100 разів дешевше – хоча продуктивність суттєво знижується.

DeepSeek суттєво знижує вартість передових моделей, змушуючи розробників та компанії переглядати співвідношення витрат і вигод при використанні преміальних закритих моделей. Для компаній, що обробляють великі обсяги даних, ця різниця в ціні може вплинути на те, які завдання будуть автоматизовані. Завдання, які здаються надто дорогими для GPT-5.5 або Claude Opus 4.7, можуть стати економічно вигідними на DeepSeek-V4-Pro, і тим паче на DeepSeek-V4-Flash. Цей запуск не робить інтелект безкоштовним, але ускладнює захист ринку для преміальних постачальників, що базуються виключно на продуктивності.

Тестування на передових бенчмарках: DeepSeek-V4-Pro наближається, але GPT-5.5 та Opus 4.7 залишаються лідерами

DeepSeek-V4-Pro-Max слід розглядати як значний стрибок у сфері відкритих моделей, а не як повне витіснення найновіших закритих систем.

Найсильніші показники моделі демонструються у власних таблицях порівняння DeepSeek, де вона виступає проти GPT-5.4 xHigh, Claude Opus 4.6 Max та Gemini 3.1 Pro High, перевершуючи їх у деяких тестах, зокрема Codeforces та Apex Shortlist.

Однак це не те саме, що пряме порівняння з новішими GPT-5.5 від OpenAI або Claude Opus 4.7 від Anthropic.

Розглядаючи лише DeepSeek-V4 проти останніх пропрієтарних моделей, картина виглядає більш стримано. На спільних тестах GPT-5.5 та Claude Opus 4.7 все ще лідирують у більшості категорій.

Найкращий результат DeepSeek-V4-Pro-Max демонструє в BrowseComp – бенчмарку, що вимірює здатність агентів ШІ до навігації в мережі (зокрема, вилучення висококонтейнеризованої інформації). Тут модель набирає 83.4%, трохи поступаючись GPT-5.5 (84.4%), але випереджаючи Claude Opus 4.7 (79.3%).

На Terminal-Bench 2.0 DeepSeek показує результат 67.9%, що близько до показника Claude Opus 4.7 (69.4%), але значно відстає від GPT-5.5 (82.7%).

|

Бенчмарк |

DeepSeek-V4-Pro-Max |

GPT-5.5 |

GPT-5.5 Pro (де вказано) |

Claude Opus 4.7 |

Найкращий результат серед цих |

|

GPQA Diamond |

90.1% |

93.6% |

— |

94.2% |

Claude Opus 4.7 |

|

Humanity’s Last Exam, без інструментів |

37.7% |

41.4% |

43.1% |

46.9% |

Claude Opus 4.7 |

|

Humanity’s Last Exam, з інструментами |

48.2% |

52.2% |

57.2% |

54.7% |

GPT-5.5 Pro |

|

Terminal-Bench 2.0 |

67.9% |

82.7% |

— |

69.4% |

GPT-5.5 |

|

SWE-Bench Pro / SWE Pro |

55.4% |

58.6% |

— |

64.3% |

Claude Opus 4.7 |

|

BrowseComp |

83.4% |

84.4% |

90.1% |

79.3% |

GPT-5.5 Pro |

|

MCP Atlas / MCPAtlas Public |

73.6% |

75.3% |

— |

79.1% |

Claude Opus 4.7 |

На тестах академічного рівня лідирують закриті моделі: на GPQA Diamond DeepSeek-V4-Pro-Max набирає 90.1%, тоді як GPT-5.5 досягає 93.6%, а Claude Opus 4.7 – 94.2%. На Humanity’s Last Exam без інструментів DeepSeek показує 37.7%, поступаючись GPT-5.5 (41.4%), GPT-5.5 Pro (43.1%) та Claude Opus 4.7 (46.9%). З інструментами DeepSeek покращує результат до 48.2%, але все ще відстає від GPT-5.5 (52.2%), GPT-5.5 Pro (57.2%) та Claude Opus 4.7 (54.7%).

Результати тестів на програмну інженерію та роботу агентів є більш змішаними, але все ж свідчать про те, що DeepSeek-V4-Pro-Max поступається GPT-5.5 та Opus 4.7. На Terminal-Bench 2.0 результат DeepSeek (67.9%) є конкурентним щодо Claude Opus 4.7 (69.4%), але GPT-5.5 значно випереджає (82.7%). На SWE-Bench Pro показник DeepSeek (55.4%) поступається GPT-5.5 (58.6%) та Claude Opus 4.7 (64.3%). На MCP Atlas результат DeepSeek (73.6%) трохи відстає від GPT-5.5 (75.3%) та Claude Opus 4.7 (79.1%). BrowseComp є винятком: 83.4% DeepSeek випереджає Claude Opus 4.7 (79.3%) і майже зрівнюється з GPT-5.5 (84.4%), хоча GPT-5.5 Pro (90.1%) залишається далеко попереду.

Отже, DeepSeek-V4-Pro-Max не перевершує GPT-5.5 чи Claude Opus 4.7 за всіма прямими порівняннями. Проте, вона демонструє настільки високі результати на багатьох практичних бенчмарках, що значно нижча вартість доступу через API стає головною перевагою. Для багатьох корпоративних завдань, де потрібна продуктивність, близька до передових систем, значно нижча вартість DeepSeek-V4-Pro змушує переглядати економічну доцільність використання сучасного ШІ.

DeepSeek-V4-Pro-Max, безумовно, є найпотужнішою відкритою моделлю на сьогодні, яка надзвичайно наближається до закритих систем за показниками на багатьох практичних тестах. Хоча GPT-5.5 та Claude Opus 4.7 все ще утримують лідерство в більшості прямих порівнянь, DeepSeek V4 Pro пропонує майже таку ж якість за значно нижчою ціною та у відкритому доступі.

Значний прогрес порівняно з DeepSeek V3.2

Щоб зрозуміти масштаб цього релізу, варто розглянути показники продуктивності базових моделей. DeepSeek-V4-Pro-Base є значним кроком вперед порівняно з попереднім поколінням, DeepSeek-V3.2-Base. У тесті World Knowledge V4-Pro-Base досягла 90.1 на MMLU (5-shot) проти 87.8 у V3.2, і продемонструвала значне покращення на MMLU-Pro – з 65.5 до 73.5.

Покращення у високорівневому аналізі та верифікації фактів ще більш вражаючі: на SuperGPQA V4-Pro-Base досягла 53.9 проти 45.0 у V3.2, а на бенчмарку FACTS Parametric показник зріс з 27.1 до 62.6, більш ніж подвоївши результат попередника. Прості відповіді на запитання (Simple-QA) також значно покращилися – з 28.3 до 55.2.

Можливості роботи з довгим контекстом також були вдосконалені. На LongBench-V2 V4-Pro-Base показала 51.5, суттєво випередивши 40.2, досягнуті V3.2-Base. У сфері програмування та математики V4-Pro-Base досягла 76.8 на HumanEval (Pass@1), порівняно з 62.8 у V3.2-Base.

Ці цифри підкреслюють, що DeepSeek не тільки оптимізувала витрати на виведення, але й фундаментально покращила щільність інтелекту своєї базової архітектури. Ефективність варіанту Flash також є вражаючою. DeepSeek-V4-Flash-Base, попри значно меншу кількість параметрів, перевершує більшу V3.2-Base за багатьма показниками, особливо в сценаріях з довгим контекстом.

Новий «регулятор інформації»: Manifold-Constrained Hyper-Connections (mHC)

Здатність DeepSeek пропонувати такі ціни та показники продуктивності ґрунтується на радикальних архітектурних інноваціях, детально описаних у технічному звіті «Towards Highly Efficient Million-Token Context Intelligence», який також був опублікований сьогодні. Ключовим технічним досягненням V4 є нативний контекстний вікно до 1 мільйона токенів. Історично для підтримки такого обсягу контексту вимагалася значна пам’ять (KV-кеш). DeepSeek вирішила цю проблему, представивши гібридну архітектуру уваги (Hybrid Attention Architecture), яка поєднує стиснену розріджену увагу (Compressed Sparse Attention – CSA) для зменшення початкової розмірності токенів та інтенсивно стиснену увагу (Heavily Compressed Attention – HCA) для агресивного стиснення обсягу пам’яті при обробці віддалених залежностей. На практиці модель V4-Pro потребує лише 10% KV-кешу та 27% обчислень FLOPs за токен порівняно з попередником DeepSeek-V3.2, навіть при роботі з 1 млн токенів контексту.

Для стабілізації мережі з 1.6 трильйона параметрів DeepSeek вийшла за межі традиційних залишкових з’єднань. Дослідники компанії інтегрували Manifold-Constrained Hyper-Connections (mHC) для посилення поширення сигналу між шарами, зберігаючи при цьому виразність моделі. mHC дозволяє ШІ мати набагато ширший потік інформації (для вивчення складніших речей) без ризику нестабільності моделі під час навчання. Це схоже на те, як місту надають 10-смугову магістраль, але додають досконалий ШІ-регулювальник, щоб ніхто ніколи не гальмував.

Це доповнюється оптимізатором Muon, який дозволив команді досягти швидшого збіжності та більшої стабільності під час попереднього навчання на понад 32 трлн різноманітних і високоякісних токенів. Ці дані для попереднього навчання були ретельно відібрані для видалення автоматично згенерованого контенту, що зменшує ризик колапсу моделі та пріоритезує унікальні академічні цінності. 1.6 трлн параметрів моделі використовують дизайн Mixture-of-Experts (MoE), де активується лише 49 млрд параметрів на токен, що додатково знижує обчислювальні вимоги.

Навчання Mixture-of-Experts (MoE) для злагодженої роботи

DeepSeek-V4 не просто навчалася, а була «вирощена» за унікальною двоступеневою парадигмою:

-

Незалежне вирощування експертів (Independent Expert Cultivation): Спеціалізовані експерти доменної області проходили навчання за допомогою Supervised Fine-Tuning (SFT) та Reinforcement Learning (RL), використовуючи алгоритм GRPO (Group Relative Policy Optimization). Це дозволило кожному експерту опанувати спеціалізовані навички, такі як математичний аналіз або аналіз коду.

-

Уніфікована консолідація моделі (Unified Model Consolidation): Цей етап об’єднував окремі компетенції в єдину модель шляхом дистиляції на основі on-policy, де уніфікована модель виступає в ролі студента, оптимізуючи зворотні KL-втрати з моделями-вчителями. Цей процес дистиляції гарантує, що модель зберігає спеціалізовані можливості кожного експерта, працюючи як єдине ціле.

Можливості моделі для аналізу поділені на три зростаючі режими «зусиль» (effort modes):

-

Режим «Без роздумів» (Non-think mode):** надає швидкі, інтуїтивні відповіді для рутинних завдань.

-

Режим «Високі роздуми» (Think High):** забезпечує свідомий логічний аналіз для вирішення складних проблем.

-

Режим «Максимальні роздуми» (Think Max):** розширює межі аналізу моделі, скорочуючи розрив з передовими моделями у складних завданнях аналізу та роботі агентів. Ця гнучкість дозволяє користувачам співвідносити обчислювальні зусилля зі складністю завдання, додатково підвищуючи економічну ефективність.

Подолання монополії GPU від Nvidia за допомогою китайських NPU Huawei

Хоча ваги моделі є найважливішою частиною, програмний стек, випущений разом з нею, є, мабуть, ще важливішим для майбутнього «суверенного ШІ». Аналітик Руї Ма виділив одне речення з релізу як найбільш значуще: DeepSeek успішно протестувала свою детальну схему Expert Parallelism (EP) на NPU (нейронних процесорних блоках) Huawei Ascend. Досягнувши прискорення від 1.50x до 1.73x на платформах, що не базуються на GPU Nvidia, DeepSeek надала план для високопродуктивних розгортань ШІ, стійких до західних ланцюжків постачання GPU та експортних обмежень.

Важливо зазначити, що DeepSeek стверджує, що для навчання DeepSeek V4 використовувалися як офіційно ліцензовані, законні GPU Nvidia, так і NPU Huawei.

DeepSeek також випустила у відкритий доступ ядро MegaMoE як частину своєї бібліотеки DeepGEMM. Ця реалізація на базі CUDA забезпечує прискорення до 1.96x для завдань, чутливих до затримок, таких як розгортання RL та швидке обслуговування агентів. Цей крок гарантує, що розробники можуть ефективно запускати ці величезні моделі на наявному обладнанні, ще більше зміцнюючи роль DeepSeek як основного рушія інфраструктури відкритого ШІ. Технічний звіт наголошує, що ці оптимізації є ключовими для підтримки стандартного контексту довжиною 1 мільйон токенів у всіх офіційних сервісах.

Ліцензування та локальне розгортання

DeepSeek-V4 випускається під ліцензією MIT – найбільш дозвільною в галузі. Це дозволяє розробникам використовувати, копіювати, модифікувати та розповсюджувати ваги моделі для комерційних цілей без роялті. Це різко контрастує з «обмеженими» ліцензіями з відкритими вагами, які віддають перевагу інші компанії. Для локального розгортання DeepSeek рекомендує встановлювати параметри вибірки temperature = 1.0 та top_p = 1.0. Для тих, хто використовує режим «Максимальні роздуми», команда пропонує встановлювати довжину контекстного вікна щонайменше 384K токенів, щоб уникнути скорочення внутрішніх ланцюжків міркувань моделі.

Реліз включає окрему папку з кодуванням Python-скриптів, що демонструють, як кодувати повідомлення у форматі, сумісному з OpenAI, та парсити вихідні дані моделі, включаючи вміст міркувань. DeepSeek-V4 також легко інтегрується з провідними агентними системами, такими як Claude Code, OpenClaw та OpenCode. Ця нативна інтеграція підкреслює її роль як основи для інструментів розробника, надаючи відкриту альтернативу пропрієтарним екосистемам великих хмарних провайдерів.

Реакція спільноти та подальші кроки

Реакція спільноти була одночасно шокуючою та підтверджуючою. Hugging Face офіційно привітав повернення «кита», заявивши, що ера доступного контексту довжиною 1 мільйон токенів настала. Експерти галузі зазначили, що «другий момент DeepSeek» фактично перевернув траєкторію розвитку всього напрямку, створивши величезний тиск на закритих постачальників, таких як OpenAI та Anthropic, змушуючи їх обґрунтовувати свої преміальні ціни. AI-оцінювальна компанія Vals AI зазначила, що DeepSeek-V4 тепер є «№1 відкритою моделлю в нашому Vibe Code Benchmark, і це без конкуренції».

DeepSeek швидко відмовляється від старих архітектур. Компанія оголосила, що застарілі кінцеві точки deepseek-chat і deepseek-reasoner будуть повністю виведені з експлуатації 24 липня 2026 року. Весь трафік наразі перенаправляється на архітектуру V4-Flash, що свідчить про повний перехід до стандарту мільйона токенів.

DeepSeek-V4 – це більше, ніж просто нова модель; це виклик статус-кво. Довівши, що архітектурні інновації можуть замінити сиру обчислювальну потужність, DeepSeek зробила передові інтелектуальні можливості ШІ доступними для світової спільноти розробників за значно нижчою ціною. Це може принести користь усьому світу, навіть попри занепокоєння законодавців у Вашингтоні щодо китайських лабораторій, які «дистилюють» пропрієтарні технології США для навчання відкритих моделей, та страхи щодо використання відкритих або зламаних пропрієтарних моделей для створення зброї та тероризму.

Істина полягає в тому, що, хоча всі ці ризики існують (як вони існували з попередніми технологіями, що розширили доступ до інформації, такими як пошук та сам Інтернет), переваги, здається, значно їх переважають. Прагнення DeepSeek зберегти відкритість передових моделей ШІ приносить користь усім потенційним користувачам ШІ на планеті, особливо підприємствам, які прагнуть впроваджувати передові технології за найнижчою можливою ціною.

Прогноз ІТ-Блогу: DeepSeek-V4 стане каталізатором для ширшого впровадження передових ШІ-технологій у малих та середніх підприємствах, а також у стартапах, які раніше не могли собі дозволити преміальні моделі. Ми очікуємо, що конкуренція в сегменті відкритих моделей загостриться, змушуючи великих гравців переглядати свої цінові стратегії та, можливо, випускати власні відкриті версії своїх передових розробок.

Інформація підготовлена на основі матеріалів: venturebeat.com