Вплив новітніх розробок ШІ від Alibaba на галузь

Команда розробників Alibaba, відома своїми досягненнями у сфері штучного інтелекту, знову продемонструвала свій потенціал. Нещодавно вони представили серію великих мовних моделей (LLM) Qwen3.5 Medium, що включає чотири нові моделі з підтримкою виклику агентських інструментів. Три з цих моделей доступні для комерційного використання підприємствами та незалежними розробниками під стандартною ліцензією Apache 2.0.

-

Qwen3.5-35B-A3B

-

Qwen3.5-122B-A10B

-

Qwen3.5-27B

Розробники можуть завантажити ці моделі з платформ Hugging Face та ModelScope. Четверта модель, Qwen3.5-Flash, має пропрієтарний характер і доступна виключно через API Alibaba Cloud Model Studio. Проте, навіть у такому вигляді, вона пропонує значну перевагу у вартості порівняно з аналогічними західними моделями (див. порівняльну таблицю нижче).

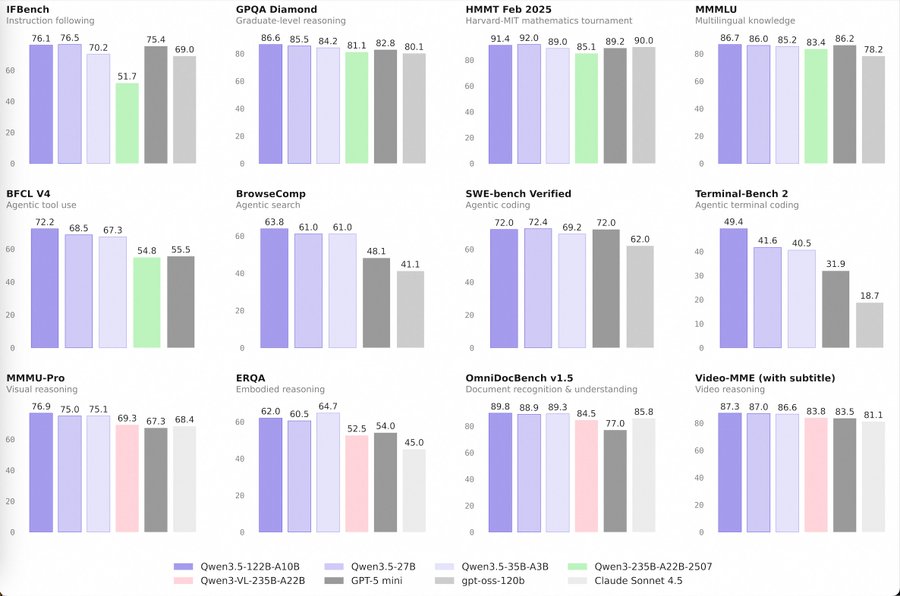

Ключовою особливістю цих моделей з відкритим кодом є їхня висока продуктивність на сторонніх бенчмарках, яка порівнянна з пропрієтарними моделями аналогічного розміру від провідних американських стартапів, таких як OpenAI або Anthropic. Зокрема, Qwen3.5 перевершує OpenAI GPT-5-mini та Anthropic Claude Sonnet 4.5 — останню модель, що була випущена лише п’ять місяців тому.

Команда Qwen також заявляє, що ці моделі розроблені таким чином, щоб зберігати високу точність навіть після процесу “квантизації”. Це технічний процес, що зменшує розмір моделі шляхом скорочення кількості значень, які використовуються для збереження налаштувань моделі, з багатьох до значно меншої кількості.

Важливо, що цей реліз привносить “граничний” контекст вікна настільні ПК. Флагманська модель Qwen3.5-35B-A3B тепер здатна обробляти понад 1 мільйон токенів контексту на споживчих графічних процесорах з 32 ГБ відеопам’яті. Хоча це не є загальнодоступним рішенням, це значно менші обчислювальні потужності, ніж потребують багато інших моделей зі схожою продуктивністю.

Цей стрибок у продуктивності став можливим завдяки майже безвтратній точності при 4-бітній квантизації ваг та KV кешу, що дозволяє розробникам обробляти величезні масиви даних без необхідності використання серверної інфраструктури.

Технологія: Гібридна архітектура для максимальної ефективності

В основі продуктивності Qwen 3.5 лежить складна гібридна архітектура. На відміну від багатьох моделей, що покладаються виключно на стандартні блоки Transformer, Qwen 3.5 інтегрує Gated Delta Networks у поєднанні з розрідженою системою Mixture-of-Experts (MoE). Технічні характеристики Qwen3.5-35B-A3B виявляють високоефективний дизайн:

-

Ефективність параметрів: Хоча модель містить загалом 35 мільярдів параметрів, для обробки кожного токена активуються лише 3 мільярди.

-

Різноманітність експертів: Шар MoE використовує 256 експертів, з яких 8 маршрутизованих та 1 спільний експерт допомагають підтримувати продуктивність, одночасно значно скорочуючи затримку виведення.

-

Квантизація майже без втрат: Серія зберігає високу точність навіть при стисненні до 4-бітних ваг, що суттєво зменшує вимоги до пам’яті для локального розгортання.

-

Відкритий базовий код: Для підтримки дослідницької спільноти Alibaba відкрила базову модель Qwen3.5-35B-A3B-Base поряд з версіями, оптимізованими для конкретних завдань.

Продукт: Інтелект, що спершу “обмірковує”

Qwen 3.5 за замовчуванням використовує власний “Режим мислення” (Thinking Mode). Перед наданням остаточної відповіді модель генерує внутрішній ланцюжок міркувань, обмежений тегами <think>, для вирішення складних логічних задач. Лінійка продуктів адаптована до різних апаратних середовищ:

-

Qwen3.5-27B: Оптимізована для високої ефективності, підтримує довжину контексту понад 800 тис. токенів.

-

Qwen3.5-Flash: Хостингова версія для виробничого використання, що пропонує стандартний контекст довжиною 1 мільйон токенів та вбудовані офіційні інструменти.

-

Qwen3.5-122B-A10B: Розроблена для серверних GPU (80 ГБ VRAM), ця модель підтримує контекст понад 1 мільйон токенів, скорочуючи розрив з найбільшими світовими моделями.

Результати бенчмарків підтверджують цей архітектурний зсув. Модель 35B-A3B помітно перевершує значно більші попередні версії, такі як Qwen3-235B, а також згадані пропрієтарні GPT-5 mini та Sonnet 4.5 у таких категоріях, як знання (MMMLU) та візуальне міркування (MMMU-Pro).

Ціноутворення та інтеграція API

Для тих, хто не займається самостійним розміщенням моделей, Alibaba Cloud Model Studio пропонує конкурентоспроможний API для Qwen3.5-Flash.

-

Вхідні дані: $0.1 за 1 мільйон токенів

-

Вихідні дані: $0.4 за 1 мільйон токенів

-

Створення кешу: $0.125 за 1 мільйон токенів

-

Читання кешу: $0.01 за 1 мільйон токенів

API також має детальну модель ціноутворення для виклику інструментів: Веб-пошук коштує $10 за 1000 викликів, а Code Interpreter наразі пропонується безкоштовно протягом обмеженого часу.

Це робить Qwen3.5-Flash однією з найдоступніших для використання через API серед усіх основних LLM у світі. Порівняльна таблиця представлена нижче:

|

Модель |

Вхідні дані |

Вихідні дані |

Загальна вартість |

Джерело |

|

Qwen 3 Turbo |

$0.05 |

$0.20 |

$0.25 |

Alibaba Cloud |

|

Qwen3.5-Flash |

$0.10 |

$0.40 |

$0.50 |

Alibaba Cloud |

|

deepseek-chat (V3.2-Exp) |

$0.28 |

$0.42 |

$0.70 |

DeepSeek |

|

deepseek-reasoner (V3.2-Exp) |

$0.28 |

$0.42 |

$0.70 |

DeepSeek |

|

Grok 4.1 Fast (reasoning) |

$0.20 |

$0.50 |

$0.70 |

xAI |

|

Grok 4.1 Fast (non-reasoning) |

$0.20 |

$0.50 |

$0.70 |

xAI |

|

MiniMax M2.5 |

$0.15 |

$1.20 |

$1.35 |

MiniMax |

|

MiniMax M2.5-Lightning |

$0.30 |

$2.40 |

$2.70 |

MiniMax |

|

Gemini 3 Flash Preview |

$0.50 |

$3.00 |

$3.50 |

|

|

Kimi-k2.5 |

$0.60 |

$3.00 |

$3.60 |

Moonshot |

|

GLM-5 |

$1.00 |

$3.20 |

$4.20 |

Z.ai |

|

ERNIE 5.0 |

$0.85 |

$3.40 |

$4.25 |

Baidu |

|

Claude Haiku 4.5 |

$1.00 |

$5.00 |

$6.00 |

Anthropic |

|

Qwen3-Max (2026-01-23) |

$1.20 |

$6.00 |

$7.20 |

Alibaba Cloud |

|

Gemini 3 Pro (≤200K) |

$2.00 |

$12.00 |

$14.00 |

|

|

GPT-5.2 |

$1.75 |

$14.00 |

$15.75 |

OpenAI |

|

Claude Sonnet 4.5 |

$3.00 |

$15.00 |

$18.00 |

Anthropic |

|

Gemini 3 Pro (>200K) |

$4.00 |

$18.00 |

$22.00 |

|

|

Claude Opus 4.6 |

$5.00 |

$25.00 |

$30.00 |

Anthropic |

|

GPT-5.2 Pro |

$21.00 |

$168.00 |

$189.00 |

OpenAI |

Значення для технічних лідерів та осіб, що приймають рішення

З випуском моделей Qwen3.5 Medium, швидка ітерація та тонке налаштування, які раніше були доступні лише добре фінансованим дослідницьким лабораторіям, тепер стають доступними для локальної розробки у багатьох нетехнічних компаніях. Це фактично відокремлює складний штучний інтелект від значних капітальних витрат.

В масштабах усієї організації ця архітектура трансформує підходи до обробки та безпеки даних. Можливість локально завантажувати величезні репозиторії документів або відео тривалістю в кілька годин дозволяє проводити глибокий інституційний аналіз без ризиків конфіденційності, пов’язаних із сторонніми API.

Використовуючи ці спеціалізовані моделі “Mixture-of-Experts” у межах власного корпоративного захисту, організації можуть зберігати суверенний контроль над своїми даними, одночасно використовуючи нативні “режими мислення” та можливості виклику офіційних інструментів для побудови надійніших, автономних агентів.

Ранні користувачі на Hugging Face особливо відзначають здатність моделі “скорочувати розрив” у агентських сценаріях, де раніше могли конкурувати лише найбільші закриті моделі.

Цей перехід від акценту на сирий масштаб до архітектурної ефективності гарантує, що інтеграція ШІ залишатиметься економною, безпечною та достатньо гнучкою, щоб відповідати мінливим операційним потребам.

Прогноз ІТ-Блогу: Нова архітектура Qwen3.5, що поєднує MoE та Delta Networks, вказує на майбутнє, де ефективність і масштабованість локальних моделей стануть пріоритетом. Це може призвести до зростання кількості приватних, високоспеціалізованих ШІ-рішень, які працюють на споживчому обладнанні, підриваючи домінування хмарних API.

За даними порталу: venturebeat.com