Незважаючи на політичну нестабільність у секторі ШІ США, в Китаї прогрес у галузі штучного інтелекту продовжується безперешкодно. Сьогодні команда Qwen Team з розробки ШІ від гіганта електронної комерції Alibaba, яка зосереджується насамперед на розробці та наданні світу зростаючої родини потужних та функціональних відкритих мовних та мультимодальних моделей ШІ Qwen, представила свою новітню серію – Qwen3.5 Small Model Series. Вона складається з:

-

Qwen3.5-0.8B & 2B: Дві моделі, оптимізовані для “крихітної” та “швидкої” роботи, призначені для прототипування та розгортання на периферійних пристроях, де час автономної роботи є надзвичайно важливим.

-

Qwen3.5-4B: Потужна мультимодальна основа для легких агентів, що нативно підтримує контекстне вікно довжиною 262 144 токени.

-

Qwen3.5-9B: Компактна модель для міркувань, яка перевершує значно більшого (у 13,5 разів) американського конкурента OpenAI, відкриту модель gpt-oss-120B, за ключовими сторонніми тестами, включаючи багатомовні знання та міркування на рівні вищої школи.

Щоб надати це в перспективу, ці моделі належать до найменших загального призначення, які наразі випускаються будь-якою лабораторією у світі, і більше порівнювані з серією LFM2 від MIT LiquidAI, яка також має кілька сотень мільйонів або мільярдів параметрів, ніж з оціночними трильйонами параметрів (налаштувань моделі), що, за повідомленнями, використовуються для флагманських моделей від OpenAI, Anthropic та серії Gemini від Google. Ваги моделей доступні глобально негайно під ліцензіями Apache 2.0 — ідеально підходять для корпоративного та комерційного використання, включаючи необхідну кастомізацію — на платформах Hugging Face та ModelScope.

Технологія: гібридна ефективність та нативна мультимодальність

Технічною основою серії Qwen3.5 small є відхід від стандартних архітектур Transformer. Alibaba перейшла до Ефективної Гібридної Архітектури, яка поєднує Gated Delta Networks (форма лінійної уваги) зі sparse Mixture-of-Experts (MoE). Цей гібридний підхід вирішує проблему “стіни пам’яті”, яка зазвичай обмежує малі моделі; завдяки використанню Gated Delta Networks моделі досягають вищої пропускної здатності та значно нижчої затримки під час виведення. Крім того, ці моделі є нативно мультимодальними. На відміну від попередніх поколінь, де візуальний енкодер “прикручувався” до текстової моделі, Qwen3.5 навчалася за допомогою раннього злиття на мультимодальних токенах. Це дозволяє моделям 4B і 9B демонструвати рівень візуального розуміння — наприклад, читання елементів інтерфейсу або підрахунок об’єктів на відео — що раніше вимагало моделей, у десять разів більших за їхній розмір.

Тестування серії “small”: продуктивність, що кидає виклик масштабу

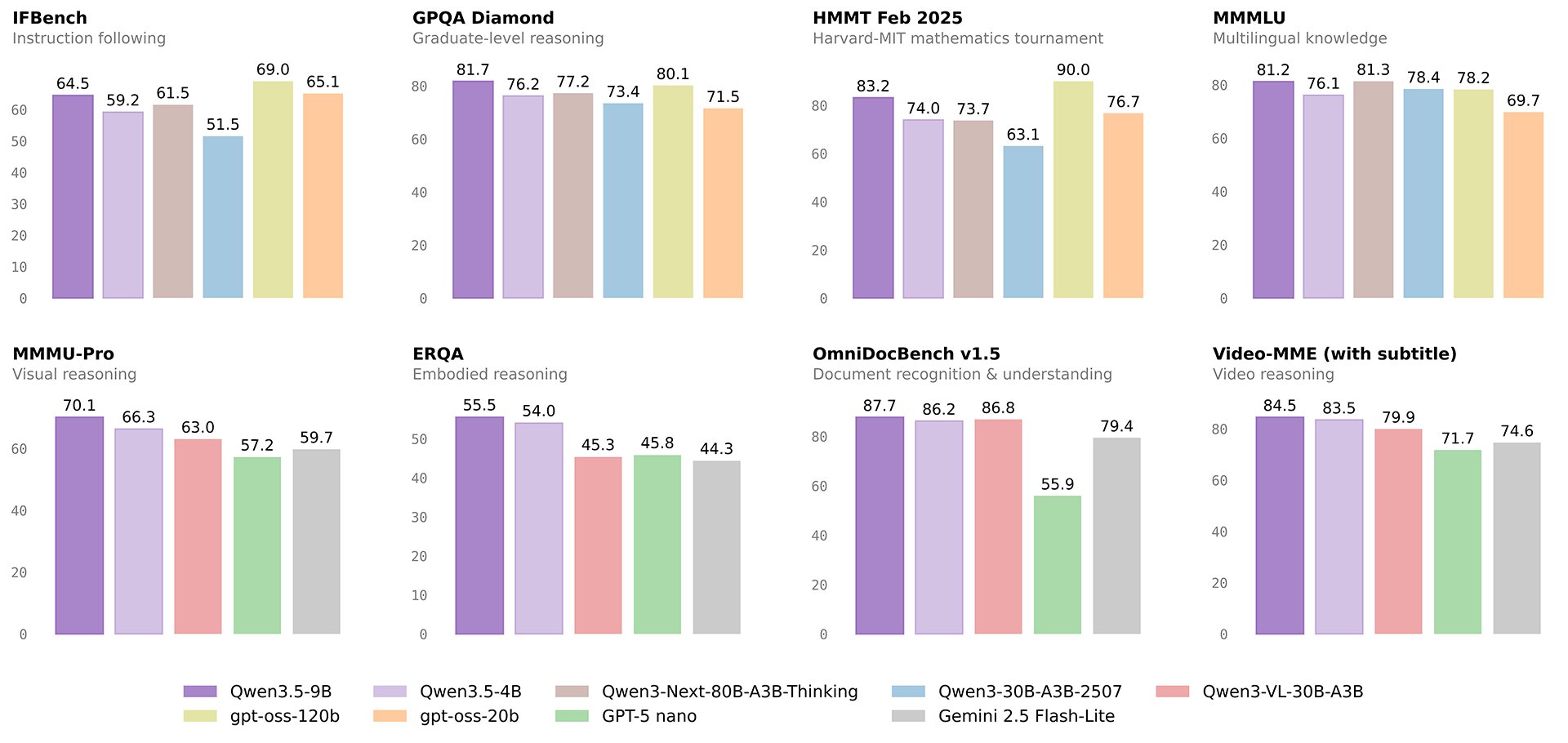

Нещодавно опубліковані дані бенчмарків ілюструють, наскільки агресивно ці компактні моделі конкурують з набагато більшими галузевими стандартами, часто перевершуючи їх. Варіанти Qwen3.5-9B і Qwen3.5-4B демонструють міжпоколіннєвий стрибок ефективності, особливо в мультимодальних завданнях та завданнях міркування.

-

Мультимодальна домінація: У тесті на візуальне міркування MMMU-Pro, Qwen3.5-9B досягла результату 70.1, випередивши Gemini 2.5 Flash-Lite (59.7) та навіть спеціалізований Qwen3-VL-30B-A3B (63.0).

-

Міркування на рівні вищої школи: У тесті GPQA Diamond 9B модель досягла результату 81.7, випередивши gpt-oss-120b (80.1), модель з більш ніж вдесятеро більшою кількістю параметрів.

-

Відеоаналіз: Серія демонструє елітну продуктивність у відеоаналізі. У тесті Video-MME (з субтитрами) Qwen3.5-9B показала результат 84.5, а 4B – 83.5, значно випередивши Gemini 2.5 Flash-Lite (74.6).

-

Математичні здібності: У оцінці HMMT Feb 2025 (математичний турнір Гарварду та Массачусетського Технологічного Інституту) 9B модель набрала 83.2 бала, тоді як 4B варіант – 74.0, доводячи, що високорівневі STEM-міркування більше не потребують масивних обчислювальних кластерів.

-

Документальні та багатомовні знання: 9B варіант лідирує в розпізнаванні документів на OmniDocBench v1.5 з результатом 87.7. Тим часом, він зберігає топ-рівень багатомовності на MMMLU з результатом 81.2, випереджаючи gpt-oss-120b (78.2).

Реакція спільноти: “більше інтелекту, менше обчислень”

Після випуску минулого тижня вже досить потужної відкритої моделі Qwen3.5-Medium, яка може працювати на одному GPU, анонс серії Qwen3.5 Small Models з ще меншим розміром та вимогами до обробки викликав негайний інтерес серед розробників, які зосереджуються на “локальному” ШІ. “Більше інтелекту, менше обчислень” знайшло відгук у користувачів, які шукають альтернативи хмарним моделям. AI-експерт та технічний педагог Пол Куверт з Blueshell AI зафіксував шок галузі щодо цього стрибка ефективності. “Як це взагалі можливо?!” – написав Куверт у X. “Qwen випустила 4 нові моделі, і 4B версія майже така ж потужна, як попередня 80B A3B. А 9B така ж хороша, як GPT OSS 120b, будучи в 13 разів меншою!” Аналіз Куверта підкреслює практичні наслідки цих архітектурних досягнень:

-

“Вони можуть працювати на будь-якому ноутбуці”

-

“0.8B і 2B для вашого телефону”

-

“Офлайн і з відкритим вихідним кодом”

Як зазначив розробник Каран Кендре з Kargul Studio: “ці моделі [можуть працювати] локально на моєму M1 MacBook Air безкоштовно”. Це відчуття “неймовірної” доступності повторюється в екосистемі розробників. Один користувач зазначив, що 4B модель, яка слугує “потужною мультимодальною основою”, є “зміною правил гри для мобільних розробників”, яким потрібні можливості читання екрана без високого навантаження на процесор. Насправді, розробник Hugging Face Ксенова зазначив, що нова серія Qwen3.5 Small Model може навіть працювати безпосередньо у веб-браузері користувача та виконувати такі складні й раніше вимогливі до обчислень операції, як аналіз відео. Дослідники також високо оцінили випуск базових моделей поряд з версіями “Instruct”, зазначивши, що це забезпечує важливу підтримку для “реальних промислових інновацій”. Випуск базових моделей особливо цінується корпоративними та дослідницькими командами, оскільки він надає “чистий аркуш”, який не був упереджений певним набором даних RLHF (Reinforcement Learning from Human Feedback) або SFT (Supervised Fine-Tuning), що часто може призводити до “відмов” або специфічних стилів розмови, які важко змінити. Тепер, маючи базові моделі, ті, хто зацікавлений у кастомізації моделі для специфічних завдань та цілей, мають легший старт, оскільки вони можуть застосовувати власне донавчання за інструкціями та подальше навчання, не видаляючи напрацювання Alibaba.

Ліцензування: перемога для відкритої екосистеми

Alibaba випустила ваги та конфігураційні файли серії Qwen3.5 під ліцензією Apache 2.0. Ця дозвільна ліцензія дозволяє комерційне використання, модифікацію та розповсюдження без виплат роялті, усуваючи “залежність від постачальника”, пов’язану з пропрієтарними API.

-

Комерційне використання: Розробники можуть безкоштовно інтегрувати моделі у комерційні продукти.

-

Модифікація: Команди можуть донавчати (SFT) або застосовувати RLHF для створення спеціалізованих версій.

-

Розповсюдження: Моделі можуть бути повторно розповсюджені в локальних AI-додатках, таких як Ollama.

Контекстуалізація новин: чому “мале” так багато означає зараз

Випуск серії Qwen3.5 Small Series збігається з моментом “агентурного переформатування”. Ми вийшли за межі простих чат-ботів; тепер мета – автономія. Автономний агент повинен “думати” (міркувати), “бачити” (мультимодальність) та “діяти” (використовувати інструменти). Хоча виконання цього за допомогою трильйонних моделей є надмірно дорогим, локальна Qwen3.5-9B може виконувати ці цикли за значно нижчою ціною. Масштабуючи навчання з підкріпленням (RL) у середовищах з мільйонами агентів, Alibaba наділила ці малі моделі “людсько-узгодженим судженням”, що дозволяє їм виконувати багатоетапні завдання, такі як організація робочого столу або перетворення ігрового відео на код. Незалежно від того, чи це 0.8B модель, що працює на смартфоні, чи 9B модель, що забезпечує роботу кодувального терміналу, серія Qwen3.5 ефективно демократизує “агентурну еру”. Перехід серії Qwen3.5 від “чат-ботів” до “нативних мультимодальних агентів” трансформує спосіб розподілу інтелекту підприємствами. Переносячи складні міркування на “периферію” — індивідуальні пристрої та локальні сервери — організації можуть автоматизувати завдання, які раніше вимагали дорогих хмарних API або обробки з високою затримкою.

Стратегічні корпоративні застосування та міркування

Моделі від 0.8B до 9B перероблені для ефективності, використовуючи гібридну архітектуру, яка активує лише необхідні частини мережі для кожного завдання.

-

Автоматизація візуальних робочих процесів: Використовуючи “заземлення на рівні пікселів”, ці моделі можуть навігувати інтерфейсами робочого столу або мобільних пристроїв, заповнювати форми та організовувати файли на основі інструкцій природною мовою.

-

Складний парсинг документів: З результатами понад 90% на тестах розуміння документів, вони можуть замінити окремі конвеєри OCR та розкладки для вилучення структурованих даних з різноманітних форм та діаграм.

-

Автономне кодування та рефакторинг: Підприємства можуть завантажувати цілі репозиторії (до 400 000 рядків коду) у контекстне вікно розміром 1 мільйон для рефакторингу, готового до продакшену, або автоматичного налагодження.

-

Аналіз на периферії в реальному часі: Моделі 0.8B і 2B розроблені для мобільних пристроїв, забезпечуючи офлайн-резюмування відео (до 60 секунд при 8 FPS) та просторові міркування без значного споживання заряду батареї.

Наведена нижче таблиця показує, які корпоративні функції отримають найбільшу вигоду від локального розгортання малих моделей.

|

Функція |

Основна перевага |

Ключовий сценарій використання |

|

Розробка програмного забезпечення |

Локальний інтелект коду |

Рефакторинг репозиторію та агентне кодування в терміналі. |

|

Операції та ІТ |

Безпечна автоматизація |

Автоматизація локальних багатоетапних налаштувань системи та завдань управління файлами. |

|

Продукти та UX |

Периферійне взаємодія |

Інтеграція нативного мультимодального міркування безпосередньо в мобільні/настільні додатки. |

|

Дані та аналітика |

Ефективне вилучення |

Високоякісне OCR та вилучення структурованих даних зі складних візуальних звітів. |

Хоча ці моделі є високофункціональними, їхній малий масштаб та “агентурний” характер вводять специфічні операційні “прапорці”, за якими команди повинні стежити.

-

Каскад галюцинацій: У багатоетапних “агентурних” робочих процесах невелика помилка на ранньому етапі може призвести до “каскаду” збоїв, коли агент переслідує неправильний або безглуздий план.

-

Налагодження проти розробки з нуля: Хоча ці моделі чудово пишуть новий код “з нуля”, вони можуть мати труднощі з налагодженням або модифікацією існуючих, складних застарілих систем.

-

Вимоги до пам’яті та VRAM: Навіть “малі” моделі (як 9B) потребують значного обсягу VRAM для високопродуктивного виведення; “об’єм пам’яті” залишається високим, оскільки загальна кількість параметрів все ще займає простір GPU.

-

Регулювання та місцезнаходження даних: Використання моделей від постачальника з Китаю може викликати питання щодо місцезнаходження даних у певних юрисдикціях, хоча версія з відкритими вагами Apache 2.0 дозволяє розміщення на “суверенних” локальних хмарах.

Підприємства повинні надавати пріоритет “перевіряємим” завданням — таким як кодування, математика або слідування інструкціям — де вихідні дані можуть бути автоматично перевірені за попередньо визначеними правилами, щоб запобігти “зловживанню винагородою” або тихим збоям.

Прогноз ІТ-Блогу: Серія Qwen3.5 Small Models є значним кроком у демократизації передових можливостей ШІ, роблячи їх доступними для локального розгортання на споживчому обладнанні. Очікується, що це стимулюватиме розвиток нових класів периферійних AI-застосунків і вимагатиме подальших інновацій у галузі оптимізації моделей та ефективності апаратного забезпечення для задоволення зростаючого попиту.

Джерело новини: venturebeat.com