Плани NVIDIA щодо LPU від Groq зміцнять позиції компанії у робочих навантаженнях, чутливих до затримок

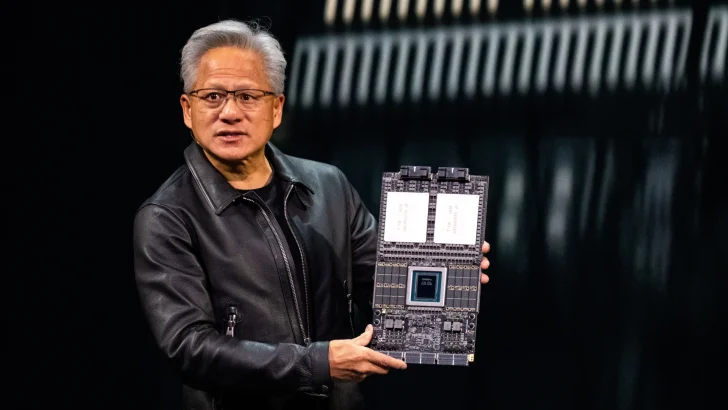

NVIDIA демонструє агресивну політику у сфері поглинань цього року. Однак, серед значних партнерств, укладених компанією, виділяється угода з Groq — неліцензійна угода на суму до 20 мільярдів доларів, що є найбільшою інвестицією “Команди Зелених”. Анонс відбувся напередодні Різдва, але NVIDIA так і не оприлюднила детальні плани. Цікаво, що генерального директора NVIDIA запитали про плани компанії щодо Groq під час звіту про прибутки за четвертий квартал 2026 року. Він надав контекстну заяву, яка може натякати на роль LPU (Language Processing Units) у майбутніх пропозиціях NVIDIA у сфері ШІ.

Щодо того, як ми розглядаємо Groq та декодери з низькою затримкою, у мене є чудові ідеї, якими я хотів би поділитися з вами на GTC.

І тому, що ми зробимо з Groq, ви побачите на GTC, але ми розширимо нашу архітектуру за допомогою Groq як прискорювача, так само, як ми розширили архітектуру NVIDIA за допомогою Mellanox.

– Генеральний директор NVIDIA Дженсен Хуанг

Ідея придбання Groq полягає в простому прагненні NVIDIA. Компанія хоче охопити робочі навантаження, чутливі до затримок. Сьогодні етап висновку (inference) став домінуючим. Додатки, прив’язані до агентних середовищ, вимагають надшвидких відповідей, тому затримка почала ставати основним вузьким місцем для обчислювальних провайдерів. NVIDIA домінує у навчанні з Hopper і Blackwell, але з Vera Rubin висновок є сферою, де компанія ще не зміцнила свою перевагу. LPU від Groq відіграватимуть вирішальну роль у встановленні нових стандартів. Генеральний директор NVIDIA порівняв роль Groq із придбанням Mellanox. Для тих, хто не знає, Mellanox вирішив проблему “мережевої взаємодії”. Mellanox заклав основу для InfiniBand, що згодом призвело до того, що NVIDIA називає “екстремальним співпроектуванням” (extreme co-design). Тому було б неправильно не визнати, що це придбання надало NVIDIA поштовх у стратегії дата-центрів. Groq відіграватиме подібну роль, і, як зазначає Дженсен, “Команда Зелених” “розширить свою архітектуру” за допомогою Groq, що передбачає певну форму інтеграції LPU на рівні стійок (rack-scale integration).

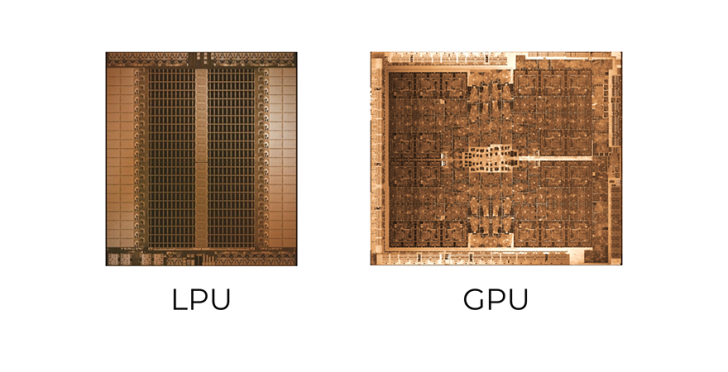

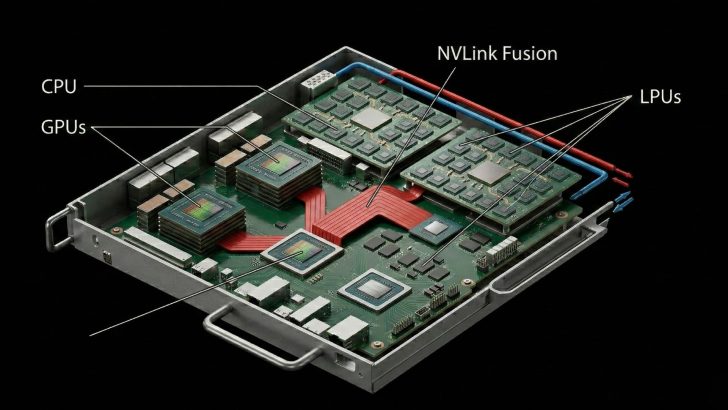

Декодування (decode) і попереднє заповнення (prefill) є ключовими етапами висновку. У випадку агентного ШІ, декодування набуває значно більшого значення. Зважаючи на це, у багатоагентних робочих навантаженнях декодування дозволяє агентам виконувати складні кроки міркування за лічені “секунди”, що є необхідним, оскільки світ рухається до рою ШІ-агентів, які залежать один від одного. З Rubin CPX NVIDIA фактично охопила етапи попереднього заповнення завдяки своїм механізмам прискорення уваги (attention-acceleration engines) та потужним обчислювальним ресурсам NVFP4. Для декодування NVIDIA буде використовувати Groq, як зазначив Дженсен. LPU використовують SRAM на самому чипі (on-die SRAM) для забезпечення десятків терабайтів на секунду внутрішньої пропускної здатності. Ми вже бачили широке застосування SRAM компаніями, такими як Cerebras (з WSE-3) та Microsoft (з Maia 300). Щодо того, де саме LPU можуть бути інтегровані, існують дві основні теорії. Перша полягає в тому, що NVIDIA може розробити гібридні обчислювальні вузли в рамках пропозицій на рівні стійок, з кількома LPU, з’єднаними за допомогою уніфікованого інтерконекту.

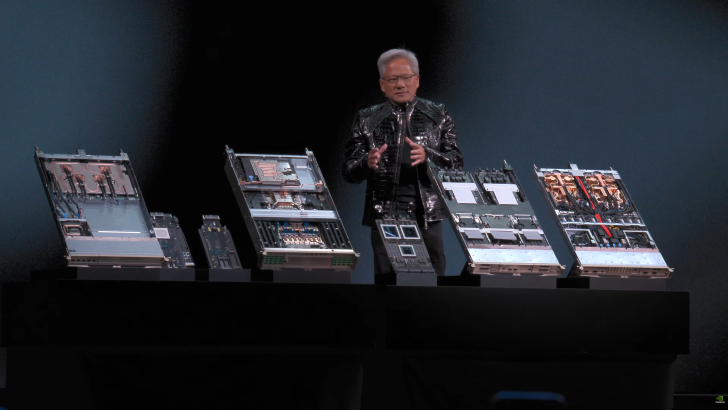

GF Securities вважає (через Jukan), що NVIDIA може представити “LPX rack” на цьогорічній GTC, що міститиме 256 одиниць LPU в одному пристрої. Базуючись на цій інформації, ми вважаємо, що для з’єднання LPU-LPU NVIDIA буде використовувати власний протокол chip-to-chip “plesiosynchronous”. Для з’єднання LPU-GPU ми можемо побачити інтеграцію NVLink Fusion для обробки величезного KV-кешу (KV cache) з GPU під час фази попереднього заповнення. Іншим досліджуваним варіантом є розміщення LPU як вбудованих блоків (on-die units) у GPU Feynman за допомогою гібридного зв’язку (hybrid bonding), але наразі варіант на рівні стійок виглядає значно більш ймовірною можливістю.

Ідея полягає в тому, що LPU від Groq відіграватимуть роль, подібну до Mellanox у мережевій взаємодії, і ця гібридна архітектура надасть NVIDIA перевагу в робочих навантаженнях, чутливих до затримок. На звітному дзвінку Дженсен вже повідомив, що обчислення та дохід тепер зростають 1:1, що зумовлено більш агресивним розвитком “рівня додатків” (application layer) ШІ. Ми очікуємо, що NVIDIA офіційно представить свої плани щодо LPU на цьогорічній GTC.

Головний підсумок від ІТ-Блогу: NVIDIA планує інтегрувати LPU від Groq для подолання вузьких місць у робочих навантаженнях, чутливих до затримок, особливо на етапі висновку (inference). Цей стратегічний крок, подібний до придбання Mellanox, має на меті зміцнити домінування компанії в екосистемі ШІ, пропонуючи гібридні рішення, що забезпечують наднизькі затримки.

За матеріалами: wccftech.com