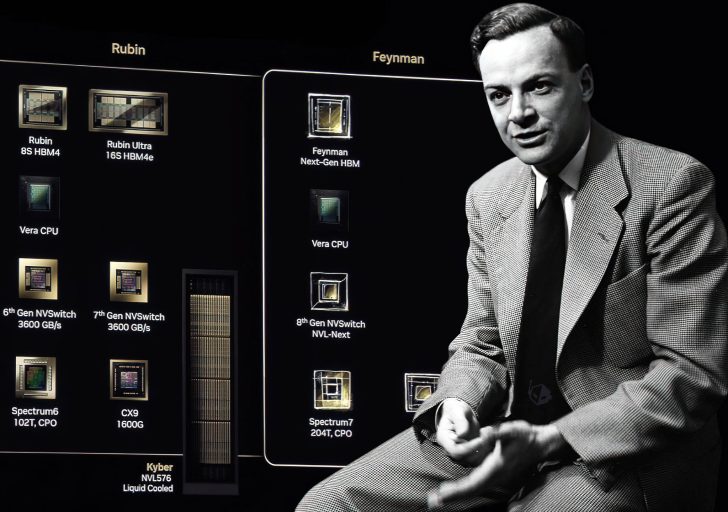

NVIDIA прагне домінувати у сфері інференсу з новими чипами Feynman, інтегруючи LPUs

Компанія NVIDIA планує забезпечити собі лідерство в галузі інференсу (висновування) завдяки наступному поколінню чипів Feynman. Існує висока ймовірність, що архітектура цих GPU включатиме блоки LPU (Language Processing Unit).

NVIDIA може використати гібридне з’єднання з SRAM-чіпами для інференсу, але це має низку наслідків

Ліцензування технології LPU від Groq компанією NVIDIA може здатися незначною угодою, враховуючи обсяги придбання та фінансові показники. Однак, насправді, NVIDIA націлена на здобуття першості в сегменті інференсу за допомогою LPUs, про що ми вже детально висвітлювали. Щодо того, як саме NVIDIA планує інтегрувати LPUs, з’явилося кілька припущень. Аналіз експерта з GPU, відомого як AGF, свідчить, що блоки LPU можуть бути інтегровані в GPU наступного покоління Feynman за допомогою технології гібридного з’єднання від TSMC.

Groq LPU blocks will first appears in 2028 in Feynman (the post Rubin generation).

Deterministic, compiler-driven dataflow with static low-latency scheduling and Higher Model Floats Utilization (MFU) in low-batch scenarios will give Feynman immense inference performance boost in… https://t.co/GVZCWiENC2— AGF (@XpeaGPU) December 28, 2025

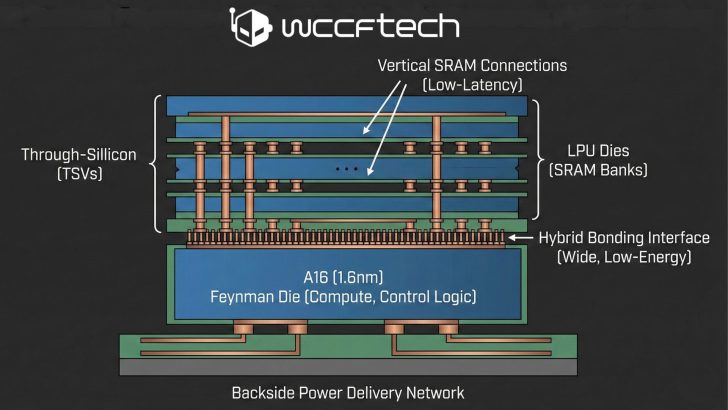

Експерт вважає, що реалізація може нагадувати підхід AMD з процесорами X3D, де технологія гібридного з’єднання SoIC від TSMC використовується для інтеграції 3D V-Cache плиток на основний обчислювальний кристал. AGF стверджує, що створення SRAM як монолітного кристала може бути неоптимальним рішенням для GPU Feynman. Це пов’язано з обмеженнями масштабування SRAM, а її виготовлення на передових техпроцесах призведе до марнування висококласного кремнію та значного зростання витрат на площу пластини. Натомість, AGF припускає, що NVIDIA розмістить блоки LPU поверх обчислювального кристала Feynman.

Такий підхід виглядає логічним, враховуючи, що в цьому випадку чипи, як-от A16 (1.6 нм), будуть використовуватися для основного кристала Feynman, який містить обчислювальні блоки (тензорні ядра, логіку керування тощо), тоді як окремі LPU-кристали міститимуть великі SRAM-масиви. Крім того, для з’єднання цих кристалів ключову роль відіграватиме технологія гібридного з’єднання TSMC, яка забезпечить широкий інтерфейс та нижче енергоспоживання на біт порівняно з пам’яттю поза корпусом. На додаток, оскільки A16 має заднє живлення, передня сторона буде вільною для вертикальних SRAM-з’єднань, що гарантуватиме декодування з низькою затримкою.

Проте, використання цієї техніки викликає занепокоєння щодо того, як NVIDIA впорається з тепловими обмеженнями. Складання кристалів на техпроцесі з високою щільністю обчислень саме по собі є складним завданням. А з LPUs, які зосереджені на сталому навантаженні, це може створити вузькі місця. Важливішими є наслідки на рівні виконання, які значно зростуть з таким підходом, оскільки LPUs зосереджені на фіксованому порядку виконання, що, звісно, створює конфлікт між детермінізмом та гнучкістю.

Навіть якщо NVIDIA вдасться подолати апаратні обмеження, головне занепокоєння викликає взаємодія CUDA з виконанням LPU-стилю. CUDA вимагає явного розміщення пам’яті, тоді як CUDA-ядра розроблені для абстракції обладнання. Інтеграція SRAM в AI-архітектури не буде легким завданням для NVIDIA, оскільки це вимагатиме інженерного дива для забезпечення оптимальної роботи середовищ LPU-GPU. Однак, це може бути ціною, яку NVIDIA готова заплатити, якщо прагне лідирувати в сегменті інференсу.

Порада від ІТ-Блог:

Ця новина надзвичайно важлива для всіх, хто слідкує за розвитком штучного інтелекту та комп’ютерного обладнання. Інтеграція LPUs в наступне покоління GPU від NVIDIA може суттєво прискорити процеси інференсу, що безпосередньо вплине на продуктивність AI-застосунків, від генеративних моделей до аналізу даних. Це може означати швидшу роботу програм, більш точні результати та потенційно нові можливості у сфері штучного інтелекту, які ми ще навіть не уявляємо.

Джерело новини: wccftech.com