OpenAI досягла вражаючої продуктивності 1000 TPS завдяки надшвидкій пропускній здатності Cerebras

Попри попередні труднощі у відносинах між NVIDIA та OpenAI у фінансовій сфері, схоже, що в гонці за обчислювальними потужностями OpenAI обрала цікавий шлях через свою попередню співпрацю з Cerebras. У нещодавньому релізі моделі Codex було розкрито, що GPT‑5.3‑Codex‑Spark працює на базі ШІ-чипів Cerebras. Зокрема, перевагою використання цього апаратного забезпечення над іншими є “низька затримка” (low latency) під час інференс-навантажень, що буде розглянуто далі. Більш цікавим аспектом вибору обчислювальних ресурсів є те, що OpenAI, опосередковано, заявила про появу “грізного” конкурента NVIDIA у сфері інференсу.

Відмінність між основними моделями Codex та варіантом ‘Spark’ полягає в тому, що OpenAI стверджує, що він розроблений для “виконання завдань у реальному часі”. З GPT‑5.3‑Codex‑Spark було досягнуто значних покращень у затримці моделі шляхом оптимізації конвеєрів і, що найважливіше, завдяки використанню апаратного забезпечення Cerebras. OpenAI стверджує, що з цим релізом час до отримання першого токена було скорочено на 50%, що є надзвичайно цікавою цифрою.

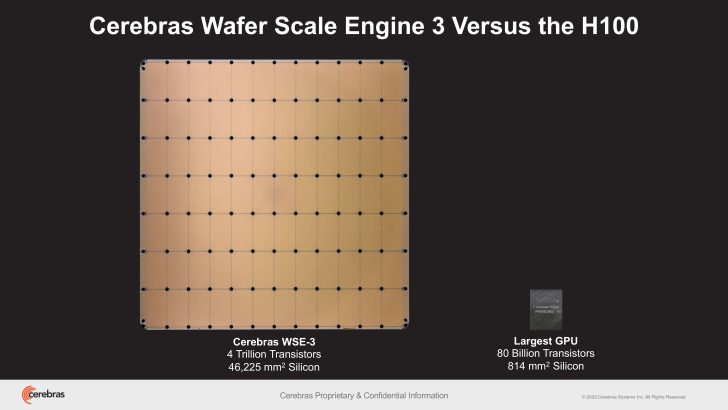

Codex-Spark працює на базі Wafer Scale Engine 3 (WSE-3) від Cerebras. Нижче наведено технічні характеристики:

| Специфікація | WSE-3 |

|---|---|

| Технологічний процес | TSMC 5 нм |

| Транзистори | ~4 трильйони |

| Обчислювальні ядра | 900 000 ШІ-оптимізованих ядер |

| On-Chip SRAM | 44 ГБ |

| Пропускна здатність пам’яті (On-Chip) | 21 ПБ/с |

| Розмір пластини | Повнорозмірна пластина 300 мм |

| Архітектура ядер | ШІ-оптимізовані програмовані процесорні ядра |

Причини вибору Cerebras та їхній вплив на продуктивність

Існує кілька причин, чому OpenAI обрала Cerebras для обчислень. Одна з найважливіших – це надзвичайно висока пропускна здатність пам’яті, яку надає WSE-3, що критично важливо для обчислювально-інтенсивних завдань, таких як кодування. Саме тому з Codex-Spark OpenAI досягає 1000 TPS, що, за заявами компанії, забезпечує відгук, порівнянний з “людським напарником-програмістом”. Використання інфраструктури NVIDIA для навчання Spark було б економічно недоцільним для OpenAI, враховуючи, що Blackwell зосереджений більше на пакетній обробці, ніж на затримці, тому Cerebras є логічним вибором.

Конкуренція на ринку інференсу та майбутнє NVIDIA

Однак, коли мова йде про інференс у великих масштабах, NVIDIA домінує за показниками “токеноміки” (tokenomics). Ми бачили це у нещодавній заяві компанії про те, як вона знизила витрати на токени до 10 разів за допомогою Blackwell. Сачін Катті з OpenAI зазначає, що завдяки Cerebras компанія отримує “додаткові можливості”, але лояльність ШІ-лабораторії в гонці за обчислювальними потужностями все ще на боці NVIDIA. Проте, з Codex-Spark чітко видно, що сьогодні вузьким місцем є затримка, і на апаратному рівні технологічний стек NVIDIA не ідеально підходить для домінування в цій галузі.

Буде цікаво спостерігати за тим, як надалі позиціонуватиме себе NVIDIA на ринку інференсу, враховуючи, що Cerebras є лише одним із грізних конкурентів у цьому сегменті, поряд з новими рішеннями від виробників ASIC та таких компаній, як AMD.

Головний підсумок від ІТ-Блогу: Інтеграція ШІ-чіпів Cerebras компанією OpenAI для моделі Codex-Spark демонструє потенційну слабкість NVIDIA у сфері інференсу з низькою затримкою. Хоча NVIDIA домінує у пакетній обробці, Cerebras пропонує значні переваги в швидкості реагування, що може переорієнтувати конкурентну динаміку на ринку ШІ.

Дізнатися більше на: wccftech.com