Одним із найскладніших завдань у роботі з моделями глибокого навчання (deep learning models) є розуміння механізмів, що стоять за їхніми рішеннями. Незалежно від того, чи це невдалі спроби xAI тонко налаштувати Grok, його специфічну політичну позицію, схильність ChatGPT до підлабузництва, чи звичайні «галюцинації» (випадкові помилки), розібратися в принципах роботи нейромережі з мільярдами параметрів – це нелегка справа.

Новий підхід до прозорості нейромереж

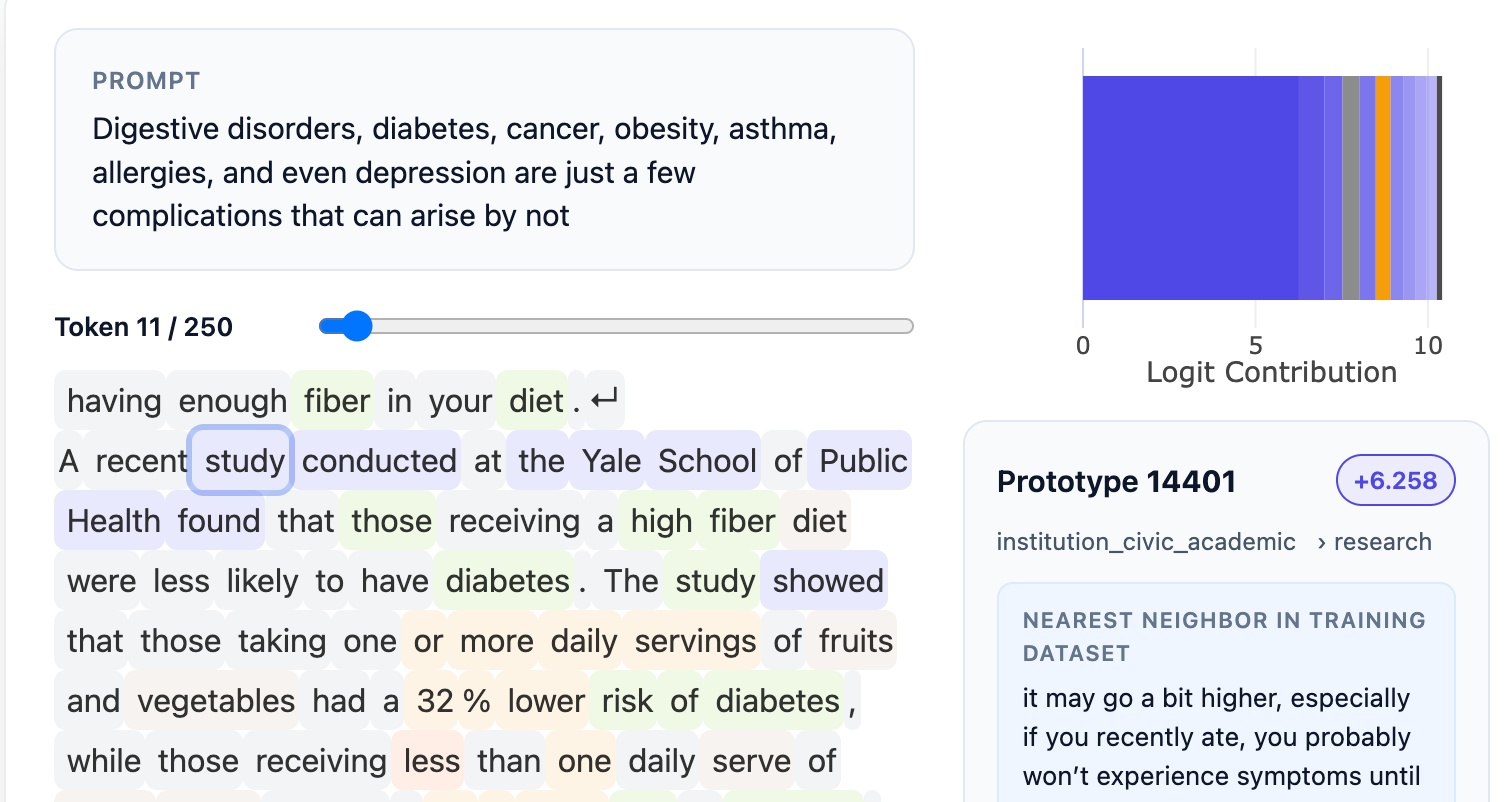

Компанія Guide Labs, стартап із Сан-Франциско, заснований CEO Джуліусом Адебайо та головною науковою співробітницею Аєю Абдельсалам Ісмаїл, пропонує рішення цієї проблеми. У понеділок компанія представила відкриту (open-sourced) модель мови (LLM) Steerling-8B з 8 мільярдами параметрів. Її розроблено на новій архітектурі, що забезпечує легку інтерпретацію дій моделі: кожен згенерований токен (одиниця тексту) можна відстежити до його джерела в тренувальних даних LLM.

Відстеження джерел знань

Це може стосуватися як визначення референсних матеріалів для фактів, які цитує модель, так і більш складних аспектів, як-от розуміння моделлю гумору чи гендерних стереотипів. “Якщо я маю трильйон способів закодувати гендер, і я кодую його в мільярді з цих трильйонів, ви маєте знайти всі ці мільярд способів, а потім мати змогу надійно вмикати та вимикати їх”, – пояснив Адебайо в інтерв’ю TechCrunch. “З поточними моделями це можливо, але дуже крихко… Це одне з питань Святого Грааля”.

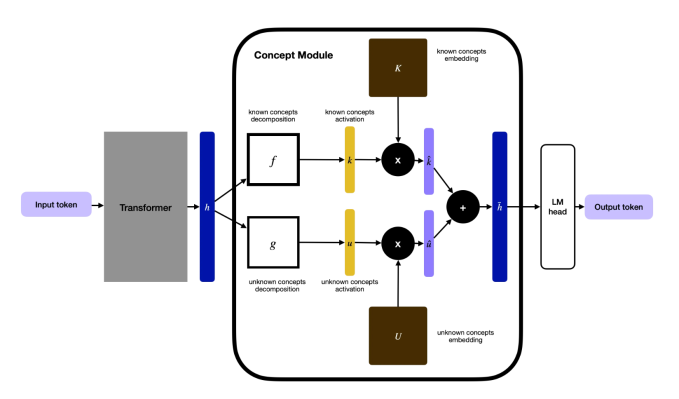

Адебайо розпочав свою роботу, навчаючись в аспірантурі MIT, де став співавтором відомої статті 2018 року, яка показала ненадійність існуючих методів аналізу моделей глибокого навчання. Це дослідження зрештою призвело до створення нового способу побудови LLM: розробники інтегрують у модель шар концепцій (concept layer), який групує дані за відстежуваними категоріями. Хоча це вимагає додаткової анотації даних на початковому етапі, завдяки використанню інших ШІ-моделей для допомоги, їм вдалося навчити цю модель як найбільший на сьогодні доказ концепції (proof of concept).

“Інтерпретованість, яку зазвичай застосовують, – це, фактично, нейронаука для моделі, а ми перевертаємо цей підхід”, – зазначив Адебайо. “Ми проєктуємо модель з нуля таким чином, щоб не потребувати нейронауки”.

Переваги інтерпретованої архітектури

Одним із потенційних ризиків такого підходу є можливе усунення деяких емерджентних (непередбачуваних) властивостей LLM, які роблять їх такими інтригуючими: їхня здатність узагальнювати інформацію та застосовувати її до нових, раніше не вивчених завдань. Однак Адебайо стверджує, що ці властивості зберігаються і в моделі його компанії. Його команда відстежує так звані “відкриті концепції” (discovered concepts), які модель виявила самостійно, наприклад, у галузі квантових обчислень.

Адебайо переконаний, що така інтерпретована архітектура стане необхідною для всіх. У споживчих LLM (consumer-facing LLMs) ці методи дозволять розробникам блокувати використання матеріалів, захищених авторським правом, або краще контролювати результати щодо таких тем, як насильство чи наркотики. Регульовані галузі (regulated industries), як-от фінанси, вимагатимуть більш контрольованих LLM. Наприклад, модель, що оцінює заявки на кредит, повинна враховувати фінансові показники, але не расу. Потреба в інтерпретованості також існує в наукових дослідженнях, де Guide Labs вже розробила відповідні технології. Складання білків (protein folding) стало значним досягненням для моделей глибокого навчання, але вченим потрібне глибше розуміння того, чому програмне забезпечення знайшло перспективні комбінації.

“Ця модель демонструє, що тренування інтерпретованих моделей – це вже не якась наука, а інженерна проблема”, – заявив Адебайо. “Ми розкрили наукову складову і можемо масштабувати її. Немає жодних причин, чому така модель не могла б відповідати продуктивності передових моделей (frontier level models), які мають значно більше параметрів”.

Майбутні плани та демократизація ШІ

За даними Guide Labs, Steerling-8B досягає 90% можливостей існуючих моделей, але використовує менше тренувальних даних завдяки своїй інноваційній архітектурі. Наступним кроком компанії, яка пройшла акселератор Y Combinator та залучила $9 мільйонів інвестицій від Initialized Capital у листопаді 2024 року, є створення більшої моделі та початок надання API та агентських інтерфейсів (agentic access) для користувачів.

“Спосіб, яким ми зараз тренуємо моделі, є надзвичайно примітивним. Тому демократизація вбудованої інтерпретованості стане довгостроковим благом для нашої ролі в людстві”, – додав Адебайо. “Коли ми прагнемо створити надінтелектуальні моделі, ви не хочете, щоб щось приймало рішення за вас, залишаючись для вас незрозумілим”.

Думка ІТ-Блогу: Запуск Steerling-8B знаменує собою важливий крок до більш прозорого та контрольованого штучного інтелекту, що може суттєво знизити ризики, пов’язані з його непередбачуваною поведінкою, і відкрити нові можливості для його застосування в критично важливих галузях.

Подробиці можна знайти на сайті: techcrunch.com