QNAP представила свій новий AI NAS, який оснащений 16-ядерним процесором AMD EPYC “Zen 2” та може бути укомплектований відеокартою RTX PRO 6000 Blackwell.

Старе зустрічається з новим у QNAP “QAI-h1290FX” AI NAS: 16 ядер Zen 2 та 96 ГБ RTX PRO 6000 GPU

“QAI-h1290FX” – це новітня розробка QNAP для Edge AI, яка поєднує два окремі апаратні компоненти. Але перш ніж перейти до деталей, варто зазначити, що новий AI NAS від QNAP розроблений для LLM, RAG та різноманітних GenAI-додатків.

Сервер живлять два компоненти. Перший – це процесор AMD EPYC 7302P, який має 16 ядер та 32 потоки. Цей чіп базується на архітектурі ядра Zen 2 та забезпечує достатню продуктивність для виконання завдань AI inference на межі мережі (edge).

Другий компонент – це GPU, на вибір QNAP пропонує два варіанти: або RTX PRO 4500 Blackwell з 32 ГБ, або флагманську NVIDIA RTX PRO 6000 Blackwell з 96 ГБ. Обидві карти пропонують надзвичайні обчислювальні можливості для ШІ. PRO 4500 призначена для LLM розміром до ~30 млрд параметрів, тоді як PRO 6000 ідеально підходить для AI LLM від 70 млрд параметрів і більше.

Окрім CPU/GPU, QNAP QAI-h1290FX підтримує 12 SSD U.2 NVMe/SATA, а також високошвидкісну мережу завдяки двом портам 25GbE та двом портам 2.5GbE. Слоти PCIe також можуть бути використані для додаткових мережевих карт 100GbE (продаються окремо). NAS також сумісний з розширювальними модулями QNAP JBOD для зберігання великих обсягів даних для ШІ.

Основні характеристики NAS включають:

- Повністю флеш-архітектура зберігання: Дванадцять слотів для SSD U.2 NVMe/SATA забезпечують ультрашвидкий ввід/вивід для високочастотного виконання AI-моделей та потокової передачі даних.

- 16-ядерний процесор AMD EPYC 7302P: Надає 32 потоки обчислювальної потужності серверного класу – ідеально підходить для AI inference, віртуалізації та важких паралельних навантажень.

- GPU-готовий архітектура: Підтримує опціональну робочу відеокарту NVIDIA RTX PRO 6000 Blackwell Max-Q з пам’яттю до 96 ГБ та підтримкою прискорення CUDA, Tensor та Transformer Engine – значно підвищуючи продуктивність для локального LLM inference, генерації зображень та завдань глибокого навчання.

- Контейнеризоване AI-середовище та керування ресурсами GPU: Підтримує Docker та LXD з інтуїтивним розподілом GPU. Користувачі можуть швидко запускати AI-інструменти через вбудований центр AI-додатків та призначати ресурси GPU без конфігурації командного рядка.

- Повністю локальне розгортання без залежності від хмари: Запускайте AI-чат-асистенти, пошукові системи документів або бази знань повністю на власних серверах. Зберігайте конфіденційні дані всередині компанії, прискорюючи AI-робочі процеси.

- Високошвидкісна мережа та масштабована архітектура: Оснащений двома портами 25GbE та двома портами 2.5GbE. Слоти PCIe підтримують опціональні оновлення до 100GbE. Сумісний з розширювальними модулями QNAP JBOD для зберігання великих обсягів даних для ШІ.

QNAP також надає реальні показники продуктивності свого нового AI NAS з відеокартою NVIDIA RTX PRO 6000 96 GB Blackwell. Тести включають різні моделі різного розміру, демонструючи продуктивність до 172 токенів/секунду. Результати можна побачити нижче:

| Модель | Токен/сек | Використання VRAM |

|---|---|---|

| gpt-oss:120b (MXFP4) | 90 Token/sec | ~63GB |

| deepseek-r1:70b (q4_K_M) | 24 Token/sec | ~41GB |

| qwen3:32b (q4_K_M) | 46 Token/sec | ~21GB |

| gemma3:27b (q4_K_M) | 54 Token/sec | ~19GB |

| deepseek-r1:8b (q4_K_M) | 140 Token/sec | ~7GB |

| qwen3:8b (q4_K_M) | 172 Token/sec | ~7GB |

Окрім LLM, що запускаються нативно через Ollama, QNAP ділиться результатами тестів паралельного виведення vLLM для тієї ж конфігурації, які представлені нижче:

Тестована велика мовна модель: deepseek-ai/DeepSeek-R1-Distill-Qwen-7B (Hugging Face)

| Потік | Загальний Токен/сек | Середній Токен/Потік/Сек |

|---|---|---|

| 1 | 79 Token/sec | 79 Token/sec |

| 2 | 166 Token/sec | 83 Token/sec |

| 5 | 410 Token/sec | 82 Token/sec |

| 10 | 688 Token/sec | 68.8 Token/sec |

| 20 | 810 Token/sec | 40.5 Token/sec |

| 50 | 850 Token/sec | 17 Token/sec |

Тестована велика мовна модель: openai/gpt-oss-20b (Hugging Face)

| Потік | Загальний Токен/сек | Середній Токен/Потік/Сек |

|---|---|---|

| 1 | 218 Token/sec | 218 Token/sec |

| 2 | 340 Token/sec | 170 Token/sec |

| 5 | 1045 Token/sec | 209 Token/sec |

| 10 | 880 Token/sec | 88 Token/sec |

| 20 | 600 Token/sec | 30 Token/sec |

QNAP пропонує широкий асортимент карт розширення зберігання даних, мережі та інтерфейсів, які можна придбати окремо для розширення можливостей AI-сервера. Оперативна пам’ять також продається окремо, з варіантами від 8 ГБ модулів DDR4-3200 до комплектів 64 ГБ DDR4-3200. Система має 5-річну гарантію, а ціна становить 8999 доларів за версію з 64 ГБ, 13 499 доларів за 128 ГБ та 15 999 доларів за версію з 256 ГБ.

Про автора: Хассан Муджтаба, інженер-програміст за освітою та ентузіаст ПК за покликанням, є старшим редактором розділу апаратного забезпечення Wccftech. Маючи багаторічний досвід роботи в галузі, він спеціалізується на глибокому технічному аналізі процесорів та GPU наступного покоління, материнських плат та систем охолодження. Його робота включає не лише оперативні новини про майбутні технології, але й обширні практичні огляди та тестування.

Слідкуйте за Wccftech у Google, щоб отримувати більше новин у своїх стрічках.

Подальше читання

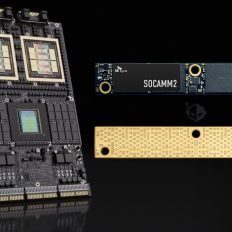

SK Hynix розпочинає масове виробництво 192 ГБ пам’яті SOCAMM2 з подвоєною пропускною здатністю, що є важливим елементом для NVIDIA Vera Rubin

Хассан Муджтаба

Перетворіть свій вільний M.2 слот на процесор для 20B LLM за допомогою цього спеціалізованого AI-модуля: 32 ГБ пам’яті та 60 TOPs

Хассан Муджтаба

Big Battlemage тут – Intel представляє GPU Arc Pro B70 та B65, до 32 ГБ пам’яті та 367 TOPS для ШІ

Хассан Муджтаба

GMKtec EVO-T2 Mini PC працює на процесорах Intel Panther Lake та має величезну продуктивність зі 128 ГБ пам’яті LP5X, випуск цього кварталу

Хассан Муджтаба

Чи варто купувати? (Порада ІТ-Блогу): QNAP QAI-h1290FX – це потужний, але дорогий пристрій, орієнтований на професіоналів та компанії, яким потрібні локальні обчислювальні потужності для ШІ. Якщо вам потрібна система для роботи з великими мовними моделями та GenAI без залежності від хмари, і бюджет дозволяє, це чудовий вибір. Однак, для менш вимогливих завдань або домашнього використання існують значно доступніші альтернативи.

Подробиці можна знайти на сайті: wccftech.com