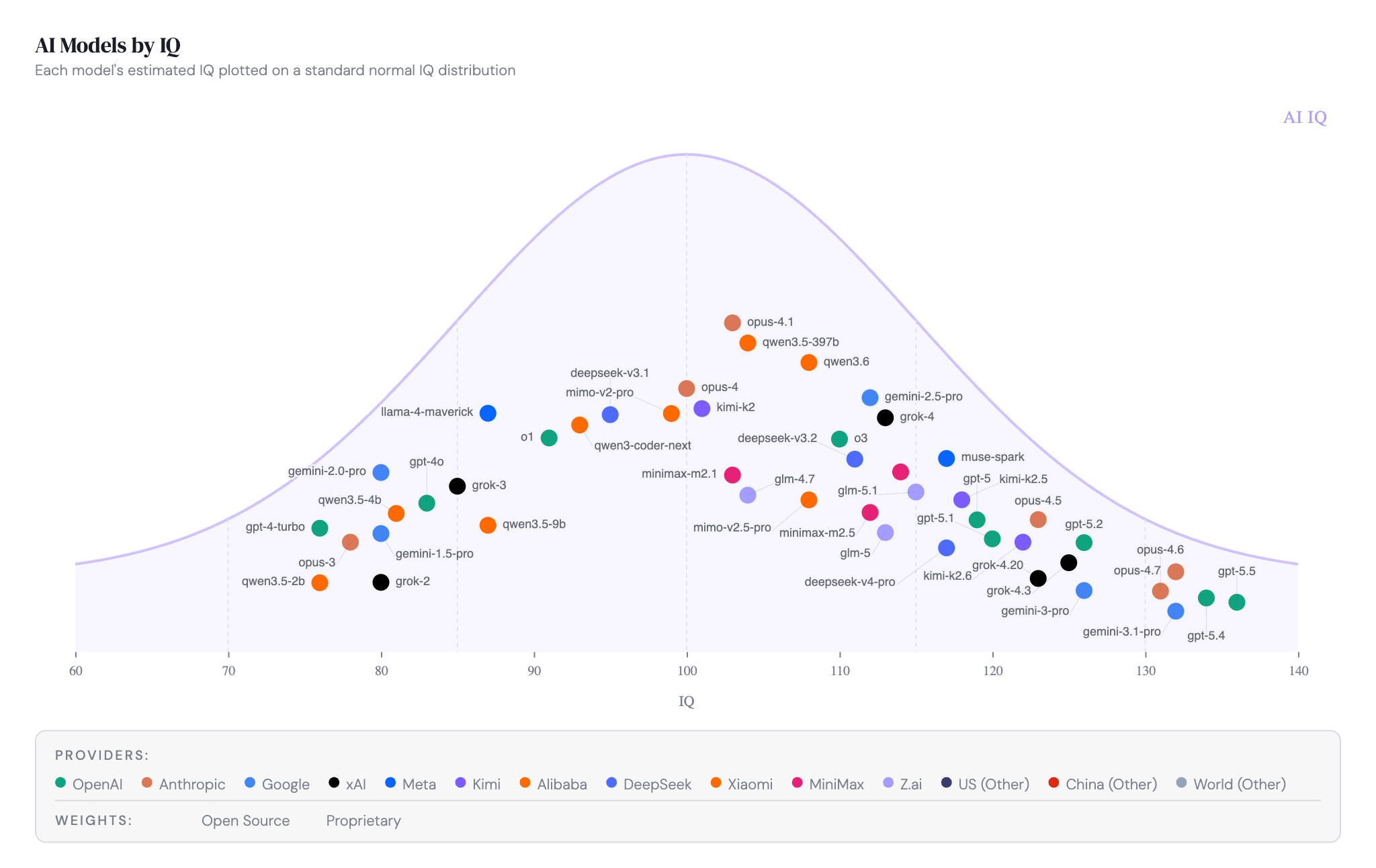

Протягом десятиліть тест на коефіцієнт інтелекту (IQ) був одним із найвідоміших, але й найсуперечливіших показників людського інтелекту. Тепер стартап-проєкт AI IQ застосовує цю ж метафору до штучного інтелекту, присвоюючи оціночні коефіцієнти інтелекту понад 50 найпотужнішим мовним моделям світу та відображаючи їх на стандартній кривій Гаусса.

Результатом є інтерактивні візуалізації на сайті aiiq.org, які за останній тиждень розлетілися соціальними мережами. Вони отримали схвалення від корпоративних технологів, які вважають, що ці діаграми роблять неймовірно складний ринок зрозумілим, але викликали різку критику від дослідників та коментаторів, які попереджають, що вся методологія вводить в оману.

“Це надзвичайно корисно”, – написав у X техно-коментатор Тібо Мелен. “Значно легше зрозуміти прогрес моделей, коли він відображений так, а не на черговій гігантській таблиці лідерів”.

Браян Веллмур, бізнес-стратег, висловив подібну підтримку: “Це корисно. Анекдотично це відповідає особистому досвіду”.

Але й відторгнення прийшло так само швидко. “Це нісенітниця. ШІ занадто нерівномірний. Карта – це не територія”, – написав AI Deeply, коментатор зі штучного інтелекту, висловлюючи занепокоєння, яке поділяють багато дослідників: що зведення розлогих, нерівномірних можливостей мовної моделі до одного числа створює небезпечну ілюзію точності.

Дванадцять тестів, чотири виміри та одне контроверсійне число: як працює AI IQ

AI IQ був розроблений Раяном Ши, інженером, підприємцем та бізнес-ангелом, найбільш відомим як співзасновник блокчейн-платформи Stacks. Ши також співзаснував Voterbase та інвестував на ранніх стадіях у кілька компаній-єдинорогів, зокрема OpenSea, Lattice, Anchorage та Mercury. Він має ступінь бакалавра наук з машинобудування від Університету Прінстона.

Методологія сайту ґрунтується на ззовні простій формулі. AI IQ групує 12 тестів у чотири виміри міркування: абстрактний, математичний, програмний та академічний. Композитний IQ є прямим середнім арифметичним цих чотирьох оцінок: IQ = ¼ (IQ_Abstract + IQ_Math + IQ_Prog + IQ_Acad).

Вимірювання абстрактного міркування базується на ARC-AGI-1 та ARC-AGI-2 – надзвичайно складних тестах на розпізнавання патернів, розроблених для оцінки загального флюїдного інтелекту. Математичне міркування включає FrontierMath (рівні 1–3 та 4), AIME та ProofBench. Програмне міркування використовує Terminal-Bench 2.0, SWE-Bench Verified та SciCode. Академічне міркування охоплює Humanity’s Last Exam, CritPt та GPQA Diamond.

Кожна сира оцінка з тесту відображається на умовний IQ через те, що сайт описує як “ручно калібровані криві складності”. Важливо, що методологія стискає стелі для тестів, які вважаються легшими або більш схильними до забруднення даних, запобігаючи їхньому завищенню оцінок вище 100. Складніші, менш схильні до маніпуляцій тести зберігають вищі стелі. Система також консервативно обробляє відсутні дані: моделі повинні мати оцінки щонайменше у двох із чотирьох вимірів, щоб отримати похідний IQ, і коли тести відсутні, процес навмисно знижує оцінки, а не підвищує їх. Сайт стверджує, що “кожен похідний IQ є середнім усіх чотирьох вимірів, тому відсутність покриття не може покращити модель через пропуск”.

OpenAI лідирує на кривій Гаусса, але розрив між провідними моделями ШІ ніколи не був таким малим

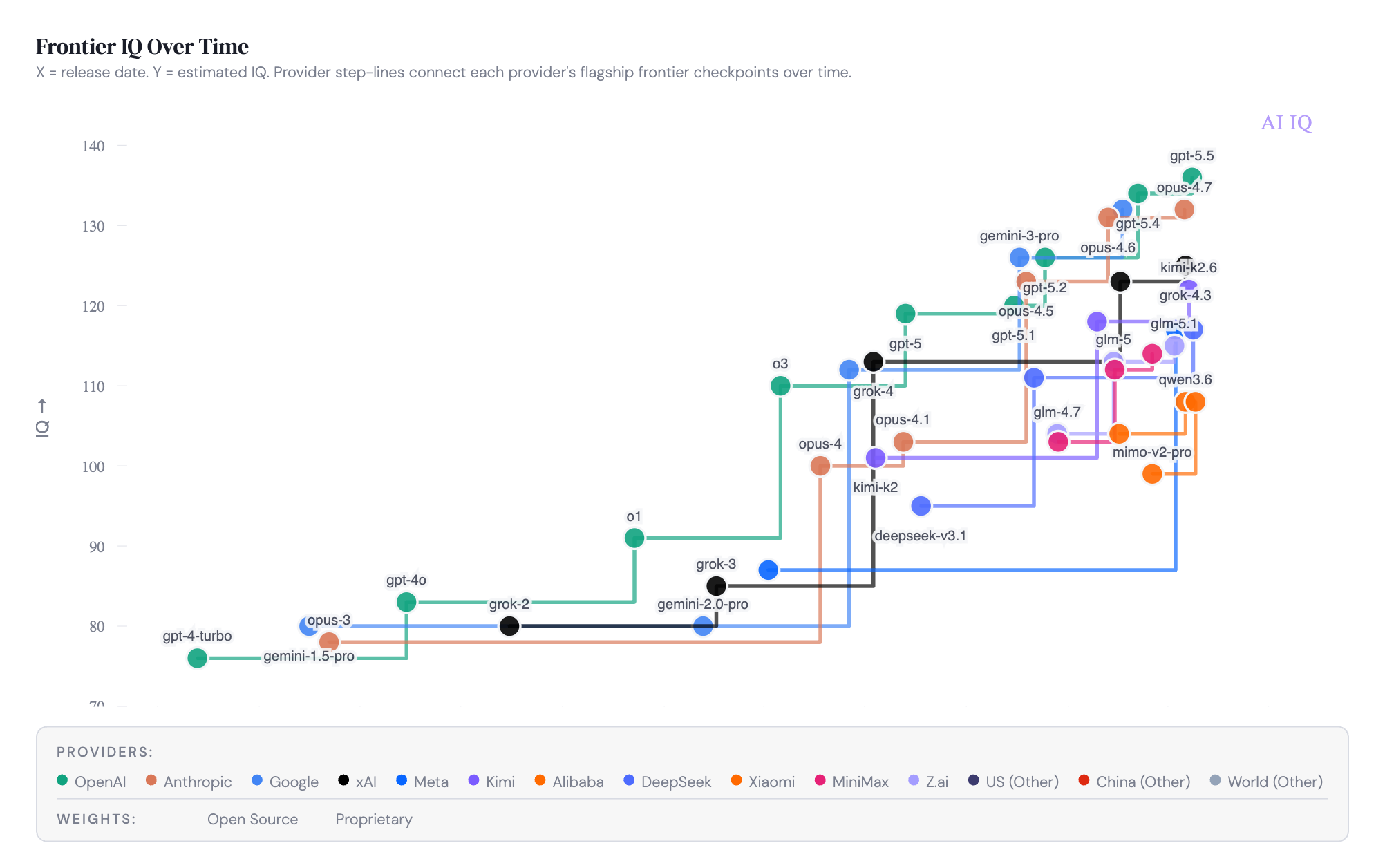

Станом на середину травня 2026 року, діаграми AI IQ демонструють швидку конвергенцію на вершині фронтиру – та розширення різноманітності на нижчих рівнях.

Згідно з діаграмою “Frontier IQ Over Time”, GPT-5.5 від OpenAI наразі посідає вершину кривої Гаусса з оціночним IQ близько 136 – найвищим серед усіх відстежуваних моделей. За ним тісно йдуть GPT-5.4 (приблизно 131), Opus 4.7 від Anthropic (приблизно 132) та Opus 4.6 (приблизно 129). Gemini 3.1 Pro від Google знаходиться біля 131, що робить верхній кластер надзвичайно щільним.

Це стиснення не є унікальним для моделі AI IQ. Visual Capitalist, посилаючись на окремий рейтинг від TrackingAI на основі тестів Mensa, нещодавно спостерігав ту ж динаміку, зазначаючи, що “найважливіший висновок – це те, наскільки стисненою стала верхня частина таблиці лідерів”. За цією шкалою, Grok-4.20 Expert Mode та GPT 5.4 Pro розділили перше місце з 145 балами, а Gemini 3.1 Pro – 141.

Нижче фронтирного кластера, діаграми AI IQ показують переповнену середину. Моделі з китайських лабораторій – Kimi K2.6, GLM-5, DeepSeek-V3.2, Qwen3.6, MiniMax-M2.7 – групуються в діапазоні приблизно від 112 до 118, що робить сегмент співвідношення ціна-продуктивність все більш конкурентним для корпоративних покупців, яким не потрібна абсолютна найкраща модель для кожного завдання. Один користувач X, ovsky, зазначив, що дані “підтверджують досвід з Sonnet 4.6 як абсолютно робочою конячкою, на відміну від Opus 4.5” – підкреслюючи, як діаграми можуть підтвердити інтуїцію практиків, яку часто пропускають основні рейтинги.

Чому оцінки емоційного інтелекту стають новим полем битви в рейтингах моделей ШІ

Що відрізняє AI IQ від більшості інших зусиль з бенчмаркінгу, так це включення “EQ” — коефіцієнта емоційного інтелекту. Сайт відображає оцінку EQ-Bench 3 Elo та Arena Elo кожної моделі на умовний EQ, використовуючи калібровані кусочно-лінійні шкали, а потім бере 50/50 зважений композит з обох.

Оцінки EQ дають суттєво відмінний рейтинг від IQ. На діаграмі розсіювання IQ проти EQ, Opus 4.7 від Anthropic лідирує за EQ з показником близько 132, що виводить його в верхній правий квадрант — найбажанішу позицію, яка сигналізує як про високий когнітивний, так і про високий емоційний інтелект. GPT-5.5 та GPT-5.4 від OpenAI знаходяться в зоні високого IQ, але дещо відстають за EQ. Gemini 3.1 Pro від Google займає сильну середню позицію за обома осями.

Одна примітна методологічна особливість привернула увагу: EQ-Bench 3 оцінюється за допомогою Claude, моделі від Anthropic, що, як визнає сайт, “створює потенційну упередженість оцінювання на користь моделей Anthropic”. Щоб це виправити, AI IQ віднімає 200-бальний штраф Elo від компонента EQ-Bench для всіх моделей Anthropic перед відображенням на умовний EQ. Компонент Arena не зазнає впливу, оскільки його оцінюють люди. Це самокоригування є незвичним у світі бенчмаркінгу і свідчить про те, що Ши усвідомлює методологічне мінне поле, в яке він ступив. Тим не менш, вимір EQ охоплює те, що сам по собі IQ не може: зростаючу важливість якості розмови, співпраці та довіри до моделей, що використовуються для роботи з користувачами.

Діаграма співвідношення ціни та продуктивності ШІ, яку дійсно потрібно побачити корпоративним покупцям

Можливо, найпрактичнішою діаграмою на сайті є не крива Гаусса, а графік розсіювання IQ проти ефективної вартості. Він відображає оціночний IQ кожної моделі проти метрики “ефективної вартості” — визначеної як вартість токена для завдання з використанням 2 мільйонів вхідних токенів і 1 мільйона вихідних токенів, помножена на коефіцієнт ефективності використання.

Діаграма показує знайомий патерн у корпоративних технологіях: найкращі моделі не завжди є найкращими за співвідношенням ціна-якість. GPT-5.5 та Opus 4.7 знаходяться у верхньому лівому куті – високий IQ, висока вартість, з ефективною вартістю за завдання понад 30 і 50 доларів відповідно. Тим часом, моделі, такі як GPT-5.4-mini, DeepSeek-V3.2 та MiniMax-M2.7, займають золоту середину: гідні показники IQ від 112 до 120, при ефективній вартості приблизно від 1 до 5 доларів за завдання. На найдешевшому кінці GPT-oss-20b (модель з відкритим кодом від OpenAI) коштує близько 0.20 доларів ефективної вартості з IQ близько 107 — потенційно найекономічніший варіант для великих обсягів класифікації або вилучення даних.

Сайт також пропонує 3D-візуалізацію, що відображає IQ, EQ та ефективну вартість одночасно. Пунктирна лінія, що проходить через куб, вказує на ідеал: вищий IQ, вищий EQ та нижча вартість. Моделі поблизу “зеленого кінця” цієї осі є сильнішими пропозиціями загалом; ті, що поблизу “червоного кінця”, жертвують можливостями, ефективністю витрат або обома. Для CIO, які дивляться на рахунки за API, висновок очевидний: розрив у інтелекті між моделлю за 50 доларів і моделлю за 3 долари звузився настільки, що маршрутизація — використання дорогих моделей для складних проблем і дешевих для всього іншого — більше не є опцією. Це домінуюча архітектура для серйозних розгортань ШІ.

Критики стверджують, що “нерівномірні” можливості ШІ роблять єдиний показник IQ небезпечно оманливим

Найгучніше заперечення проти AI IQ є філософським і зачіпає глибинні аспекти. Критики стверджують, що зведення нерівномірних можливостей моделі до одного показника приховує більше, ніж розкриває.

“IQ як замінник згасає — ми бачимо сплески щільності міркувань, які не відображаються на g-факторі”, – написав Zaya, техно-коментатор, у X. “GPT-5.5 вже досяг насичення на MMLU-Pro, але все ще зазнає невдач у ClockBench у 50% випадків”.

Це спостереження торкається того, що дослідники ШІ називають проблемою “нерівномірності”: великі мовні моделі часто демонструють вкрай неоднорідні можливості, відмінно справляючись із завданнями рівня аспірантури з фізики, але зазнаючи невдач у завданнях, які міг би виконати дитина. Композитний показник може приховати ці прогалини.

Pressureangle, інший користувач X, висловив більш деталізовану критику, закликавши до “повної відсутності прозорості” та стверджуючи, що сайт ніколи не розкриває повністю, як були створені або перевірені його калібрувальні криві. Справедливості заради, AI IQ дійсно перелічує свої 12 тестів і показує форму кожної калібрувальної кривої у своєму модальному вікні методології. Але сирі дані та точні математичні перетворення не публікуються як відкриті набори даних — прогалина, яка має значення для дослідників, звикших до повністю відтворюваних методів.

Інші поставили під сумнів саму передумову. “Такий же марний, як і тестування людського IQ”, – написав haashim у X. Шубхам Шарма, письменник, що спеціалізується на ШІ та технологіях, запропонував конструктивну альтернативу: “Чому б моделям не пройти офіційний тест (рівня Mensa)? Хіба це не був би найточніший і найбільш “людино-порівнянний” спосіб бенчмаркінгу інтелекту?”. Такий підхід вже існує через TrackingAI, який проводить тест IQ Mensa Norway для мовних моделей. Але тести рівня Mensa вимірюють лише абстрактне розпізнавання патернів, тоді як AI IQ намагається створити ширший композит, що охоплює програмування, математику та академічні міркування. Як зазначив Visual Capitalist, “тест типу IQ охоплює лише один зріз можливостей”. Кожен підхід має свої компроміси – і жоден ще не переміг у суперечці.

Справжня гонка – це не за найвищий бал, а за найрозумніший стек моделей

Незважаючи на всі суперечки щодо методології, найважливішим сигналом у даних AI IQ, можливо, є не оцінка окремої моделі. Це форма ринку, яку показують діаграми.

Наразі через API доступно понад 50 моделей фронтирного класу від щонайменше 14 великих постачальників зі США, Китаю та Європи. Кожен постачальник публікує власні бенчмарки, часто вибірково, щоб підкреслити сильні сторони. Результатом є Вавилонська вежа, де жодна компанія не вимірює одне й те саме однаково. Академічні дослідження підкреслюють, що “більшість бенчмарків вводять упередженість, фокусуючись на певному типі домену”, а діаграма Frontier IQ Over Time на AI IQ показує, наскільки швидко змінюються цілі: у жовтні 2023 року GPT-4-turbo знаходився біля оціночного IQ 75. На початку 2026 року провідні моделі досягали 135 – приблизно 60 пунктів покращення за 30 місяців.

Такий темп ставить фундаментальне питання: чи може будь-яка система оцінювання встигати? Сайт стискає стелі для насичених тестів, але оскільки моделі продовжують максимізувати навіть найскладніші тести — ARC-AGI-2, FrontierMath Tier 4, Humanity’s Last Exam — рамки зіткнуться з тими ж стельовими ефектами, які переслідували кожну оцінку ШІ раніше. Коннор Форсайт вказав на цю динаміку в X: “ARC AGI 3 не згоден”, – написав він, посилаючись на тест наступного покоління, який, можливо, вже підриває поточні оцінки.

AI IQ не є досконалим. Його методологія частково непрозора. Його метафора IQ може вводити в оману. І його творець визнає відомі упередження, ймовірно, пропускаючи інші. Але альтернатива — переглядати десятки таблиць бенчмарків від окремих постачальників, кожна з яких використовує різні набори тестів та конвенції оцінювання — є гіршою. Сайт пропонує корпоративним покупцям щось справді дефіцитне: єдину систему для порівняння моделей між постачальниками, вимірами та ціновими категоріями, яка регулярно оновлюється, з достатньою нюансуванням, щоб показати, що правильна відповідь на запитання “яка модель найкраща?” майже завжди “це залежить від завдання”.

Як розмірковував Дебдут Гхош у X після перегляду діаграм: “Тепер роль людини — просто оркеструвати?”.

Можливо. Але якщо дані AI IQ показують щось чітко, то це те, що оркестрація — знання, яку модель використовувати, коли і за якою ціною — стала власною формою інтелекту. І для цього ще немає жодного бенчмарку.

Прогноз ІТ-Блогу: В найближчі 1-2 роки ми, ймовірно, побачимо появу більш динамічних та адаптивних систем оцінювання, які зможуть реагувати на швидкий прогрес генеративного ШІ. Ймовірно, зросте фокус на оцінку не тільки “інтелекту”, але й етичних аспектів та безпеки моделей, а також на більш прозорі та відкриті методології бенчмаркінгу.

За даними порталу: venturebeat.com