Перегони у сфері штучного інтелекту останнім часом нагадують тенісний матч: спочатку Anthropic випускає нову, дорожчу, передову пропрієтарну модель для загальних користувачів (Claude Opus 4.7), а потім, тижнем пізніше, її конкурент OpenAI відповідає власною (GPT-5.5). Водночас китайські компанії, такі як DeepSeek та навіть Xiaomi, прагнуть залучити користувачів, граючи в іншу гру: наближаючись до межі можливостей, але з відкритими ліцензіями та значно нижчими витратами.

Тож поява нового, доступного, високоефективного відкритого конкурента зі США стає справжньою несподіванкою. Сьогодні ми отримали такий від менш відомого американського стартапу Poolside, заснованого у Сан-Франциско у 2023 році.

Компанія випустила дві нові великі мовні моделі Laguna, обидві з яких пропонують доступний інтелект, оптимізований для агентних робочих процесів (ШІ, що робить більше, ніж просто спілкування чи генерація контенту, але може, в даному випадку, писати код, використовувати сторонні інструменти та автономно діяти), а також новий інструментарій для кодування під назвою (доречно) “pool” та новий веб-орієнтований, мобільно оптимізований середовище розробки та інтерактивного попереднього перегляду для кодування, “shimmer”, яке дозволяє писати код з моделями Laguna на ходу.

Нові моделі ШІ, випущені Poolside сьогодні, включають:

-

Laguna M.1: пропрієтарна модель Mixture of Experts (MoE) з 225 мільярдами параметрів, з яких 23 мільярди активні. Ця флагманська модель оптимізована для критично важливих корпоративних та урядових середовищ, розроблена для вирішення складних, довгострокових проблем програмної інженерії, що вимагають максимальних можливостей міркування та планування.

-

Laguna XS.2: модель MoE з 33 мільярдами параметрів (3 мільярди активних), ліцензована за Apache 2.0. Розроблена для ефективності та спільнотної інновації, ця модель призначена для локальних завдань агентного кодування та надає універсальну основу для розробників, які бажають доналаштовувати, квантувати або розгортати потужні агенти на одному GPU. Іншими словами, розробники можуть завантажувати та запускати Laguna XS.2 на своїх настільних або навіть портативних комп’ютерах без підключення до Інтернету — повністю приватно та безпечно.

Варто зазначити, що лише менша з двох моделей, XS.2, наразі доступна під відкритою ліцензією Apache 2.0 (на Hugging Face). Однак Poolside також пропонує більшу M.1 безкоштовно тимчасово через свій API та партнерів з розповсюдження, таких як OpenRouter, Ollama та Baseten, що робить її чудовим варіантом для розробників, які бажають протестувати її.

Також примітно, що дві нові моделі Laguna були навчені з нуля — а не доналаштовані/пост-навчені базові моделі від китайського гіганта Alibaba серії Qwen, як це останнім часом роблять деякі інші американські лабораторії (*кашель* Cursor *кашель*).

Як зазначила Poolside у своєму блозі сьогодні, останні кілька років компанія “зосереджувалася на обслуговуванні наших державних та громадських клієнтів за допомогою потужних моделей, які можна розгортати в середовищах з найвищим рівнем безпеки”, але тепер переходить до відкритого коду, “щоб підтримати розробників та ширшу дослідницьку спільноту”.

Коли я запитав у X, чому державні установи будуть використовувати Poolside замість провідних пропрієтарних американських лабораторій, таких як Anthropic, OpenAI та Google, інженер з пост-тренування Poolside Джордж Григорєв відповів у своєму коментарі: “ми думаємо, що ми можемо швидше розгортати наші моделі для корпоративних клієнтів, і ми можемо буквально доставляти ваги у повністю ізольовані середовища на місці (on-prem), щоб вони могли працювати офлайн. це може бути критично важливим для державних/громадських секторів 🙂 але, звісно, корпоративний Anthropic важко перевершити”.

Як тренувалися моделі Laguna M.1 та Laguna XS.2 від Poolside

Poolside створює свої моделі ШІ у спеціалізованому цифровому середовищі під назвою “Model Factory”.

В основі цього процесу лежить Titan — потужне внутрішнє програмне забезпечення компанії, яке слугує “піччю” для тренування. Щоб допомогти ШІ навчатися якомога ефективніше, Poolside використовує унікальний інструмент під назвою оптимізатор Muon.

Уявіть Muon як високошвидкісного репетитора; він допомагає моделі освоювати нову інформацію приблизно на 15% швидше, ніж стандартні галузеві методи, що є критично важливим досягненням при тренуванні в масштабі 30 трильйонів токенів.

Це досягається завдяки забезпеченню того, що кожне оновлення “мозку” моделі є математично збалансованим і спрямованим у правильному напрямку, що запобігає заплутуванню або “застряганню” ШІ під час інтенсивних тренувальних сесій.

Інформація, яка використовується для тренування цих моделей — вражаючі 30 трильйонів “токенів” або шматків даних — ретельно відбирається за допомогою системи AutoMixer.

Замість того, щоб просто “згодовувати” ШІ все, що він знаходить в Інтернеті, AutoMixer використовує “рій” з шістдесяти проксі-моделей на різних комбінаціях даних, щоб науково визначити, яка комбінація коду, математики та загальних веб-даних забезпечує найкращі можливості міркування.

Таким чином, система діє як майстер-шеф, науково тестуючи тисячі різних “рецептів”, щоб знайти ідеальний баланс комп’ютерного коду, математики та загальних знань.

Хоча значна частина цих даних надходить з відкритого вебу, близько 13% становлять “синтетичні дані”. Це високоякісні, спеціально створені тренувальні матеріали, розроблені іншими ШІ для навчання моделей специфічним навичкам, які важко знайти в реальному світі.

Після завершення базового “навчання” модель потрапляє до віртуального тренажерного залу для навчання з підкріпленням (Reinforcement Learning). На цьому етапі ШІ практикується у вирішенні реальних інженерних завдань з програмного забезпечення у безпечному, ізольованому цифровому середовищі. Він навчається методом проб і помилок, отримуючи “винагороду” або позитивний сигнал щоразу, коли успішно виправляє помилку або пише робочий фрагмент коду. Цей постійний цикл практики та зворотного зв’язку перетворює ШІ з простого генератора тексту на здібного “агента”, який може планувати та виконувати складні, багатоетапні проекти, подібно до інженера-програміста-людини.

Хоча M.1 представляє вершину поточних досліджень Poolside, менша Laguna XS.2 може стати більш революційним продуктом.

Маючи лише 33 мільярди загальних параметрів (3 мільярди активних), XS.2 є моделлю MoE “другого покоління”, яка включає все, що команда дізналася під час тренування M.1.

Бенчмарки демонструють, що моделі Laguna від Poolside значно перевершують свій клас

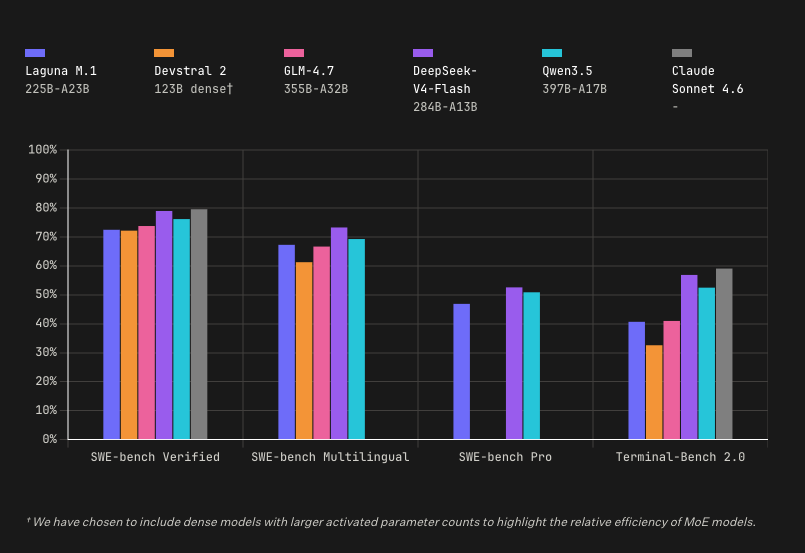

Продуктивність Laguna M.1 на SWE-bench Pro — бенчмарку, розробленому для тестування здатності ШІ вирішувати реальні проблеми програмного забезпечення — досягла 46.9% на SWE-bench Pro, наближаючись до продуктивності значно більших моделей Qwen-3.5 та DeepSeek V4-Flash.

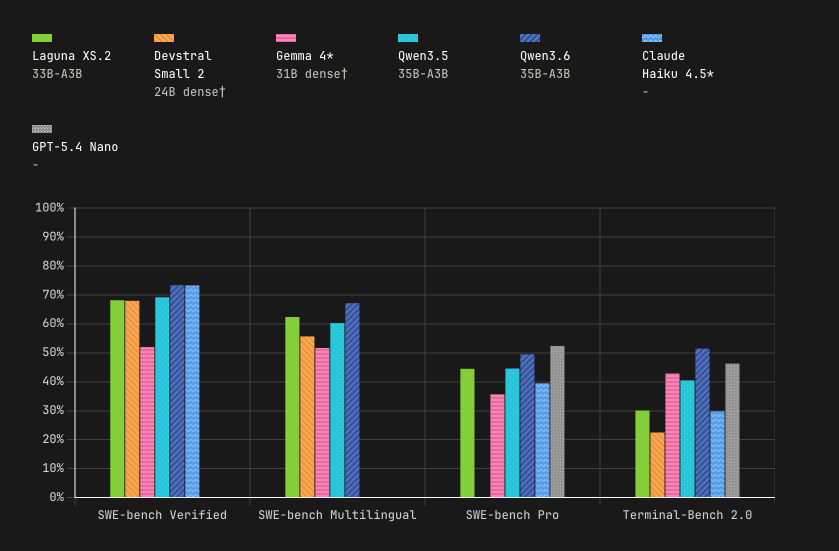

Незважаючи на значно менший розмір, Laguna XS.2 досягає 44.5% на SWE-bench Pro, майже відповідаючи результату свого старшого брата.

На треку SWE-bench Verified, M.1 показала результат 72.5%, перевершивши щільну модель Devstral 2 (72.2%), але поступившись Claude Sonnet 4.6, яка лідирує в цій категорії з показником 79.6%.

Ці результати підкреслюють спеціалізацію M.1 на довгострокових завданнях програмного забезпечення, особливо тих, що включають складне планування між взаємопов’язаними файлами.

Менша Laguna XS.2 демонструє виняткову ефективність, майже відповідаючи продуктивності свого значно більшого аналога у завданнях високої складності. Незважаючи на лише 3 мільярди активних параметрів, XS.2 перевершує Claude Haiku 4.5 (39.5%) та значно більшу щільну модель Gemma 4 31B (35.7%) на SWE-bench Pro.

У завданнях на міркування в терміналі, показник XS.2 у 30.1% на Terminal-Bench 2.0 також випереджає Haiku 4.5 (29.8%), хоча й залишається позаду спеціалізованих “нано”-моделей, таких як GPT-5.4 Nano, яка досягла 46.3% на тому ж бенчмарку.

Сукупно ці бенчмарки свідчать про те, що зосередженість Poolside на агентному навчанні з підкріпленням та курації синтетичних даних дозволила їхнім меншим моделям “виступати” у вагових категоріях, які зазвичай відведені для значно щільніших архітектур.

Хоча пропрієтарні моделі вищого класу, такі як Claude Sonnet 4.6, зберігають лідерство за загальними показниками успіху, сімейство Laguna — особливо модель XS.2 з відкритими вагами — пропонує конкурентоспроможну альтернативу для розробників, які надають перевагу локальному виконанню та налаштовуваним агентним робочим процесам.

Усі бенчмарки проводилися за допомогою фреймворку Harbor із ізольованим виконанням, що гарантує, що результати відображають здатність моделей функціонувати в реалістичних, обмежених ресурсами середовищах.

Запуск Laguna XS.2 локально

Для локального запуску моделі Laguna XS.2 (33B) ваше обладнання повинно підтримувати її 33 мільярди загальних параметрів. На Apple Silicon базова вимога — 36 ГБ об’єднаної пам’яті.

Для користувачів ПК та Linux, хоча стандартні ваги зазвичай вимагають понад 60 ГБ VRAM, підтримка моделлю 4-бітного квантування (Q4) дозволяє їй працювати на споживчих GPU з щонайменше 24-32 ГБ VRAM, таких як нещодавно випущена RTX 5090.

Зберігання також є фактором; слід виділити щонайменше 70 ГБ для повної моделі або приблизно 20-35 ГБ для стиснутої версії, придатної для локальних “агентних” завдань.

Для максимально плавного досвіду Poolside рекомендує використовувати Ollama або власний термінальний агент компанії pool, які розроблені для управління нативними можливостями моделі щодо міркування та виклику інструментів на споживчому обладнанні.

Повні технічні вимоги, включаючи специфічні конфігурації квантування та деталі ізоляції виконання коду, можна знайти на офіційній сторінці моделі на Hugging Face та у блозі Poolside. Нижче наведено деякі рекомендовані варіанти обладнання:

Mac

-

MacBook Pro (14-дюймовий або 16-дюймовий): Варто обирати моделі, оснащені чіпом M5 Max, який підтримує початкову конфігурацію 36 ГБ об’єднаної пам’яті. Хоча M5 Pro доступний, його потрібно буде налаштувати індивідуально, щоб перевищити базову пам’ять і досягти порогу 36 ГБ.

-

Mac Studio / Mac Mini: Mac Mini (M4 або M5 Pro), сконфігурований з щонайменше 48 ГБ або 64 ГБ оперативної пам’яті, є чудовою настільною альтернативою.

-

НЕ “MacBook Neo”: ця модель не підходить для запуску Laguna XS.2. Випущений на початку 2026 року як бюджетний варіант, MacBook Neo має обмеження до 8 ГБ немодернізованої пам’яті, що недостатньо для моделі з 33B параметрами.

PC

-

Конфігурація з одним GPU: NVIDIA GeForce RTX 5090 є найкращим вибором у 2026 році, пропонуючи 32 ГБ відеопам’яті GDDR7, що дозволяє запускати Laguna XS.2 на високій швидкості (приблизно 45 токенів/сек) з використанням квантування Q4.

-

Професійна конфігурація: Для професійних розробників, які запускають складні, довгострокові агенти, RTX PRO 6000 Blackwell (96 ГБ VRAM) або конфігурація з двома RTX 5090 дозволяють запускати модель без втрат стиснення.

-

Мінімальна специфікація ПК: RTX 4090 (24 ГБ) може запускати модель з більш агресивним квантуванням, хоча продуктивність може бути нижчою під час складних завдань міркування.

pool (агент) та shimmer (IDE)

Моделі настільки корисні, наскільки й середовища, в яких вони існують, і Poolside випустила два “попередні” продукти для розміщення серії Laguna: pool та shimmer.

pool — це агент для кодування на основі терміналу, розроблений для локального середовища розробника. Він діє як сервер Agent Client Protocol (ACP), той самий інструментарій, який команда використовує внутрішньо для тренування з підкріпленням (RL).

Надаючи власні інструменти дослідників широкому загалу, Poolside фактично запрошує спільноту розробників брати участь у “тренажерному залі реального світу”, який тренує їхні майбутні моделі.

Shimmer представляє бачення хмарно-орієнтованого майбутнього розробки. Це миттєво доступна пісочниця віртуальної машини (VM), де розробники можуть ітераційно працювати з веб-додатками, API та CLI за лічені секунди.

На відміну від традиційних інтегрованих середовищ розробки (IDE), таких як Microsoft Visual Studio, shimmer інтегрує Poolside Agent безпосередньо в робочий простір, дозволяючи йому легко надсилати зміни до GitHub або імпортувати існуючі репозиторії.

Мабуть, найдивовижнішою особливістю shimmer є його портативність. Засновник Poolside, дизайнер Аласдер Монк, продемонстрував shimmer, що повністю працює на смартфоні.

У демонстрації інтерфейс розділеного екрану показує, як Poolside Agent генерує анімацію “З Новим роком 2026!”, тоді як середовище розробки працює знизу.

Як зазначив Монк, це забезпечує миттєво доступну VM з Poolside Agent на розділеному екрані та повноцінне середовище розробки на мобільному пристрої.

Це свідчить про майбутнє, де високопріоритетна інженерія не прив’язана до настільного комп’ютера, а може відбуватися будь-де, де інженер має екран.

Чому Laguna XS.2 випущено з відкритими вагами Apache 2.0?

Найважливішим стратегічним кроком у цьому релізі є ліцензування Laguna XS.2. Poolside випустила ваги XS.2 під ліцензією Apache 2.0.

Це дуже дозвільна ліцензія, яка дозволяє користувачам використовувати, розповсюджувати та модифікувати програмне забезпечення для будь-яких цілей, включаючи комерційне використання, без роялті. Це різко контрастує з “закритими” моделями багатьох конкурентів або навіть більш обмежувальними “відкритими-ніби” ліцензіями, що використовуються деякими іншими лабораторіями.

Керівництво Poolside чітко пояснює причину вибору цього шляху. У блозі Poolside зазначено їхнє переконання, що “Захід потребує потужних моделей з відкритими вагами” і що випуск ваг є найшвидшим способом для команди покращити свою роботу через оцінку спільнотою та доналаштування.

Передаючи ваги високоефективної моделі агентного типу з 33 мільярдами параметрів у руки дослідників і стартапів, Poolside позиціонує себе як наріжний камінь екосистеми відкритого ШІ.

Хоча Laguna M.1 залишається переважно доступною через API, відкритий випуск XS.2 гарантує, що технологія Poolside буде інтегрована в наступне покоління сторонніх інструментів.

Філософія та підхід Poolside

Основний постулат роботи Poolside полягає в тому, що розробка програмного забезпечення є найвищим проксі для загального інтелекту.

Створення програмного забезпечення вимагає довгострокового планування, складного міркування та здатності маніпулювати абстрактними системами — усі ці риси є центральними для людського пізнання. Хоча більшість поточних “агентів” ШІ обмежені викликом інструментів через попередньо визначені інтерфейси, агенти Poolside розроблені для написання та виконання власного коду для вирішення проблем.

Цей перехід від використання інструментів до створення систем знаменує собою фундаментальну еволюцію у способі взаємодії ШІ з цифровим світом.

Команда з приблизно 60 осіб в організації прикладних досліджень витратила три роки та провела десятки тисяч експериментів, щоб досягти цього моменту. Їхнє бачення AGI — це не просто інтелект, а “достаток для людства”.

Зосередившись на програмній інженерії — домені з перевіреними результатами, такими як успішні тести та компіляція — вони створили самовдосконалювальний цикл зворотного зв’язку. Як стверджує команда, вони будують “термоядерний реактор” для даних: витягуючи кожну останню краплю інтелекту з наявних людських знань, одночасно використовуючи RL для збору “енергії вітру” нового, свіжого досвіду.

Шлях Poolside тільки починається, але випуск Laguna встановлює високу планку для того, яким має бути “агентний” ШІ у 2026 році. Поєднуючи передову продуктивність із зобов’язанням щодо відкритих ваг та інноваційних поверхонь для розробників, вони прокладають шлях до AGI, який є настільки ж про спосіб створення, наскільки й про те, що створюється.

Як для підприємств, так і для індивідуальних розробників посил очевидний: майбутнє роботи — агентне, і мовою цього майбутнього є код.

Прогноз ІТ-Блогу: Відкрите ліцензування моделі Laguna XS.2 значно прискорить її інтеграцію в різноманітні інструменти та сервіси, створюючи нові можливості для розробки більш складних та автономних ШІ-агентів. Ймовірно, ми побачимо появу низькорівневих рішень, які використовують цю модель для локального виконання завдань, що стане кроком до децентралізації та підвищення приватності в сфері ШІ.

За даними порталу: venturebeat.com