Відкритий код як прапор нової ери штучного інтелекту

Від часу появи ChatGPT наприкінці 2022 року, естафета розробки відкритих моделей машинного навчання переходила від одних гравців до інших. Meta з її сімейством Llama, китайські лабораторії Qwen та z.ai – усі вони робили вагомий внесок. Проте останнім часом спостерігається тенденція до повернення китайських компаній до пропрієтарних рішень, тоді як американські лабораторії, як-от Cursor та NVIDIA, випускають власні модифікації китайських моделей. Це залишає відкритим питання щодо того, хто саме стане рушійною силою в цій галузі надалі. Відповідь, можливо, криється у звістці від Arcee – стартапу з Сан-Франциско. Цього тижня компанія представила AI Trinity-Large-Thinking – мовну модель, що оперує 399 мільярдами параметрів та зосереджена виключно на задачах міркування. Реліз під відкритим ліцензуванням Apache 2.0 гарантує повну гнучкість налаштування та комерційне використання для будь-кого – від незалежних розробників до великих підприємств. Цей випуск – це не просто черговий набір ваг у спільноті розробників AI-коду Hugging Face. Це стратегічна ставка на те, що “Американські відкриті ваги” (American Open Weights) можуть стати суверенною альтернативою до дедалі більш закритих або обмежених передових моделей 2025 року. Цей крок зроблено саме в той момент, коли підприємства висловлюють зростаюче занепокоєння щодо залежності від китайських архітектур для своєї критичної інфраструктури. Це створює попит на вітчизняного лідера, яким Arcee прагне стати. Як зазначив Клеман Деланж, співзасновник та генеральний директор Hugging Face, у прямому повідомленні на X: “Сила Америки завжди полягала в її стартапах, тому, можливо, саме на них нам слід розраховувати, щоб лідирувати у сфері відкритих AI-рішень. Arcee доводить, що це можливо!”

Зародження передової лабораторії з 30 інженерів

Щоб зрозуміти вагомість випуску Trinity, необхідно усвідомити, хто стоїть за цією розробкою. Arcee AI – це компактна команда з лише 30 співробітників, розташована в Сан-Франциско. Тоді як конкуренти, такі як OpenAI та Google, оперують тисячами інженерів та мають бюджети на обчислювальні потужності, що вимірюються мільярдами доларів, Arcee вибудовує свою стратегію навколо того, що технічний директор Лукас Аткінс називає “інженерією через обмеження”. Компанія вперше привернула до себе увагу у 2024 році, залучивши $24 мільйони в раунді Series A під керівництвом Emergence Capital, що довело загальний обсяг залученого капіталу до трохи менше ніж $50 мільйонів. На початку 2026 року команда пішла на величезний ризик: вони виділили $20 мільйонів – майже половину свого загального фінансування – на один 33-денний цикл тренування для Trinity Large. Використовуючи кластер з 2048 GPU NVIDIA B300 Blackwell, які забезпечили вдвічі більшу швидкість порівняно з попереднім поколінням Hopper, Arcee поставила на кін майбутнє компанії, виходячи з переконання, що розробникам потрібна передова модель, якою вони могли б по-справжньому володіти. Ця ризикована ставка стала майстер-класом з ефективності капіталу, довівши, що невелика, сфокусована команда може створити повний пайплайн та стабілізувати процес навчання без безкінечних резервів.

Інженерія через екстремальні архітектурні обмеження

Trinity-Large-Thinking вирізняється надзвичайною розрідженістю свого механізму уваги. Хоча модель містить 400 мільярдів параметрів, завдяки архітектурі Mixture-of-Experts (MoE) для кожного токена активується лише 1.56%, або 13 мільярдів параметрів. Це дозволяє моделі зберігати глибокі знання великої системи, одночасно підтримуючи швидкість виведення та операційну ефективність на рівні значно меншої моделі. На тому самому обладнанні вона працює приблизно в 2-3 рази швидше за своїх аналогів. Навчання такої розрідженої моделі створювало значні виклики зі стабільністю. Щоб запобігти домінуванню кількох експертів, тоді як інші залишаються невивченими, Arcee розробила SMEBU (Soft-clamped Momentum Expert Bias Updates). Цей механізм забезпечує спеціалізацію експертів та їх рівномірний розподіл по загальному корпусу Інтернету. Архітектура також включає гібридний підхід, чергуючи локальні та глобальні шари уваги зі ковзним вікном у співвідношенні 3:1 для підтримки продуктивності в сценаріях з довгим контекстом.

Навчальна програма та синтетичні міркування

Партнерство Arcee з іншим стартапом, DatologyAI, забезпечило навчальний корпус із понад 10 трильйонів курованих токенів. Однак, корпус для навчання повномасштабної моделі було розширено до 20 трильйонів токенів, розділених порівну між курованими даними з Інтернету та високоякісними синтетичними даними. На відміну від типових синтетичних даних, створених шляхом імітації, де менша модель просто навчається імітувати більшу, DatologyAI використовувала методи синтетичного переписування сирих веб-текстів (наприклад, статей Вікіпедії чи блогів) для конденсації інформації. Цей процес допоміг моделі навчитися міркувати над концепціями та інформацією, а не просто запам’ятовувати точні послідовності токенів. Для забезпечення відповідності нормам було докладено величезних зусиль для виключення книг, захищених авторським правом, та матеріалів з невизначеним ліцензуванням. Це привабило корпоративних клієнтів, які обережно ставляться до ризиків інтелектуальної власності, пов’язаних із загальноприйнятими великими мовними моделями. Цей підхід, що базується на даних, дозволив моделі масштабуватися без проблем, одночасно значно покращуючи продуктивність у складних завданнях, таких як математика та багатоетапне використання інструментів агентами.

Перехід від балакучих чат-ботів до агентів, що міркують

Визначальною особливістю цього офіційного релізу є перехід від стандартної моделі “інструкцій” (instruct) до моделі “міркувань” (reasoning). Запровадивши фазу “роздумів” (thinking) перед генерацією відповіді – аналогічно до внутрішніх циклів, що були реалізовані в ранній Trinity-Mini – Arcee вирішила головну критику свого “Попереднього” релізу в січні. Ранні користувачі попередньої версії відзначали, що вона іноді мала труднощі з багатоетапними інструкціями в складних середовищах і могла бути “недостатньо потужною” для агентних завдань. Оновлення “Thinking” ефективно заповнює цю прогалину, забезпечуючи те, що Arcee називає “агентами з довгим горизонтом”, які можуть підтримувати узгодженість під час багатооборотних викликів інструментів без “розхлябаності”. Цей процес міркування забезпечує кращу контекстну когерентність та чіткіше слідування інструкціям в умовах обмежень. Це має прямі наслідки для Maestro Reasoning – похідної моделі Trinity з 32 мільярдами параметрів, яка вже використовується в галузях, пов’язаних з аудитом, для надання прозорих відстежень “думка-відповідь”. Метою було вийти за рамки “балакучих” або неефективних чат-ботів, рухаючись до надійних, економічних, високоякісних агентів, які залишаються стабільними протягом тривалих циклів роботи.

Геополітика та аргументи на користь американських відкритих ваг

Значення прихильності Arcee до ліцензії Apache 2.0 посилюється відступом її основних конкурентів з ринку передових відкритих моделей. Протягом 2025 року китайські дослідницькі лабораторії, такі як Qwen від Alibaba та z.ai (Zhupai), задавали темп у розробці високоефективних MoE-архітектур. Однак, з настанням 2026 року, ці лабораторії почали переорієнтовуватися на пропрієтарні корпоративні платформи та спеціалізовані підписки, сигналізуючи про відхід від чистого зростання спільноти. Фрагментація цих колись продуктивних команд, як-от відхід ключових технічних керівників з лабораторії Qwen Alibaba, залишила порожнечу на високому рівні ринку відкритих моделей. У Сполучених Штатах цей рух також зіткнувся зі своєю кризою. Підрозділ Llama від Meta помітно відступив з передового ландшафту після змішаної реакції на Llama 4 у квітні 2025 року, яка, за повідомленнями, мала проблеми з якістю та маніпуляціями бенчмарками. Для розробників, які покладалися на домінування епохи Llama 3, відсутність поточної відкритої моделі з понад 400 мільярдами параметрів створила нагальну потребу в альтернативі, яку Arcee прагне заповнити.

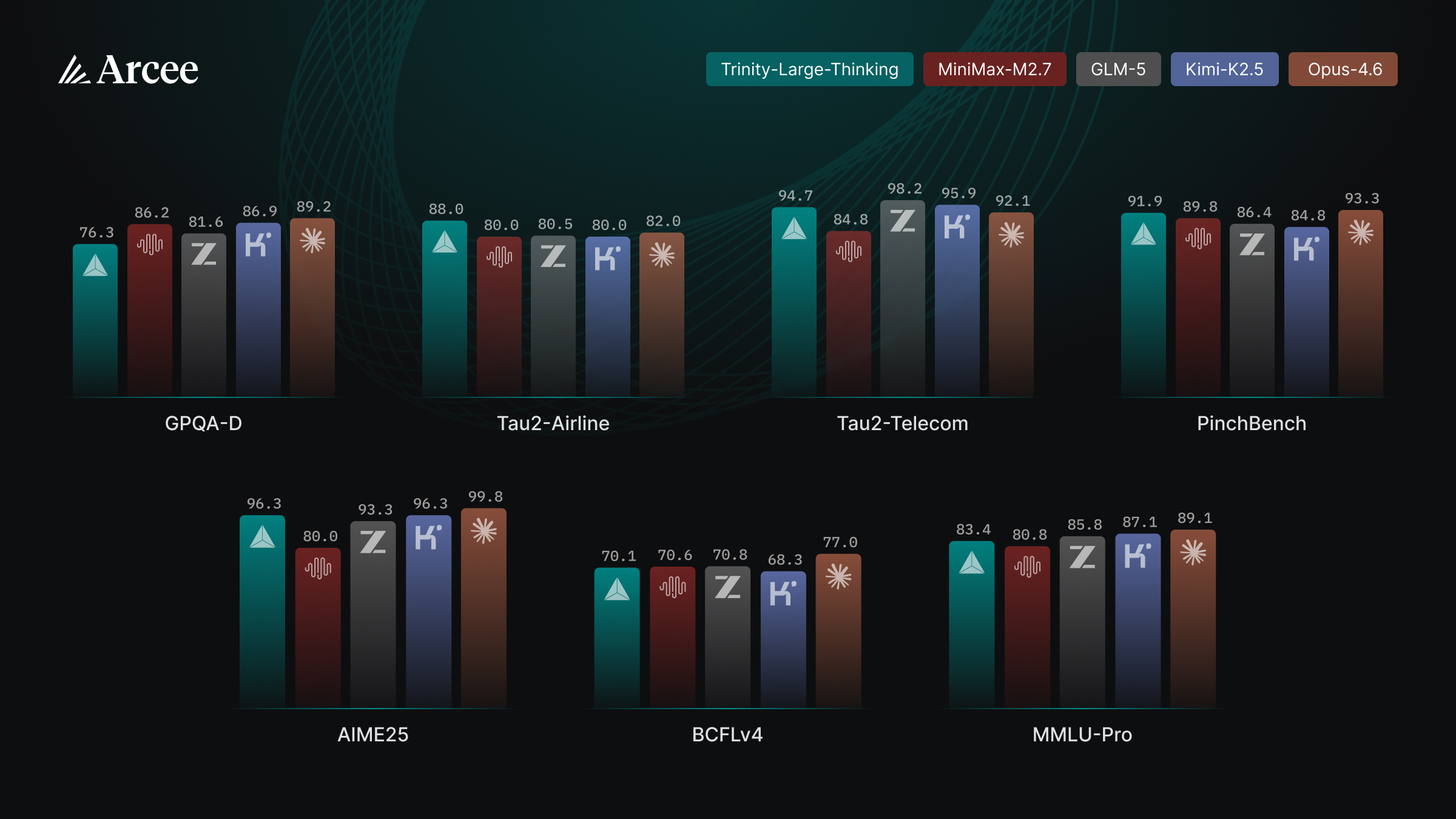

Бенчмарки: як Trinity-Large-Thinking від Arcee конкурує з іншими американськими пропозиціями відкритих AI-моделей

Продуктивність Trinity-Large-Thinking у спеціалізованих оцінках агентів позиціонує її як серйозного претендента на передовому рівні. На PinchBench, критично важливому метриці для оцінки можливостей моделі в автономних агентних завданнях, Trinity досягла результату 91.9, поступившись лише пропрієтарному лідеру ринку Claude Opus 4.6 (93.3).

Ця конкурентоспроможність відображається і в IFBench, де результат Trinity – 52.3 – майже зрівнюється з показником Opus 4.6 (53.1). Це свідчить про те, що оновлення “Thinking”, яке ставить міркування на перше місце, успішно усунуло перешкоди у виконанні інструкцій, що були проблемою для ранньої версії моделі. Ширші можливості моделі в галузі технічних міркувань також позиціонують її на високому рівні сучасного ринку відкритих рішень. Вона показала результат 96.3 на AIME25, зрівнявшись з висококласною Kimi-K2.5 і випередивши інших значних конкурентів, таких як GLM-5 (93.3) та MiniMax-M2.7 (80.0). Хоча висококласні бенчмарки з кодування, як-от SWE-bench Verified, все ще демонструють перевагу пропрієтарних моделей вищого класу (Trinity показала 63.2 проти 75.6 у Opus 4.6), величезна різниця в ціні за токен робить Trinity більш життєздатною суверенною інфраструктурною платформою для підприємств, які прагнуть розгорнути ці можливості в промисловому масштабі. Серед інших американських відкритих моделей передового рівня, OpenAI’s gpt-oss досягає максимум 120 мільярдів параметрів, але також варто згадати Google з Gemma (Gemma 4 була випущена цього тижня) та сімейство Granite від IBM, незважаючи на нижчі показники. Сімейство Nemotron від Nvidia також заслуговує на увагу, але є модифікаціями Qwen, дотренованими та постоброблені.

| Бенчмарк | Arcee Trinity-Large | gpt-oss-120B (High) | IBM Granite 4.0 | Google Gemma 4 |

| GPQA-D | 76.3% | 80.1% | 74.8% | 84.3% |

| Tau2-Airline | 88.0% | 65.8%* | 68.3% | 76.9% |

| PinchBench | 91.9% | 69.0% (IFBench) | 89.1% | 93.3% |

| AIME25 | 96.3% | 97.9% | 88.5% | 89.2% |

| MMLU-Pro | 83.4% | 90.0% (MMLU) | 81.2% | 85.2% |

Отже, як підприємству обрати серед усіх цих пропозицій? Arcee Trinity-Large-Thinking є найкращим вибором для організацій, що створюють автономних агентів. Її розріджена архітектура з 400 мільярдами параметрів чудово справляється з “обдумуванням” багатоетапної логіки, складних математичних завдань та довготривалого використання інструментів. Активуючи лише частину своїх параметрів, вона надає високошвидкісний механізм міркування для розробників, які потребують можливостей планування рівня GPT-4o в рамках економічно ефективної, відкритої структури. Натомість, gpt-oss-120B слугує оптимальним проміжним варіантом для підприємств, які потребують високої продуктивності міркувань, але надають пріоритет нижчим операційним витратам та гнучкості розгортання. Оскільки вона активує лише 5.1 мільярда параметрів за один прохід, вона є унікально придатною для технічних завдань, таких як генерація конкурентного коду та просунуте математичне моделювання, які мають виконуватися на обмеженому обладнанні, наприклад, на одному GPU H100. Її конфігурований рівень міркувань – пропонуючи режими “Низький”, “Середній” та “Високий” – робить її найкращим вибором для виробничих середовищ, де затримка та точність повинні динамічно балансуватися залежно від завдань. Для ширших, високопродуктивних застосувань, Google Gemma 4 та IBM Granite 4.0 слугують основними опорними точками. Gemma 4 пропонує найвищу “щільність інтелекту” для загальних знань та наукової точності, що робить її найбільш універсальним варіантом для досліджень і розробок та високошвидкісних інтерфейсів чату. Тим часом, IBM Granite 4.0 розроблений для “цілоденної” корпоративної роботи, використовуючи гібридну архітектуру, яка усуває контекстні вузькі місця для обробки величезних обсягів документів. Для бізнесів, стурбованих юридичною відповідністю та ефективністю використання обладнання, Granite залишається найнадійнішою основою для великомасштабних RAG (Retrieval-Augmented Generation) та аналізу документів.

Володіння як функція для регульованих галузей

У цьому кліматі вибір Arcee ліцензії Apache 2.0 є свідомим кроком до диференціації. На відміну від обмежувальних ліцензій спільноти, що використовуються деякими конкурентами, Apache 2.0 дозволяє підприємствам по-справжньому володіти своїм інтелектуальним стеком без “чорної скриньки” упереджень загальнопризначеної чат-моделі. “Розробникам та підприємствам потрібні моделі, які вони можуть перевіряти, дотреновувати, розміщувати, дистилювати та якими володіти”, – зазначив Лукас Аткінс у прес-релізі. Це володіння є критично важливим для “гіркого уроку” навчання малих моделей: зазвичай потрібно спочатку навчити величезну передову модель, щоб генерувати високоякісні синтетичні дані та логіти, необхідні для створення ефективних моделей-учнів. Крім того, Arcee випустила Trinity-Large-TrueBase – сирий чекпойнт з 10 трильйонами токенів. TrueBase пропонує рідкісний, “незіпсований” погляд на фундаментальний інтелект до застосування інструкцій та навчання з підкріпленням. Для дослідників у високорегульованих галузях, таких як фінанси та оборона, TrueBase дозволяє проводити автентичні аудити та власні налаштування, починаючи з чистого аркуша.

Вердикт спільноти та майбутнє дистиляції

Відгуки від спільноти розробників загалом позитивні, що відображає бажання отримати більше відкритих моделей, розроблених у США. У X дослідники відзначили disruptive ефект, зазначивши, що “неймовірно низькі” ціни для моделі такого масштабу стануть значним стимулом для спільноти агентів. На платформі OpenRouter, яка займається оцінкою ефективності роботи відкритих AI-моделей, Trinity-Large-Preview стала найпопулярнішою відкритою моделлю в США, обробляючи понад 80.6 мільярдів токенів у пікові дні, як-от 1 березня 2026 року. Близькість Trinity-Large-Thinking до Claude Opus 4.6 за показником PinchBench (91.9 проти 93.3) є особливо вражаючою, якщо порівняти це з вартістю. При ціні $0.90 за мільйон вихідних токенів, Trinity приблизно на 96% дешевша за Opus 4.6, вартість якого становить $25 за мільйон вихідних токенів. Стратегія Arcee тепер зосереджена на передачі цих уроків з попереднього та пост-тренування вниз по стеку. Значна частина роботи, виконаної для Trinity Large, тепер буде втілена в моделях Mini та Nano, оновлюючи компактну лінійку компанії шляхом дистиляції міркувань передового рівня. У той час як глобальні лабораторії схиляються до пропрієтарної замкненості, Arcee позиціонує Trinity як суверенний інфраструктурний рівень, яким розробники нарешті можуть керувати та адаптувати для довгострокових агентних робочих процесів.

Прогноз ІТ-Блогу: Випуск Trinity-Large-Thinking свідчить про зростання попиту на потужні, але відкриті моделі, що конкурують з комерційними аналогами. Очікується, що ця тенденція стимулюватиме подальшу розробку більш ефективних та спеціалізованих відкритих рішень, особливо в галузі агентних систем.

Оригінал статті: venturebeat.com