Intercom, компанія з багаторічною історією у сфері програмного забезпечення, робить несподівану ставку: розробку власної моделі штучного інтелекту.

15-річна платформа для обслуговування клієнтів представила Fin Apex 1.0 – невелику, спеціалізовану модель ШІ, яка, за заявами компанії, перевершує провідні передові моделі від OpenAI та Anthropic за ключовими показниками ефективності у сфері підтримки клієнтів.

Ця модель живить існуючого ШІ-агента Intercom, Fin, який щотижня обробляє понад два мільйони розмов з клієнтами.

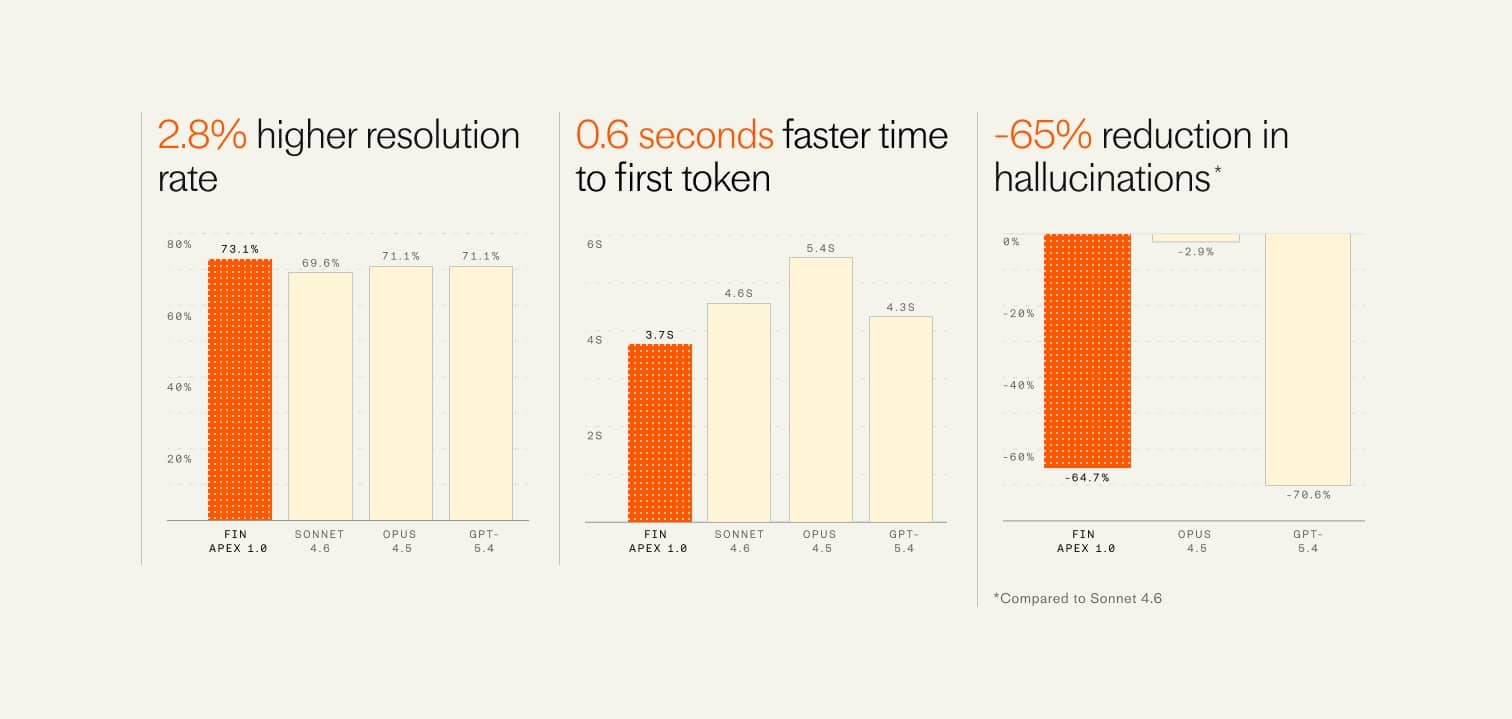

Згідно з результатами бенчмарків, наданими VentureBeat, Fin Apex 1.0 досягає 73,1% коефіцієнта вирішення проблем (відсоток питань, повністю вирішених без втручання людини). Це перевищує показники GPT-4o (71,1%) та Claude 3.5 Opus (71,1%), а також Claude 3.5 Sonnet (69,6%). Хоча перевага у приблизно 2 відсоткові пункти може здатися незначною, це ширший розрив, ніж зазвичай спостерігається між послідовними поколіннями провідних моделей.

"Якщо ви керуєте масштабними операціями обслуговування клієнтів, маючи 10 мільйонів клієнтів або мільярд доларів річного доходу, дельта у 2% чи 3% означає значну кількість клієнтів, взаємодій та доходу," – зазначив генеральний директор Intercom Еоган МакКейб під час відеоінтерв’ю для VentureBeat.

Модель також демонструє значні покращення у швидкості та точності. Fin Apex надає відповіді в середньому за 3,7 секунди – на 0,6 секунди швидше за найближчого конкурента. Крім того, вона зменшує кількість “галюцинацій” (неправильних або вигаданих відповідей) на 65% порівняно з Claude 3.5 Sonnet.

Особливо привабливим для корпоративних клієнтів є те, що вартість її використання становить приблизно п’яту частину від вартості використання провідних моделей безпосередньо. Ця модель інтегрована в існуючу структуру ціноутворення Intercom, що базується на оплаті за результат.

Яка базова модель? Чи це має значення?

Однак є нюанс. На запитання про те, яка базова модель використовувалася для Apex, та її розмір (кількість параметрів), Intercom відмовився надати конкретну інформацію.

"Ми не розкриваємо базову модель, яку використовували для Apex 1.0, з міркувань конкурентоспроможності, а також тому, що плануємо змінювати базові моделі з часом," – повідомив представник компанії. Компанія лише підтвердила, що модель має "розмір у сотні мільярдів параметрів".

Для порівняння, моделі Llama 3.1 від Meta варіюються від 8 до 405 мільярдів параметрів, а великі провідні моделі, як GPT-4o, ймовірно, мають трильйони параметрів.

Залишається відкритим питанням, наскільки обґрунтованими є заявлені показники продуктивності Apex у цьому контексті, або чи відображають бенчмарки оптимізації, можливі лише у вузьких, специфічних для домену застосуваннях.

Intercom стверджує, що врахував негативну реакцію, яку отримав стартап Cursor, коли його звинуватили у приховуванні того, що модель Composer 2 була побудована на основі доналаштованих моделей з відкритим кодом, а не на пропрієтарних технологіях. Однак урок, засвоєний Intercom, може не задовольнити скептиків: компанія відкрито заявляє про використання базової моделі з відкритим кодом, але не уточнює, якої саме.

"Ми дуже відкрито говоримо, що ми" використовували модель з відкритим кодом," – сказав представник. Однак відмова назвати модель, претендуючи на прозорість, є суперечністю, яка, ймовірно, викличе прискіпливу увагу, особливо з огляду на те, що все більше компаній рекламують "власні" ШІ, які насправді є доналаштованими версіями загальнодоступних рішень.

Пост-тренування як нова межа

Аргумент Intercom полягає в тому, що базова модель вже не має такого великого значення.

"Попереднє навчання (pre-training) зараз майже як товар," – зазначив МакКейб. "Справжньою межею, якщо хочете, є пост-тренування. Пост-тренування – це складна частина. Вам потрібні пропрієтарні дані. Вам потрібні власні джерела істини."

Компанія здійснила пост-тренування обраної фундаментальної моделі, використовуючи багаторічні пропрієтарні дані з обслуговування клієнтів, накопичені через Fin, яка нині вирішує 2 мільйони запитів на тиждень. Цей процес включав більше, ніж просто подачу транскриптів моделі. Intercom розробив системи навчання з підкріпленням, засновані на реальних результатах вирішення проблем, навчаючи модель тому, як виглядає успішне обслуговування клієнтів: відповідний тон, здатність приймати рішення, структура розмови і, що найважливіше, як розпізнати, коли проблема дійсно вирішена, а не коли клієнт все ще роздратований.

"Загальні моделі навчаються на загальних даних з Інтернету. Спеціалізовані моделі навчаються на гіперспецифічних даних певного домену," – пояснив МакКейб. "Тому логічно, що інтелект загальних моделей є загальним, а інтелект специфічних моделей є специфічним для домену і, отже, працює значно краще для конкретного випадку використання."

Якщо МакКейб має рацію, що весь магічний ефект полягає в пост-тренуванні, то небажання називати базову модель стає важче виправдати. Якщо основа справді взаємозамінна, яку конкурентну перевагу захищає секретність?

Ставка в 100 мільйонів доларів, що виправдовується

Анонс збігається з тим, що стратегія Intercom, орієнтована на ШІ, виявляється успішною. Fin наближається до 100 мільйонів доларів щорічного повторюваного доходу (ARR) і демонструє зростання в 3,5 рази, ставши найшвидше зростаючим сегментом бізнесу компанії з ARR у 400 мільйонів доларів. Прогнозується, що Fin становитиме половину загального доходу Intercom на початку наступного року.

Ця траєкторія свідчить про вражаючий перелом. Коли Fin був запущений, його коефіцієнт вирішення проблем становив лише 23%. Сьогодні він в середньому становить 67% для всіх клієнтів, а в деяких великих корпоративних впровадженнях сягає 75%.

Щоб досягти цього, Intercom збільшив свою команду з розробки ШІ з приблизно 6 дослідників до 60 за останні три роки – це значна інвестиція для компанії, яка, за словами МакКейба, "була у справді поганому становищі" до переорієнтації на ШІ. Середній темп зростання публічних компаній-розробників програмного забезпечення становить близько 11%; Intercom очікує досягти 37% зростання цього року.

"Ми, безумовно, перші в цій категорії, хто розробив власну модель," – заявив МакКейб. "Ніхто інший не матиме подібного ще щонайменше рік."

Спеціалізація та диверсифікація ШІ

Теза МакКейба узгоджується з ширшою тенденцією, яку Андрій Карпаті, колишній керівник відділу ШІ в Tesla та OpenAI, нещодавно описав як "спеціалізацію" моделей ШІ – поширення спеціалізованих систем, оптимізованих для вузьких завдань, а не для загального інтелекту.

МакКейб стверджує, що обслуговування клієнтів ідеально підходить для цього підходу. Це один з двох-трьох випадків використання ШІ в корпоративному сегменті, який на сьогодні знайшов справжню економічну привабливість, поряд з помічниками для кодування та, можливо, ШІ для юридичної сфери. Це привабило понад мільярд доларів венчурного фінансування для конкурентів, таких як Decagon та Sierra, і, за словами МакКейба, зробило цей простір "жорстоко конкурентним".

Питання полягає в тому, чи є специфічні для домену моделі стійкою перевагою, чи тимчасовим арбітражем, який передові лабораторії врешті-решт закриють. МакКейб вважає, що лабораторії стикаються зі структурними обмеженнями.

"Можливо, майбутнє полягає в тому, що Anthropic матиме велику пропозицію багатьох різних спеціалізованих моделей. Можливо, саме так це виглядатиме," – сказав він. "Але реальність така, що я не думаю, що загальні моделі зможуть конкурувати зі специфічними для домену моделями на даний момент."

Від ефективності до досвіду

Раннє впровадження корпоративного ШІ зосереджувалося значною мірою на скороченні витрат – замінюючи дорогих людських агентів дешевшими автоматизованими. Але МакКейб бачить зміну акцентів у бік якості досвіду.

"Спочатку це було: "Чорт забирай, ми можемо зробити це набагато дешевше". А тепер вони думають: "Зачекайте, ні, ми можемо надати клієнтам набагато кращий досвід", – сказав він.

Бачення виходить за рамки простого вирішення запитів. МакКейб уявляє собі ШІ-агентів, які функціонують як консультанти – бот продавця взуття, який не тільки відповідає на запитання про доставку, але й пропонує поради зі стилю та показує клієнтам, як можуть виглядати різні варіанти.

"Обслуговування клієнтів завжди було досить паршивим," – прямо сказав МакКейб. "Навіть у найкращих брендів вам доводиться чекати на лінії, вас переводять з одного відділу до іншого. Зараз з’являється можливість надати по-справжньому ідеальний клієнтський досвід."

Ціноутворення та доступність

Для існуючих клієнтів Fin оновлення до Apex надається без додаткових витрат. Intercom підтвердив, що ціноутворення для клієнтів залишається незмінним – користувачі продовжують платити за результат, як і раніше, по 0,99 долара за вирішену взаємодію, і автоматично отримують переваги нової моделі.

Apex не доступний як самостійна модель або через зовнішній API. Він доступний лише через Fin, що означає, що компанії не можуть ліцензувати модель окремо або інтегрувати її у власні продукти. Це обмеження може звузити можливості Intercom щодо монетизації моделі поза межами існуючої клієнтської бази, але водночас фактично зберігає технологію як пропрієтарну, незалежно від того, якою виявиться базова модель.

Що далі

Intercom планує розширити можливості Fin за межі обслуговування клієнтів, охопивши продажі та маркетинг, позиціонуючи його як прямого конкурента баченню Salesforce Agentforce, яке спрямоване на надання ШІ-агентів протягом усього життєвого циклу клієнта.

Для ширшої індустрії SaaS, крок Intercom викликає незручні питання. Якщо 15-річна компанія з обслуговування клієнтів може створити модель, яка перевершує OpenAI та Anthropic у своїй галузі, що це означає для постачальників, які все ще покладаються на загальні API-виклики? І якщо "пост-тренування – це нова межа", як наполягає МакКейб, чи зіткнуться компанії, які заявляють про прориви, з тиском показати свої розробки, чи продовжать ховатися за конкурентною таємницею, вихваляючи прозорість?

Відповідь МакКейба на перше запитання, викладена в нещодавньому пості на LinkedIn, є чіткою: "Якщо ви не можете стати компанією-агентом, ваше CRUD-додаткове бізнес має зменшуване майбутнє."

Відповідь на друге питання ще належить побачити.

Прогноз ІТ-Блогу: Цей підхід до створення нішевих, високооптимізованих моделей ШІ, ймовірно, стане стандартом для багатьох SaaS-платформ. У найближчі 1-2 роки ми побачимо зростання кількості компаній, що вкладають значні ресурси у власні “доналаштовані” моделі, ставлячи ефективність у конкретному домені вище за універсальність великих мовних моделей.

Подробиці можна знайти на сайті: venturebeat.com