Підприємства, які донедавна керували окремими моделями для міркувань, мультимодальних завдань та агентського кодування, тепер можуть оптимізувати свої технічні стеки. Нова модель Mistral Small 4 об’єднує ці три можливості в єдиний open-source рішення, пропонуючи динамічно регульовані рівні обробки інформації.

Small 4 виходить на насичений ринок компактних моделей, де вже представлені такі гравці, як Qwen і Claude Haiku, що конкурують за показники продуктивності та вартість висновків. Mistral робить ставку на скорочені вихідні дані, що безпосередньо впливає на зменшення затримок та зниження вартості обробки токенів.

Mistral Small 4 є еволюцією моделі Mistral Small 3.2, представленої у червні 2025 року, і доступна під ліцензією Apache 2.0. “З Small 4 користувачам більше не потрібно обирати між швидкою моделлю для інструкцій, потужним механізмом міркувань або мультимодальним асистентом: одна модель тепер надає всі три, з конфігурованим рівнем інтенсивності міркувань та найкращою в класі ефективністю”, — зазначено у блозі Mistral.

Компанія стверджує, що, незважаючи на свої скромні розміри — Mistral Small 4 має 119 мільярдів загальних параметрів, але лише 6 мільярдів активних параметрів на токен — модель інтегрує функціональність усіх попередніх розробок Mistral. Вона успадковує здібності до міркувань від Magistral, мультимодальне розуміння від Pixtral та ефективність у кодуванні від Devstral. Крім того, модель підтримує контекстне вікно розміром 256K, що, за словами розробників, чудово підходить для обробки довгих діалогів та аналітики.

Роб Мей, співзасновник та CEO ринку мовних моделей Neurometric, відзначив, що Mistral Small 4 вирізняється своєю архітектурною гнучкістю. Водночас, він зауважив, що поява нових компактних моделей може призвести до подальшої фрагментації ринку.

“З технічної точки зору, так, вона може бути конкурентоспроможною проти інших моделей”, — сказав Мей. “Але головне питання полягає в тому, чи зможе вона подолати плутанину на ринку. Mistral має здобути визнання, щоб отримати шанс потрапити до тестових наборів. Лише тоді вони зможуть продемонструвати технічні можливості моделі.”

Міркування на вимогу

Невеликі моделі залишаються привабливим вибором для корпоративних розробників, які прагнуть отримати схожий досвід роботи з LLM за нижчою вартістю.

Модель побудована на архітектурі Mixture-of-Experts, подібно до інших рішень Mistral. Вона містить 128 експертів, з яких чотири активні для кожного токена, що, за твердженнями Mistral, забезпечує ефективне масштабування та спеціалізацію.

Це дозволяє Mistral Small 4 реагувати швидше, навіть на запити, що вимагають складніших міркувань. Вона також може обробляти та аналізувати текст і зображення, надаючи користувачам змогу працювати з документами та діаграмами.

Mistral повідомляє, що модель оснащена новим параметром `reasoning_effort`, який дозволяє користувачам “динамічно налаштовувати поведінку моделі”. Це дає змогу підприємствам конфігурувати Small 4 для швидких, легких відповідей у стилі Mistral Small 3.2, або ж для більш розгорнутих, деталізованих міркувань, як у Magistral, надаючи покрокові пояснення для складних завдань.

Mistral зазначає, що Small 4 працює на меншій кількості чіпів порівняно з аналогічними моделями, рекомендована конфігурація включає чотири Nvidia HGX H100s або H200s, або два Nvidia DGX B200s.

“Надання передових моделей штучного інтелекту з відкритим вихідним кодом вимагає широкої оптимізації. Завдяки тісній співпраці з Nvidia, висновки були оптимізовані як для vLLM, так і для SGLang, забезпечуючи ефективне обслуговування з високою пропускною здатністю в різних сценаріях розгортання”, — заявили в Mistral.

Продуктивність на тестах

Згідно з власними тестами Mistral, Small 4 демонструє результати, близькі до Mistral Medium 3.1 та Mistral Large 3, особливо в MMLU Pro.

Mistral стверджує, що показники виконання інструкцій роблять Small 4 ідеальною для високооб’ємних корпоративних завдань, таких як аналіз документів.

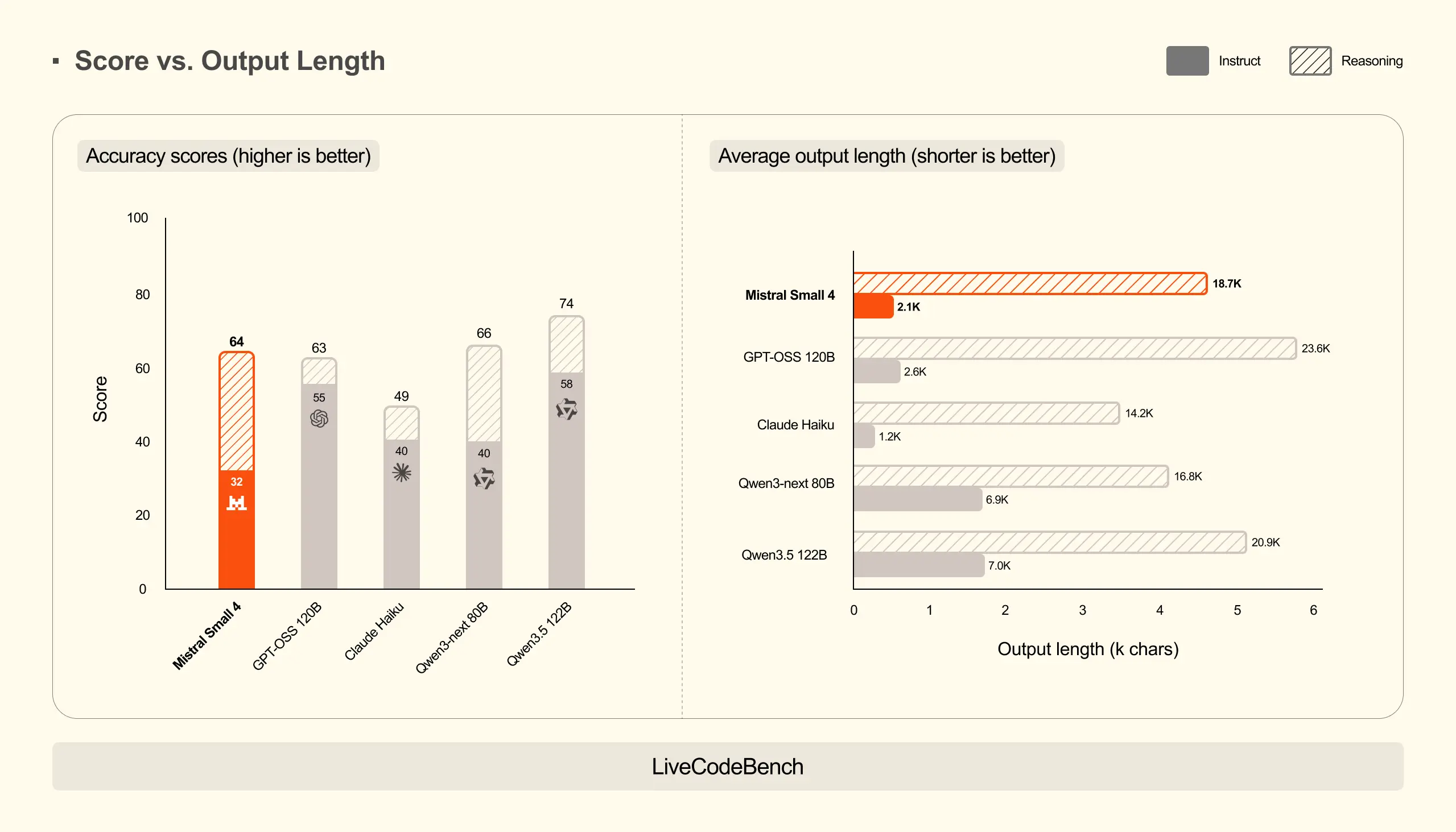

Хоча Small 4 конкурентоспроможна з іншими компактними моделями від інших компаній, вона все ще поступається деяким популярним open-source моделям, особливо в завданнях, що вимагають складних міркувань. Наприклад, Qwen 3.5 122B та Qwen 3-next 80B перевершують Small 4 на LiveCodeBench, як і Claude Haiku в режимі інструкцій.

Mistral Small 4 продемонструвала кращі результати, ніж OpenAI GPT-OSS 120B, у бенчмарку LCR.

Mistral стверджує, що Small 4 досягає цих показників завдяки “значно коротшим вихідним даним”, що призводить до нижчих витрат на висновки та меншої затримки порівняно з іншими моделями. Зокрема, в режимі інструкцій Small 4 генерує найкоротші відповіді серед усіх протестованих моделей — 2.1 тис. символів проти 14.2 тис. у Claude Haiku та 23.6 тис. у GPT-OSS 120B. У режимі міркувань довжина відповідей значно більша (18.7 тис. символів), що відповідає призначенню цього режиму.

Мей вважає, що вибір моделі залежить від цілей організації, але затримка є одним із трьох ключових факторів, на які слід звернути увагу. “Це залежить від ваших цілей та того, що ви оптимізуєте у своїй архітектурі. Підприємства повинні надавати пріоритет цим трьом стовпам: надійності та структурованості вихідних даних, співвідношенню затримки та інтелекту, можливостям тонкого налаштування та конфіденційності”, — зазначив Мей.

Прогноз ІТ-Блогу: Mistral Small 4, ймовірно, стимулюватиме подальшу розробку компактних, але потужних мовних моделей, що зменшить бар’єр входу для підприємств, які прагнуть інтегрувати ШІ. Очікується, що конкуренція в цьому сегменті посилиться, змушуючи розробників зосереджуватися на оптимізації продуктивності та зниженні витрат на висновки.

Джерело новини: venturebeat.com