Плани NVIDIA щодо LPU від Groq зміцнять позиції компанії у робочих навантаженнях з чутливістю до затримок

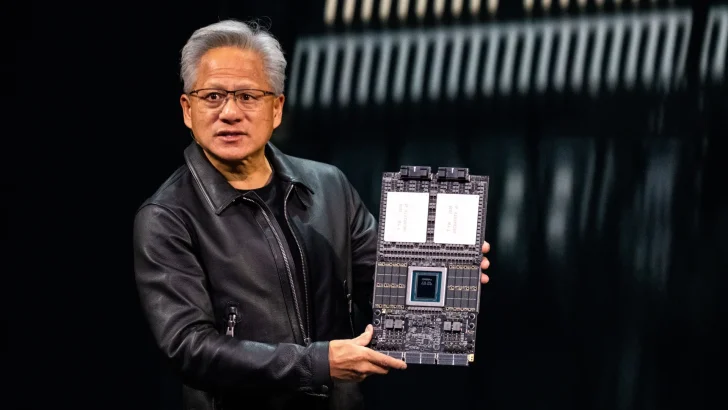

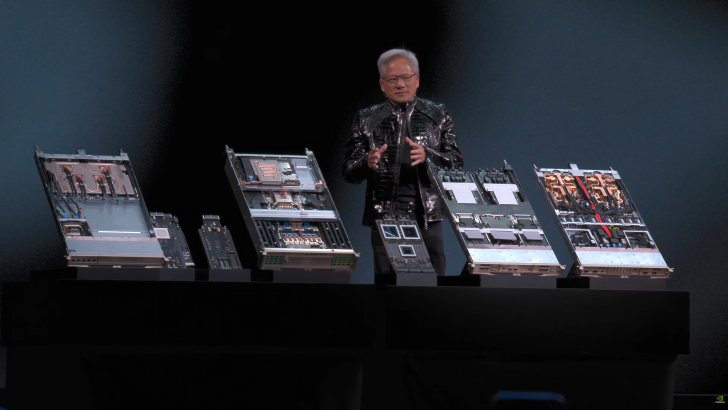

NVIDIA активно нарощує свої придбання цього року. Однак однією з найважливіших угод, укладених компанією, стала співпраця з Groq — угода про неліцензування вартістю до 20 мільярдів доларів, що є найбільшою інвестицією “Команди Зелених”. Анонс відбувся напередодні Різдва, але NVIDIA так і не надала детальних планів щодо реалізації. Цікаво, що генерального директора NVIDIA запитали про плани компанії щодо Groq під час звіту про прибутки за четвертий квартал 2026 року, і він надав контекстну заяву, яка може натякати на роль LPU у майбутніх пропозиціях NVIDIA у сфері ШІ.

Щодо нашого бачення Groq та декодерів з низькою затримкою, у мене є чудові ідеї, якими я хотів би поділитися з вами на GTC.

І тому, що ми зробимо з Groq, ви побачите на GTC, але ми розширимо нашу архітектуру за допомогою Groq як прискорювача, подібно до того, як ми розширили архітектуру NVIDIA за допомогою Mellanox.

– Генеральний директор NVIDIA Дженсен Хуанг

Ідея придбання Groq проста. NVIDIA прагне охопити робочі навантаження, чутливі до затримок, а в наш час стадія висновку (inference) стала домінуючою. Додатки, прив’язані до агентних середовищ, потребують надшвидких відповідей, тому затримка стала основним вузьким місцем для постачальників обчислювальних потужностей. NVIDIA домінує в навчанні завдяки Hopper та Blackwell, але з Vera Rubin, висновок — це сфера, де компанії ще належить закріпити свою лідерство, і LPU-блоки від Groq відіграватимуть значну роль у встановленні стандартів. Генеральний директор NVIDIA порівняв роль Groq з придбанням Mellanox, і для тих, хто не знає, що Mellanox зробила для компанії, вона вирішила проблему “мережевої взаємодії”. Mellanox заклала основу для InfiniBand, що пізніше призвело до того, що NVIDIA називає “екстремальним співпроектуванням”, тому не буде помилкою сказати, що це придбання дало NVIDIA поштовх у її стратегії центрів обробки даних. Groq відіграватиме подібну роль, і, як зазначає Дженсен, “Команда Зелених” “розширить свою архітектуру” за допомогою Groq, що передбачає деяку інтеграцію LPU на рівні стійок.

Декодування та попереднє заповнення (prefill) відомі як основні етапи висновку, і в контексті агентного ШІ перший набуває значно більшого значення. Враховуючи, що в багатоагентних робочих навантаженнях декодування дозволяє агентам виконувати складні кроки міркування за лічені “секунди”, що необхідно в умовах переходу світу до роїв ШІ-агентів, які залежать один від одного. За допомогою Rubin CPX NVIDIA фактично охопила етапи попереднього заповнення завдяки своїм двигунам прискорення уваги та масивним обчислювальним потужностям NVFP4.

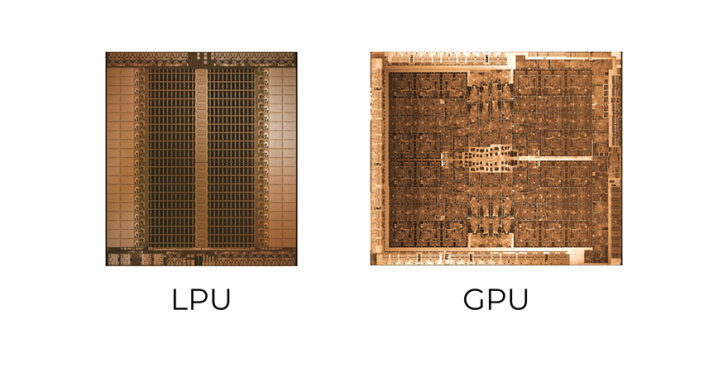

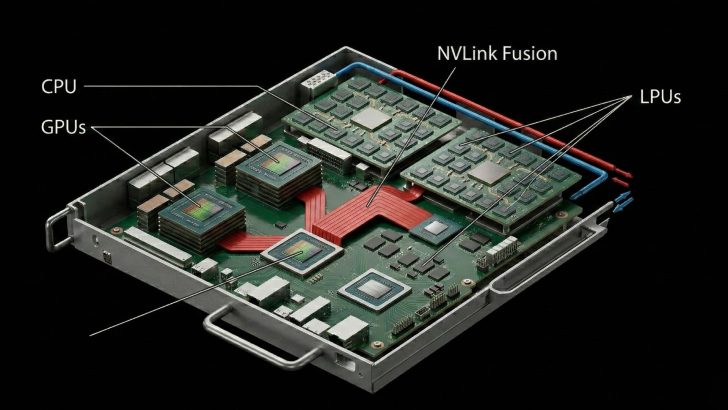

Для декодування NVIDIA використовуватиме Groq, як зазначив Дженсен. LPU використовують SRAM на самому чіпі, щоб забезпечити десятки терабайтів на секунду внутрішньої пропускної здатності, і ми вже бачили широке застосування SRAM від таких компаній, як Cerebras з WSE-3 та Microsoft з Maia 300. Щодо того, де саме LPU можуть бути інтегровані, існують дві основні теорії. Перша — NVIDIA може розробити гібридні обчислювальні вузли в рамках пропозицій на рівні стійок, з кількома LPU, з’єднаними через уніфікований інтерконект.

GF Securities вважає (через Jukan), що NVIDIA може представити “LPX rack” на цьогорічній GTC, який міститиме 256 LPU-блоків в одному пристрої. Базуючись на цій інформації, ми вважаємо, що для з’єднання LPU-до-LPU NVIDIA використовуватиме нативний протокол прямого з’єднання чіпів (plesiosynchronous chip-to-chip). Для з’єднання LPU-до-GPU ми можемо побачити використання NVLink Fusion для обробки величезного KV-кешу, що скидається з GPU під час фази попереднього заповнення. Інший варіант, що розглядається, — це використання LPU як інтегрованих блоків на чіпах Feynman GPU через гібридне з’єднання (hybrid bonding), але наразі варіант на рівні стійки виглядає набагато кращою перспективою.

Ідея полягає в тому, що LPU-блоки від Groq відіграватимуть роль, подібну до Mellanox у мережевій взаємодії, і ця гібридна архітектура дасть NVIDIA перевагу у робочих навантаженнях, чутливих до затримок. На цьому звітному дзвінку Дженсен вже розкрив, що обчислювальні потужності та доходи тепер зростають 1:1, завдяки “рівню додатків” ШІ, що розвивається більш агресивно. Ми очікуємо, що NVIDIA офіційно представить свої плани щодо LPU на цьогорічній GTC.

Чи варто купувати? (Порада ІТ-Блогу): Інвестиції NVIDIA у LPU від Groq виглядають як стратегічний крок для захоплення ринку робочих навантажень з низькою затримкою, що є ключовим для майбутнього ШІ. Хоча конкретні продукти та їх ціни ще не оголошені, ця інтеграція, ймовірно, посилить домінування NVIDIA у сфері ШІ-обчислень, пропонуючи потужні рішення для завдань, де швидкість реакції має вирішальне значення. Це свідчить про те, що майбутні системи NVIDIA будуть ще потужнішими, хоча й потенційно дорожчими, що варто враховувати при виборі обладнання.

За матеріалами: wccftech.com